「ChatGPTは便利そうだけど、なんだか怖い…」

「情報漏洩や犯罪への悪用リスクがあると聞いて、使うのが不安になった」

このように、ChatGPTの潜在的な危険性に対して、漠然とした恐怖を感じている方も多いのではないでしょうか。

本記事では、ChatGPTが「怖い」と言われる具体的な理由を、情報漏洩のリスクから心理的な影響、実際のトラブル事例まで11の観点から徹底解説します。

さらに、ただ怖がるだけでなく、安全にChatGPTと付き合っていくための具体的な対策もご紹介します。

この記事を最後まで読めば、ChatGPTの危険性を正しく理解し、安心してその利便性を享受できるようになるはずです。

ChatGPTが怖いと言われる理由①:機密情報・個人情報の漏洩

ChatGPTが怖いと言われる最大の理由の一つが、機密情報や個人情報が漏洩するリスクです。

ユーザーが入力した情報は、基本的にAIの学習データとして利用される可能性があり、意図せず第三者に渡ってしまう危険性をはらんでいます。

具体的にどのような情報を入力すべきでないのか、3つのカテゴリに分けて解説します。

入力してはいけない個人情報(氏名・住所・連絡先)

氏名、住所、電話番号、メールアドレスといった個人を特定できる情報は、絶対に入力してはいけません。

これらの情報がAIの学習データに含まれると、予期せぬ形で第三者に表示されてしまう可能性があります。

一度インターネット上に流出した個人情報を完全に削除するのは非常に困難です。

自分自身の情報だけでなく、家族や友人の情報も同様に、決してChatGPTに入力しないよう徹底しましょう。

企業の内部情報や財務情報

業務でChatGPTを利用する際に特に注意が必要なのが、企業の内部情報です。

未公開の製品情報、顧客リスト、社内秘の資料、財務データなどを入力すると、それらが学習され、競合他社のユーザーからの質問への回答に利用されてしまうリスクがあります。

このような情報漏洩は、企業の競争力を著しく損なうだけでなく、法的な問題や信用の失墜に繋がりかねません。

会社のPCでChatGPTを利用する場合でも、機密情報の取り扱いには細心の注意が必要です。

こちらはスタンフォード大学が発行した、AI時代のプライバシーリスクを社会レベルで論じた論文です。合わせてご覧ください。 https://hai-production.s3.amazonaws.com/files/2024-02/White-Paper-Rethinking-Privacy-AI-Era.pdf

健康状態やメンタルヘルスに関する情報

病気の症状や治療履歴、精神的な悩みといった非常にプライベートな健康情報も、入力は避けるべきです。

これらのデリケートな情報が万が一漏洩した場合、個人が深刻な精神的苦痛を受けたり、社会的な不利益を被ったりする恐れがあります。

AIに相談することで一時的な安らぎを得られるかもしれませんが、その代償としてプライバシーを危険に晒すことになります。

専門的な相談は、必ず守秘義務のある医師やカウンセラーに行うようにしましょう。

ChatGPTを企業で安全に利用するための詳細なガイドは、こちらの記事で解説しています。合わせてご覧ください。 https://taskhub.jp/useful/chatgpt-company-use/

ChatGPTが怖いと言われる理由②:実際のトラブル・情報流出事例

ChatGPTに関する懸念は、単なる憶測だけではありません。

実際に、情報漏洩に関連するトラブルが世界中で報告されています。

ここでは、特に注目された2つの事例を紹介し、リスクが現実のものであることを解説します。

Samsungで発生した機密情報の漏洩

大手電機メーカーのSamsung社では、社員が業務効率化のためにChatGPTを利用した結果、社内の機密情報が外部に漏洩する事件が発生しました。

半導体設備の測定データや、機密性の高いプログラムのソースコードなどを入力してしまったことが原因です。

これらの情報はOpenAI社のサーバーに送信・蓄積され、AIの学習データとして利用された可能性があります。

この事件を受け、同社は社内でのChatGPT利用を原則禁止する措置を取りました。

10万件以上のアカウント情報が盗難被害に

2023年には、ChatGPTのユーザーアカウント情報が10万件以上盗まれ、ダークウェブ上で売買されていたことが発覚しました。

これは、ユーザーのPCに感染したマルウェア(情報窃取型不正プログラム)によって、保存されていたIDやパスワードが盗まれたことが原因です。

ChatGPT自体に脆弱性があったわけではありませんが、アカウントが乗っ取られることで、過去の対話履歴などが第三者に閲覧される危険性を示しています。

ChatGPTが怖いと言われる理由③:思考の癖まで見抜かれる心理的恐怖

ChatGPTの怖さは、情報漏洩のような物理的なリスクだけではありません。

対話を重ねることで、ユーザーの思考パターンや心理状態までも見抜かれてしまうという、心理的な恐怖も指摘されています。

AIに内面を深く理解され、コントロールされるかもしれないという不安について解説します。

対話履歴からユーザーの性格や弱みを観察・学習される

ChatGPTは、過去の対話履歴を記憶し、学習する能力を持っています。

あなたがどのような質問をし、どのような言葉遣いをし、何に興味を持っているか、といった膨大なデータが蓄積されていきます。

これにより、AIはユーザーの性格、価値観、さらには悩みや弱みといった内面的な特徴までを推測できるようになります。

まるで親しい友人のように、自分以上に自分のことを理解している存在がいるという事実は、人によっては不気味さや恐怖を感じる原因となるでしょう。

ユーザーの”ツボ”を突いた回答で思考を誘導される

AIがユーザーの性格や好みを深く理解すると、その人に「響きやすい」言葉を選んで回答を生成できるようになります。

これにより、ユーザーは無意識のうちにAIの回答を信じ込み、思考や判断を特定の方向へ誘導されてしまう危険性があります。

例えば、政治的な思想や消費行動を巧みにコントロールされる可能性もゼロではありません。

パーソナライズされた情報提供は便利である一方、客観的な判断を妨げ、知らず知らずのうちに操られるという新たな恐怖を生み出しているのです。

ChatGPTが怖いと言われる理由④:犯罪への悪用

ChatGPTの高度な文章生成能力は、残念ながら悪意を持った人々によって犯罪に利用されるケースも増えています。

これまで手間がかかっていた詐欺の手口が、AIによってより巧妙かつ大規模に行われるようになっているのです。

ここでは、代表的な2つの悪用手口について解説します。

フィッシング詐欺や偽の警告文の巧妙な作成

フィッシング詐欺は、有名企業や公的機関を装って偽のメールを送り、個人情報を盗み出す手口です。

従来は不自然な日本語が多く見受けられましたが、ChatGPTを使えば、極めて自然で本物と見分けがつかないような巧妙な文章を簡単に作成できてしまいます。

同様に、「ウイルスに感染しました」といった偽の警告文でユーザーの不安を煽り、不正なソフトウェアをインストールさせようとする手口も高度化しています。

マルウェアを仕込んだ偽アプリ・プログラムの存在

ChatGPTの人気に便乗し、偽物のアプリやソフトウェアも数多く出回っています。

これらの偽アプリには、個人情報を盗み出すマルウェアやウイルスが仕込まれていることが多く、安易にインストールすると深刻な被害に遭う可能性があります。

特に、公式サイト以外で配布されている「高機能版」や「無料版」を謳うものには注意が必要です。

便利なツールを使いたいという心理を逆手に取った、悪質な犯罪手口と言えるでしょう。

ChatGPTが怖いと言われる理由⑤:社会全体への影響

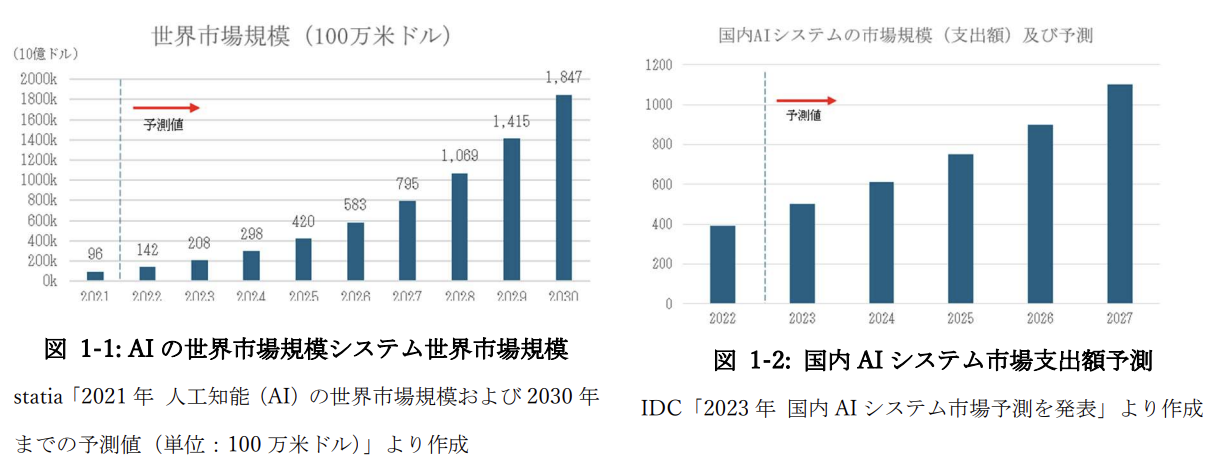

個人のリスクだけでなく、ChatGPTをはじめとする生成AIが社会全体に与える影響についても、多くの懸念が示されています。

雇用のあり方や、情報の信頼性といった、社会の根幹を揺るがしかねない問題です。

ここでは、特に議論されることの多い2つの影響について解説します。

AIによる雇用の代替・喪失

ChatGPTは、文章作成、翻訳、プログラミングといった、これまで人間が行ってきた知的労働の一部を自動化する能力を持っています。

これにより、特定の職種では人間の仕事がAIに代替され、雇用が失われるのではないかという懸念が広がっています。

もちろん、AIによって新たな仕事が生まれるという側面もありますが、急激な変化に対応できず、多くの人々が職を失う可能性は否定できません。

自身のスキルやキャリアを見つめ直す必要に迫られるという点で、社会的な恐怖を感じる人も少なくありません。

もっともらしい嘘やフェイクニュースの拡散

ChatGPTは、時に事実と異なる情報(ハルシネーション)を、さも真実であるかのように生成することがあります。

また、悪意を持って利用すれば、説得力のあるフェイクニュースや陰謀論を大量に作り出し、社会に拡散させることも可能です。

情報が瞬時に広がる現代社会において、何が真実で何が嘘かを見分けることはますます困難になっています。

AIによって生み出された偽情報が、世論を操作し、社会に混乱をもたらすリスクは、非常に大きな脅威と言えるでしょう。

こちらはAIのハルシネーションを防ぐ方法について解説した記事です。 合わせてご覧ください。 https://taskhub.jp/use-case/chatgpt-prevent-hallucination/

「ChatGPTが怖い」で終わらないための安全な付き合い方

ここまで様々な危険性について解説してきましたが、いたずらに怖がるだけでは、この便利なテクノロジーの恩恵を受けられなくなってしまいます。

リスクを正しく理解し、適切な対策を講じることが重要です。

ここからは、ChatGPTを安全に利用するための具体的な方法を4つ紹介します。

個人情報や機密情報は絶対に入力しない

最も基本的かつ重要な対策は、個人情報や機密情報を一切入力しないことです。

氏名、住所、連絡先、企業の内部情報、パスワードなど、漏洩すると問題になる情報は、どのような状況であってもChatGPTとの対話に含めないようにしましょう。

業務で利用する際は、社内で情報入力に関する明確なガイドラインを定め、全従業員に周知徹底することが不可欠です。

こちらは独立行政法人情報処理推進機構(IPA)が公開している、企業が生成AIを導入・運用する際のリスクと対策を網羅したガイドラインです。合わせてご覧ください。 https://www.ipa.go.jp/jinzai/ics/core_human_resource/final_project/2024/f55m8k0000003spo-att/f55m8k0000003svn.pdf

オプトアウト設定でAIの学習機能をオフにする

ChatGPTには、入力したデータをAIの学習に利用させないようにする「オプトアウト」という設定があります。

設定画面から「Chat history & training」の項目をオフにすることで、あなたの対話履歴が今後のモデル改善に使われることを防げます。

ただし、この設定をオンにすると対話履歴が保存されなくなるため、過去のやり取りを見返すことができなくなる点には注意が必要です。

プライバシーを優先するか、利便性を取るかを考えた上で設定しましょう。

出力された情報は鵜呑みにせず必ずファクトチェックする

ChatGPTが生成する情報は、必ずしも正確とは限りません。

前述の通り、もっともらしい嘘や古い情報が含まれている可能性があります。

特に、専門的な知識やデータ、歴史的な事実に関する回答は、鵜呑みにせず、必ず信頼できる情報源(公式サイト、公的機関の発表、専門家の論文など)で裏付けを取る「ファクトチェック」の習慣をつけましょう。

AIはあくまでアシスタントであり、最終的な判断は人間が行うべきです。

公式サイト・公式アプリ以外は利用しない

ChatGPTを利用する際は、必ずOpenAIの公式サイト、または公式が提供しているスマートフォンアプリを使用してください。

検索エンジンでヒットする非公式サイトや、SNSで宣伝されている出所不明のアプリは、マルウェアに感染させたり、個人情報を盗んだりする目的で作られた偽物である可能性が非常に高いです。

少しでも怪しいと感じたらアクセスせず、ブックマークや公式サイトからのリンクを利用してアクセスするようにしましょう。

ChatGPTとの付き合い方が怖いと感じる人からのよくある質問

最後に、ChatGPTの安全性に関して多くの人が抱く疑問について、Q&A形式で回答します。

ChatGPTに入力した情報は誰に見られますか?

入力した情報は、OpenAIの一部の従業員が、モデルの改善や不正利用の監視のために閲覧する可能性があります。

また、オプトアウト設定をしていない場合、AIの学習データとして利用され、他のユーザーへの回答に間接的に影響を与える可能性があります。

法執行機関からの正当な要請があった場合にも、情報が提供されることがあります。

ChatGPTはなぜ危険・怖いと言われるのですか?

主な理由として、①個人情報・機密情報の漏洩リスク、②犯罪への悪用(フィッシング詐欺など)、③もっともらしい嘘(ハルシネーション)の生成、④雇用の喪失といった社会への影響、⑤対話履歴から心理を読まれることへの恐怖などが挙げられます。

これらのリスクを正しく理解することが重要です。

ChatGPTの情報漏洩対策は?

最も効果的な対策は、個人情報や機密情報を一切入力しないことです。

それに加えて、ChatGPTの設定で対話履歴をAIの学習に利用させない「オプトアウト」を行うこと、不審な偽サイトや偽アプリを利用せず公式サイトからアクセスすること、アカウントのパスワードを使い回さないことなどが挙げられます。

まとめ:ChatGPTの怖さを理解し、便利な未来を切り拓こう

本記事では、ChatGPTが「怖い」と言われる理由を、情報漏洩、犯罪への悪用、心理的な影響、社会へのインパクトなど、多角的な視点から解説しました。

また、それらのリスクを回避し、安全に活用するための具体的な対策も紹介しました。

ChatGPTは、正しく使えば私たちの仕事や生活を豊かにしてくれる強力なツールです。

しかし、その裏には無視できない危険性が潜んでいることも事実です。

大切なのは、漠然と怖がるのではなく、リスクを正しく理解し、適切な距離感を保ちながら付き合っていくことです。

本記事で紹介した安全対策を実践し、ChatGPTという最先端技術の恩恵を最大限に活用しながら、より便利で創造的な未来を切り拓いていきましょう。

AI失業の恐怖は本当?ChatGPT時代を「生き抜く人」と「淘汰される人」の境界線

ChatGPTが仕事を奪うという話を聞いて、自分の将来に漠然とした不安を感じていませんか。その不安は、決して間違いではありません。AIを単なる「便利な検索エンジン」や「文章作成ツール」としてしか使えない人は、今後、その価値を大きく下げていく可能性があります。しかし、AIを「思考のパートナー」として使いこなし、新たな価値を生み出せる人は、むしろ活躍の場を広げていくでしょう。世界経済フォーラムの報告が示すように、未来の労働市場で求められるのは、AIにはできない「批判的思考」や「創造的思考」なのです。この記事では、AI時代に「淘汰される人」と「生き抜く人」の決定的な違いと、今から実践できる思考のアップデート術を解説します。

AIに「指示待ち」する人は淘汰される

もし、あなたの仕事が「AIに指示されたことをこなすだけ」になったらどうでしょう。それは、もはやAIに代替可能な業務と言えます。「このテーマで記事を書いて」「この文章を要約して」といった単純な命令は、AIの最も得意とするところです。このような使い方に慣れてしまうと、私たちは徐々に「問いを立てる力」を失っていきます。

課題の本質は何か。

どのような情報が必要か。

どのような切り口で新しい価値を提案できるか。

こうした思考プロセスをAIに丸投げしてしまうと、自ら問題を発見し、解決策を創造する能力は衰える一方です。AIの答えを鵜呑みにし、その背景を疑うことをやめたとき、人は「考える」ことをやめ、「作業する」だけの存在になってしまうのです。

引用元:

世界経済フォーラムの「仕事の未来レポート2023」では、今後5年間で重要性が増すスキルの上位に「分析的思考」と「創造的思考」が挙げられています。これは、テクノロジーが進化する中で、複雑な問題を理解し、新しいアイデアを生み出す人間の能力がこれまで以上に求められることを示唆しています。(World Economic Forum, “The Future of Jobs Report 2023”, 2023年)

AIに「問いを立てる」人が生き抜く

一方で、AI時代に価値を高めるのは、AIに対して「的確な問い」を立てられる人です。彼らはAIを答えを出す機械ではなく、思考を深めるための壁打ち相手として活用します。

たとえば、単に「市場分析レポートを作って」と指示するのではなく、次のように問いかけます。

「私たちの製品のターゲット層は30代女性です。この層が抱える潜在的な悩みについて、5つの異なる視点から仮説を立ててください。」

「競合A社の戦略について、あえて弱点を3つ挙げるとしたら何ですか?その根拠も示してください。」

「私たちが提案するこの新サービスについて、あなたが投資家なら、どんなリスクを懸念しますか?」

このように、AIに多様な役割を与え、多角的な視点を引き出すことで、一人ではたどり着けなかった深い洞察を得ることができます。AIの生成した答えを鵜呑みにするのではなく、それを叩き台にしてさらに思考を重ね、最終的な意思決定は自分で行う。この「AIとの対話力」こそが、これからの時代を生き抜くための最も重要なスキルとなるのです。

まとめ

企業はDX推進や生産性向上が急務となる中で、生成AIの活用に大きな期待を寄せています。

しかし、本記事で解説されたような情報漏洩のリスクや、そもそも「何から手をつければいいかわからない」「社内にAIを使いこなせる人材がいない」といった理由で、本格的な導入に踏み切れない企業も少なくありません。

そこでおすすめしたいのが、Taskhub です。

Taskhubは日本初のアプリ型インターフェースを採用し、200種類以上の実用的なAIタスクをパッケージ化した生成AI活用プラットフォームです。

たとえば、メール作成や議事録作成、画像からの文字起こし、さらにレポート自動生成など、さまざまな業務を「アプリ」として選ぶだけで、誰でも直感的にAIを活用できます。

しかも、Azure OpenAI Serviceを基盤にしているため、データセキュリティが万全で、情報漏えいの心配もありません。

さらに、AIコンサルタントによる手厚い導入サポートがあるため、「何をどう使えばいいのかわからない」という初心者企業でも安心してスタートできます。

導入後すぐに効果を実感できる設計なので、複雑なプログラミングや高度なAI知識がなくても、すぐに業務効率化が図れる点が大きな魅力です。

まずは、Taskhubの活用事例や機能を詳しくまとめた【サービス概要資料】を無料でダウンロードしてください。

Taskhubで“最速の生成AI活用”を体験し、御社のDXを一気に加速させましょう。