「ChatGPTで作成した文章の情報が本当に正しいのか不安…。」

「ChatGPTを使って効率的にファクトチェックをしたいけど、どんな指示(プロンプト)を出せばいいのか分からない…。」

こういった悩みを持っている方もいるのではないでしょうか?

ChatGPTは非常に便利なツールですが、時として誤った情報を生成することがあります。そのため、生成された情報の真偽を確かめる「ファクトチェック」は欠かせません。

本記事では、ChatGPTのファクトチェックでそのまま使える5つのプロンプト例、精度をさらに高めるためのコツ、そしてビジネスでの具体的な活用事例まで、幅広く解説します。

上場企業をメインに生成AIコンサルティング事業を展開している弊社が実際に使っているプロンプトのみをご紹介しますので、きっと役に立つと思います。ぜひ最後までご覧ください。

そもそも、なぜChatGPTにファクトチェックが必要なのか?

ChatGPTは非常に高性能なAIですが、その回答が常に100%正しいとは限りません。なぜファクトチェックが必要なのか、その理由と重要性を3つのポイントから解説します。

ChatGPTが生成する情報の特性を理解し、適切に活用するための第一歩です。

ChatGPTは嘘をつく?不正確な情報を生成する「ハルシネーション」とは

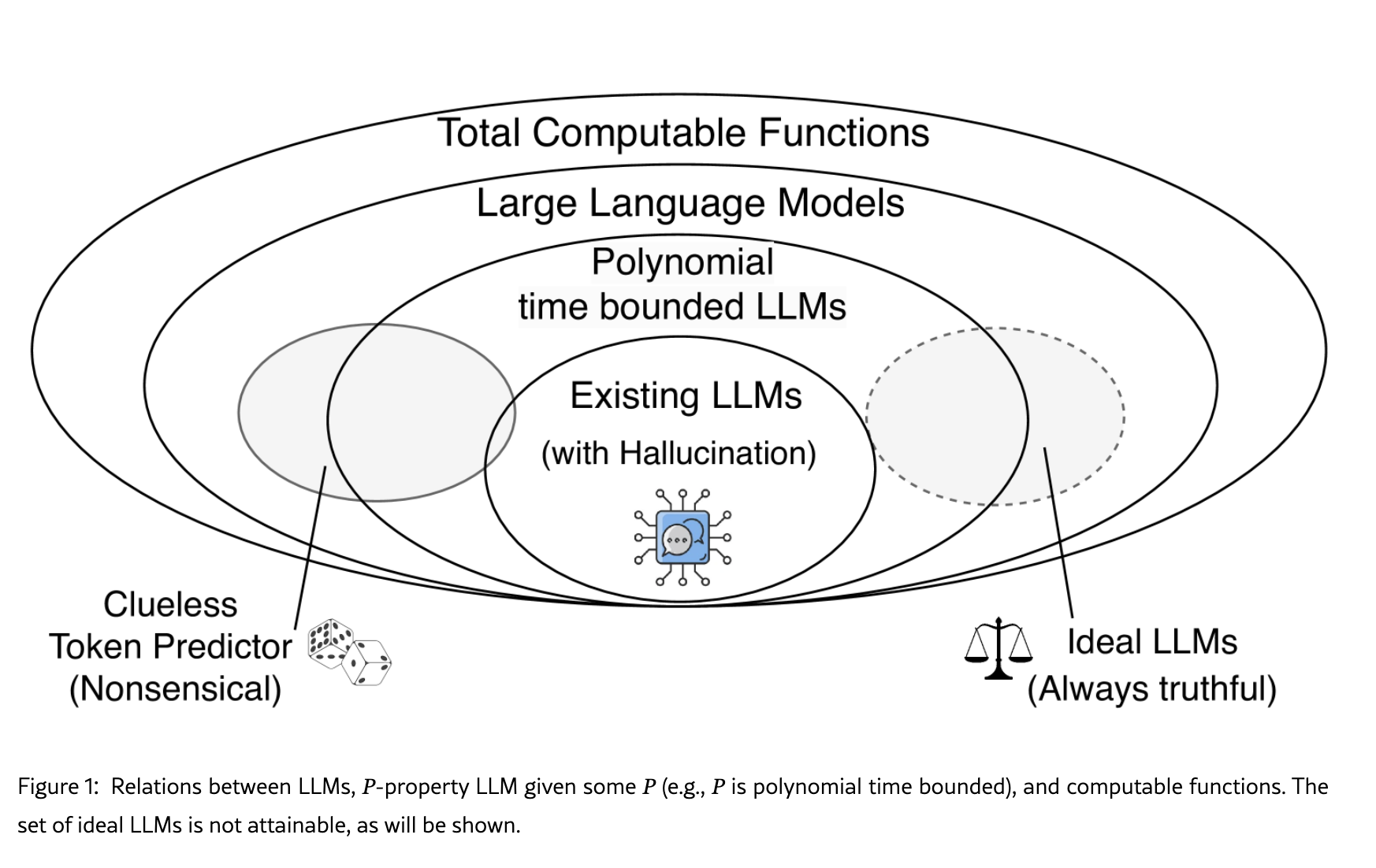

ChatGPTが、事実に基づかない情報をあたかも本当のことであるかのように生成する現象を「ハルシネーション(幻覚)」と呼びます。

これは、AIが学習したデータの中に含まれる誤りや偏り、あるいは文脈を完全に理解できないまま、統計的に最もそれらしい単語の繋がりを予測して文章を生成するために起こります。

ChatGPTは「知らない」と答えるのが苦手で、分からない情報についても何かを補って回答しようとする傾向があるのです。

このハルシネーションの存在こそが、ChatGPTを利用する上でファクトチェックが不可欠である最大の理由です。

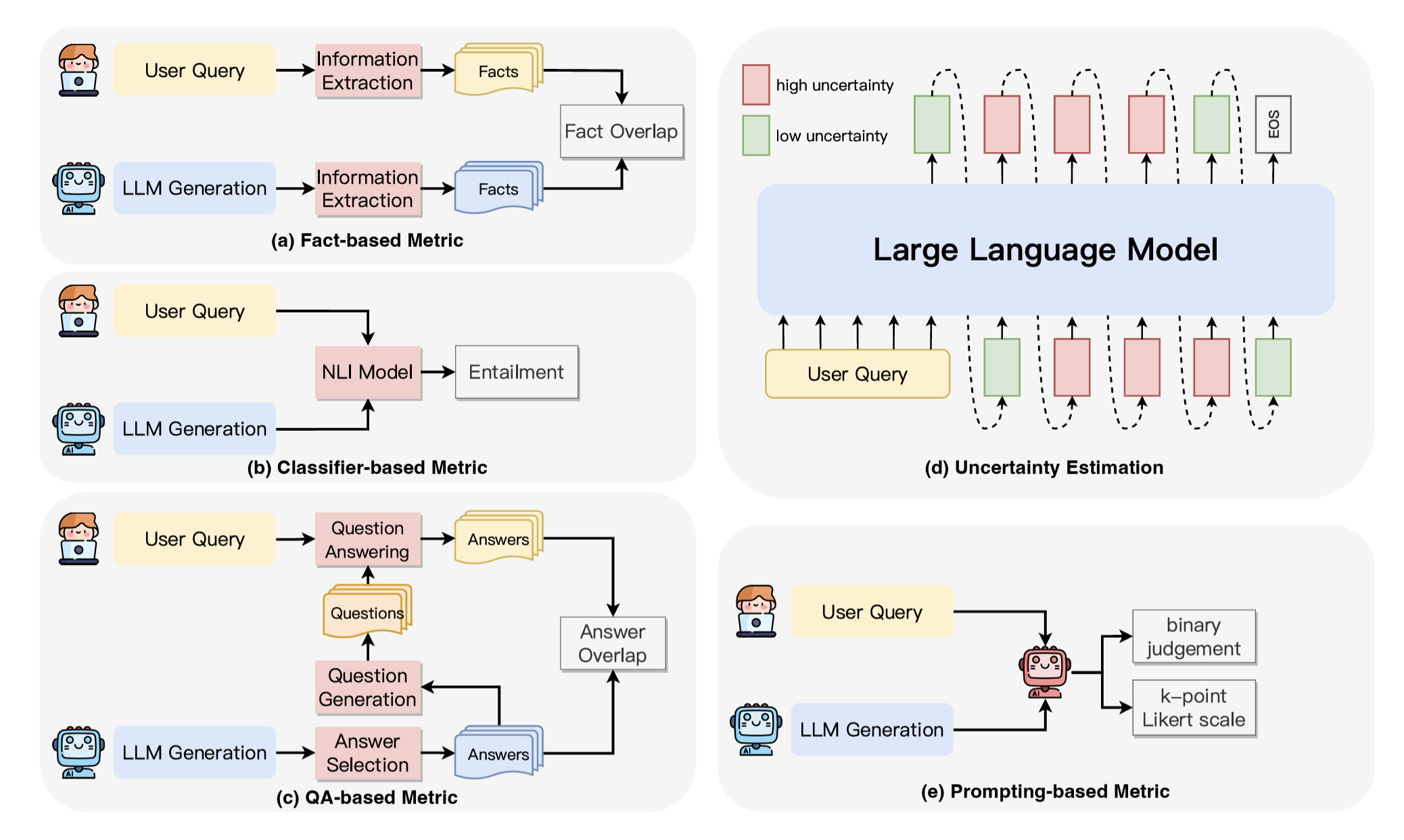

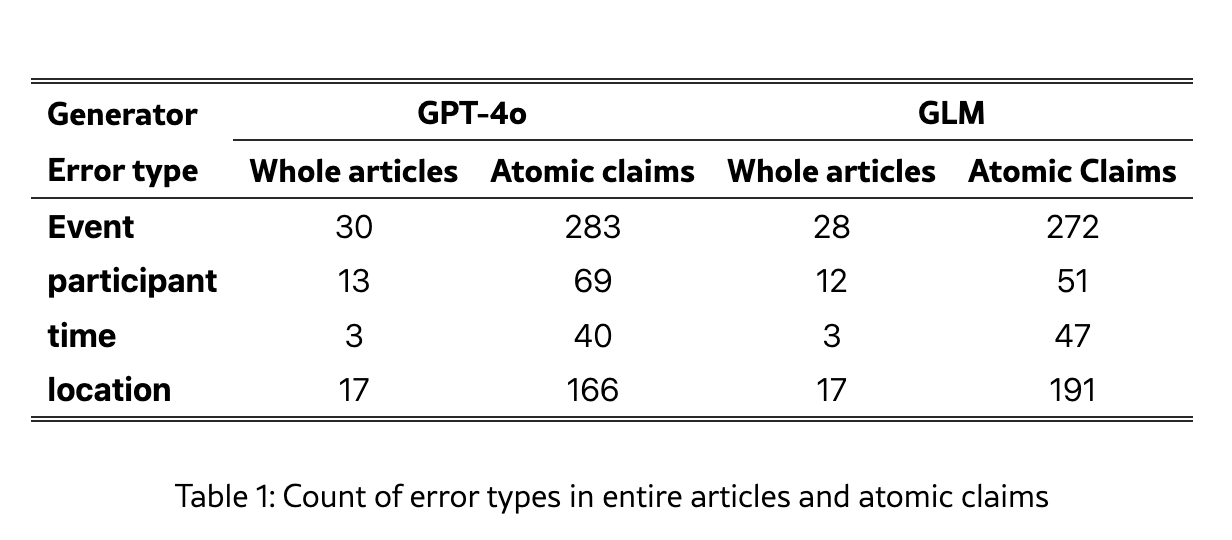

LLMのハルシネーションについて、その原則や分類、課題などを包括的にまとめた調査論文があります。より深く知りたい方は、合わせてご覧ください。 https://arxiv.org/abs/2311.05232

ファクトチェックをせずに情報を鵜呑みにするリスク

ChatGPTが生成した不正確な情報をファクトチェックせずにそのまま利用してしまうと、様々なリスクが生じます。

例えば、ビジネスレポートに誤ったデータを用いてしまい、会社の意思決定を誤らせる可能性があります。また、ブログ記事やSNSで誤情報を発信してしまえば、個人の信頼性や企業のブランドイメージを大きく損なうことにもなりかねません。

最悪の場合、フェイクニュースの拡散に加担してしまい、社会的な混乱を招く一因となることも考えられます。これらのリスクを回避するために、情報の真偽を検証する一手間が非常に重要になるのです。

プロンプトでファクトチェックを効率化する3つのメリット

ChatGPTを活用してファクトチェックを行うことには、多くのメリットがあります。

- 調査にかかる時間を大幅に短縮できる

関連情報を手作業で一つひとつ検索・照合する手間を、ChatGPTが代行してくれます。 - 自分一人では気づきにくい多角的な視点を得られる

プロンプト次第で、賛成意見、反対意見、中立的な立場など、様々な角度から情報を検証させることができます。 - 人間の思い込みや先入観といったバイアスを排除し、客観的な事実確認がしやすくなる

これらのメリットにより、より迅速かつ質の高いファクトチェックが実現します。

【コピペOK】ChatGPTのファクトチェックで使えるプロンプト5選

ここからは、ChatGPTのファクトチェックで今すぐ使える具体的なプロンプトを5つ紹介します。

これらのプロンプトは、様々なシーンで応用できるように汎用性の高いものを選んでいます。ぜひコピー&ペーストして、ご自身の業務や情報収集にお役立てください。

こちらは、ハルシネーション対策にも有効なプロンプトエンジニアリングの手法を網羅的に調査した論文です。合わせてご覧ください。 https://arxiv.org/abs/2407.12994

プロンプト①:情報源や根拠の提示を求める

情報の正しさを判断する上で、その情報が何に基づいているのかを知ることは非常に重要です。

このプロンプトは、文章中の主張やデータの根拠となる情報源をChatGPTに尋ねるために使用します。

信頼性の高い情報源(公的機関の発表、学術論文、信頼できる報道機関など)が提示されれば、その情報の信憑性は高いと判断できます。逆に、情報源が不明確であったり、信頼性に欠ける場合は注意が必要です。

プロンプト例:

以下の文章について、それぞれの主張の根拠となる情報源を、信頼性が高いと思われる順に3つ挙げてください。可能であればURLも記載してください。

#文章 (ここにファクトチェックしたい文章を貼り付け)

プロンプト②:複数の視点から内容を検証させる

一つの情報には、様々な側面や意見が存在することがあります。

このプロンプトは、特定のテーマについて肯定的な視点、否定的な視点、そして中立的な視点から情報を整理させ、多角的に内容を検証するのに役立ちます。

一方的な意見に偏っていないか、見落としている論点はないかを確認することができます。特に、意見が分かれるようなトピックや社会問題について扱う際に有効です。物事を公平に見るための手助けとなります。

プロンプト例:

以下のテーマについて、肯定的な意見、否定的な意見、そして中立的な意見をそれぞれ要約してください。

#テーマ (ここにファクトチェックしたいテーマや文章を貼り付け)

プロンプト③:誤りや矛盾点を指摘させる

文章の中に含まれる事実誤認や、話のつじつまが合わない部分を見つけ出すのは骨の折れる作業です。

このプロンプトを使えば、ChatGPTに文章の校閲者のような役割を与え、誤りや論理的な矛盾点を自動で洗い出させることができます。

自分では気づきにくい細かなミスや、複雑な文章の中での矛盾を発見するのに非常に便利です。レポートや記事を公開する前の最終チェックとしても活用できます。

プロンプト例:

以下の文章を読んで、事実に反する可能性のある記述や、論理的に矛盾している箇所があればすべて指摘してください。

#文章 (ここにファクトチェックしたい文章を貼り付け)

このようにAIに矛盾を指摘させるアプローチは有効ですが、「AIは自分自身が生成した嘘を見抜けるのか」という点も研究されています。ご興味があればご覧ください。 https://arxiv.org/html/2503.18293v1

プロンプト④:客観的な事実のみを抽出させる

文章には、書き手の意見や感想、推測といった主観的な情報が含まれていることがよくあります。

このプロンプトは、そうした主観的な要素を排除し、客観的な事実に基づいた情報だけを抜き出すことを目的としています。

感情的な表現や誇張に惑わされず、情報の中核となる事実だけを正確に把握したい場合に有効です。抽出された事実を元に、自分自身で冷静な判断を下すための材料となります。

プロンプト例:

以下の文章から、筆者の意見や推測、感情的な表現を取り除き、客観的な事実に基づいた情報のみを箇条書きで抽出してください。

#文章 (ここにファクトチェックしたい文章を貼り付け)

プロンプト⑤:情報の鮮度(いつの情報か)を確認させる

情報の価値は、その「新しさ」に大きく左右されることがあります。

特に、テクノロジーや法律、市場の動向など、変化の速い分野では情報がすぐに古くなってしまいます。

このプロンプトは、提示された情報がいつ時点のものなのかを確認し、より新しい情報が存在しないかを尋ねるためのものです。情報が最新のものであるかを確認し、古い情報に基づいて判断してしまうリスクを防ぎます。

プロンプト例:

以下の文章で述べられている内容は、いつ時点の情報に基づいていますか?もし、より新しい関連情報があれば教えてください。

#文章 (ここにファクトチェックしたい文章を貼り付け)

ファクトチェックの精度を飛躍的に高めるプロンプトのコツ

基本的なプロンプトに加えて、いくつかのコツを意識することで、ChatGPTによるファクトチェックの精度をさらに高めることができます。

ここでは、より的確で信頼性の高い回答を引き出すための4つの重要なポイントを紹介します。

指示はより具体的に、明確に伝える

ChatGPTへの指示は、できる限り具体的かつ明確にすることが重要です。

「この記事をチェックして」のような曖昧な指示では、AIは何をすべきか判断できず、精度の低い回答しか得られません。

「この記事に書かれている統計データの出典は正しいか検証してください」や「専門用語の定義に誤りがないか確認してください」のように、何について、どのような観点でチェックしてほしいのかを具体的に伝えましょう。明確な指示が、的確なアウトプットへの近道です。

ChatGPTへ指示を出すプロンプトの基本構造や、より精度の高い回答を引き出すためのコツを解説した記事はこちらです。ぜひ参考にしてください。

一度に検証する文章は短く区切る

手間はかかりますが、文章をテーマごとや段落ごとに短く区切って、一つずつ検証させる方が結果的に精度は高まります。

非常に長い文章を一度にChatGPTに入力してファクトチェックをさせようとすると、重要なポイントが見逃されたり、処理の精度が落ちたりする可能性があります。

特に複雑な内容や重要な文書を扱う場合は、この方法を徹底することをおすすめします。焦らず、段階的に検証を進めましょう。

前提条件や背景情報を提供する

ファクトチェックの対象となる文章の背景(コンテキスト)をChatGPTに提供することで、より文脈に沿った正確な検証が可能になります。

例えば、「これはIT業界の専門家向けのレポートです」といった読者層の情報や、「この会議は新製品Aのマーケティング戦略を決定するためのものです」といった目的を伝えることで、ChatGPTは情報の重要度や適切性をより深く理解することができます。必要な前提条件を最初に伝える一手間が、結果の質を大きく左右します。

最終確認は必ず人間が行う

ChatGPTが提示した情報源が本当に信頼できるか、指摘した矛盾点は妥当かなど、最終的な判断は必ず人間が行う必要があります。

どれだけプロンプトを工夫しても、ChatGPTはあくまでアシスタントツールであり、完璧ではありません。AIによるファクトチェックの結果を鵜呑みにするのは非常に危険です。

AIを便利な壁打ち相手や調査の補助として活用しつつ、最後の砦は自分自身であるという意識を忘れないようにしましょう。

プロンプト以外のファクトチェック方法

プロンプトを工夫する以外にも、ChatGPTの機能を活用したり、外部ツールと組み合わせたりすることで、ファクトチェックの信頼性を高める方法があります。

ここでは、プロンプトエンジニアリング以外の3つの有効なファクトチェック方法をご紹介します。

ブラウジング機能で最新情報を調査させる

ChatGPTの有料プランで利用できるブラウジング機能を使えば、AIがリアルタイムでインターネットを検索し、最新情報に基づいた回答を生成してくれます。

これにより、学習データのカットオフ日以降の出来事や、日々更新される情報についてもファクトチェックが可能になります。特に、ニュース記事や市場のトレンドなど、情報の鮮度が重要なテーマを扱う際に非常に強力なツールとなります。

このブラウジング機能のように外部情報を参照して回答を生成する技術はRAG(検索拡張生成)と呼ばれ、ファクトチェックの精度向上に有効であると評価されています。 https://arxiv.org/abs/2412.15189

専門のファクトチェックツールと併用する

ChatGPTによる検証と、専門ツールによる検証を組み合わせることで、より確実性を高めることができます。

世の中には、Googleの「Fact Check Explorer」のように、ファクトチェックを専門とするツールやウェブサイトが存在します。

これらのツールは、世界中のファクトチェック機関による検証結果を検索できるため、特に社会的に広く拡散されている情報や、真偽が問われているニュースなどの検証に役立ちます。

Googleの「Fact Check Explorer」は、こちらのリンクから利用できます。合わせてご覧ください。 https://toolbox.google.com/factcheck/explorer

提示された情報源を自分で確認する

ChatGPTに情報源を提示させた場合、その情報源を自分自身の目で確認することが極めて重要です。

提示されたURLがリンク切れになっていないか、本当にその情報が記載されているか、そしてその情報源自体(公式サイト、公的機関、権威ある研究機関など)が信頼に足るものかを必ず確認しましょう。

この一手間を惜しまないことが、情報の正確性を担保する上で最も基本的ながら、最も確実な方法です。

【シーン別】ビジネスでのファクトチェック活用事例

ChatGPTを使ったファクトチェックは、ビジネスの様々なシーンで業務の効率化と品質向上に貢献します。

ここでは、具体的な3つの活用事例を取り上げ、どのように役立つかを解説します。

このほか、専門性が高い金融分野の分析などでもLLMの活用が期待されています。こちらの記事では金融分野に特化したLLMについて解説しています。 https://arya.ai/blog/5-best-large-language-models-llms-for-financial-analysis

メディア記事やプレスリリースの公開前チェック

誤情報の発信によるブランドイメージの低下や、炎上といったリスクを未然に防ぐことができます。

オウンドメディアの記事やプレスリリースなど、社外に発信する公式な文章は、企業の信頼性に直結します。公開前にChatGPTでファクトチェックを行うことで、記載されている数値データ、固有名詞、時系列、引用元などに誤りがないかを効率的に確認できます。

会議議事録や報告書の事実確認

ChatGPTでファクトチェックを行うことで、発言内容の要約が正確か、決定事項に抜け漏れがないか、記載された数値データが正しいかなどを客観的に検証できます。

会議の議事録や業務報告書は、社内の情報共有や意思決定の土台となる重要なドキュメントです。関係者間の認識のズレを防ぎ、スムーズな業務遂行をサポートします。

マーケティング資料のデータや引用の裏付け

信頼性の高い、説得力のあるマーケティング資料を作成することが可能になります。

顧客への提案資料や広告コンテンツなど、マーケティング活動で使用する資料の説得力は、その根拠となるデータの正確性に大きく依存します。

資料に使用する市場データ、統計情報、顧客の声、専門家の引用などが最新かつ正確であるかを、ChatGPTを使って裏付け確認することができます。

ChatGPTでファクトチェックする際の注意点と限界

ChatGPTはファクトチェックの強力なサポーターですが、万能ではありません。その注意点と限界を正しく理解した上で利用することが重要です。

最後に、安全かつ効果的に活用するために知っておくべき4つのポイントを解説します。

学習データ自体が間違っている可能性がある

元データには、誤った情報や偏った意見、古い知識などが含まれている可能性があります。

ChatGPTの知識は、学習の元となったインターネット上の膨大なテキストデータに基づいています。

AIは元データに含まれる間違いを「間違い」と認識せずに学習してしまうため、生成される情報にも誤りが含まれるリスクは常に存在します。元データの限界が、そのままAIの限界に繋がることを理解しておく必要があります。

「LLMにとってハルシネーションは避けられない生来の限界である」と論じ、その技術的背景を解説した研究もあります。 https://arxiv.org/abs/2401.11817

最新の情報や専門性の高い情報は苦手

ChatGPTの知識は、特定の時点までに学習したデータに基づいているため、それ以降の最新の出来事については基本的に知りません(ブラウジング機能を使わない場合)。

また、非常にニッチで専門性が高い分野や、ごく限られたコミュニティでしか共有されていない情報については、学習データが不足しているため、正確な回答ができない場合があります。特に、2025年8月にリリースされたGPT-5は思考能力が向上したものの、学習データの範囲を超える知識は生成できない点に注意が必要です。

プロンプトが曖昧だと精度が著しく低下する

これは繰り返しになりますが、非常に重要な注意点です。ChatGPTへの指示(プロンプト)が曖昧であればあるほど、生成される回答の精度は著しく低下します。

「何を」「どのような観点で」「どのように」検証してほしいのかを明確に伝えなければ、期待する結果は得られません。「Garbage In, Garbage Out(ゴミを入れればゴミしか出てこない)」の原則を常に意識し、質の高い指示を心がけることが不可欠です。

機密情報や個人情報は入力しない

セキュリティとプライバシーの観点から、ChatGPTに会社の機密情報や取引先情報、そして個人情報などを絶対に入力してはいけません。

法人向けの専用サービスを利用しない限り、入力したデータがAIの学習に利用され、意図せず外部に漏洩するリスクがあります。ファクトチェックを行う際は、対象の文章から機密情報や個人情報を削除・マスキングしてから入力するなど、細心の注意を払う必要があります。

生成AIを企業で利用する際に潜む様々なリスクと、その具体的な対策については、こちらの記事で詳しく解説しています。

ChatGPTの嘘、見抜けてる?思考停止を招くAIの罠と「賢いファクトチェック術」

ChatGPTが生成した情報を、そのまま信じて使っていませんか?もしそうなら、気づかぬうちにAIによって「思考停止」させられているかもしれません。

スタンフォード大学人間中心AI研究所(HAI)の報告では、大規模言語モデルがもっともらしい嘘(ハルシネーション)を生成し、それが偽情報として拡散するリスクが指摘されています。便利なツールであるはずのAIが、使い方を誤れば、あなたの信頼やビジネスを脅かす危険な存在になり得るのです。この記事では、AIの情報を鵜呑みにする危険性を解説し、AIを「思考を補助する最高のパートナー」に変えるための具体的な検証テクニックを紹介します。

なぜAIは平気で「嘘」をつくのか?

ChatGPTをはじめとするAIは、事実を知っているわけではありません。膨大なデータから、統計的に最も「それらしい」単語の組み合わせを予測して文章を生成しています。そのため、学習データに誤りや偏りが含まれていれば、それを元に堂々と間違った情報を生み出してしまうのです。この「ハルシネーション」はAIの仕組みに根差した問題であり、利用者がその特性を理解しないまま情報を利用することには、以下のようなリスクが伴います。

- ビジネス上の意思決定の誤り:誤ったデータに基づいたレポートで、経営判断を誤る。

- 信用の失墜:誤情報を含むブログ記事やプレスリリースを発信し、個人や企業のブランドを傷つける。

- 偽情報の拡散:意図せずフェイクニュースの拡散に加担し、社会的な混乱を招く。

これらのリスクを回避するためには、AIが生成した情報を疑い、その真偽を確かめる「ファクトチェック」のスキルが不可欠です。AIを単なる答えを出す機械としてではなく、多角的な視点を得るための「壁打ち相手」として活用することが、これからの時代に求められるAIリテラシーと言えるでしょう。

引用元:

スタンフォード大学人間中心AI研究所(HAI)が公開した「AI Index Report 2024」では、AIモデルの信頼性評価の課題や、偽情報生成のリスクについて詳しく言及されています。 https://aiindex.stanford.edu/report/

まとめ

企業が業務効率化のために生成AIの導入を進める中で、ChatGPTなどが生成する情報の不正確さ(ハルシネーション)や、そのファクトチェックにかかる手間が新たな課題となっています。誤った情報を利用すれば、企業の信頼を大きく損なうリスクも少なくありません。

そこでおすすめしたいのが、Taskhub です。

Taskhubは日本初のアプリ型インターフェースを採用し、200種類以上の実用的なAIタスクをパッケージ化した生成AI活用プラットフォームです。

たとえば、プレスリリースの作成や会議議事録の要約、マーケティング資料のデータ裏付けなど、ビジネスシーンに特化した多様な業務を「アプリ」として選ぶだけで、誰でも直感的に信頼性の高いAIアウトプットを得られます。

しかも、Azure OpenAI Serviceを基盤にしているため、データセキュリティが万全で、情報漏えいの心配もありません。

さらに、AIコンサルタントによる手厚い導入サポートがあるため、「社員のAIリテラシーに不安がある」「安全なAIの活用ルールをどう作ればいいかわからない」という企業でも安心してスタートできます。

導入後すぐに効果を実感できる設計なので、複雑なプロンプトエンジニアリングやファクトチェックの専門知識がなくても、すぐに安全な業務効率化が図れる点が大きな魅力です。

まずは、Taskhubの活用事例や機能を詳しくまとめた【サービス概要資料】を無料でダウンロードしてください。

Taskhubで“最速かつ安全な生成AI活用”を体験し、御社のDXを一気に加速させましょう。