「ChatGPTを業務で活用したいけど、どんなデメリットがあるんだろう?」

「情報漏洩などのリスクが心配で、なかなか導入に踏み切れない…。」

こういった悩みや疑問を持っている方も多いのではないでしょうか。

本記事では、ChatGPTに潜む5つの主要なデメリットと、それによって引き起こされる具体的な問題例、そして誰でも実践できる5つの安全対策について詳しく解説します。

生成AIの専門家として、最新の情報を基に、ChatGPTとの安全な付き合い方を分かりやすくお伝えします。

きっとあなたの業務に役立つはずですので、ぜひ最後までご覧ください。

【結論】ChatGPTに潜む5つの主なデメリット

まず結論として、ChatGPTの利用には注意すべきデメリットが存在します。

これらを事前に理解しておくことが、安全な活用のための第一歩です。

- 機密情報や個人情報が漏洩するリスク

- 誤った情報や偏った内容を生成する可能性

- 著作権を侵害してしまう恐れ

- 指示通りに回答しないことがある

- 過信してしまい業務ミスにつながる

これらのデメリットは、ChatGPTの仕組みに起因するものです。

それでは、1つずつ具体的に解説していきます。

デメリット①:機密情報や個人情報が漏洩するリスク

ChatGPTを利用する上で最も注意すべきデメリットが、情報漏洩のリスクです。

デフォルトの設定では、ユーザーが入力した情報がAIの学習データとして利用される可能性があります。

もし、社外秘のプロジェクト情報や顧客の個人情報、パスワードなどを入力してしまうと、それらのデータがChatGPTの知識として蓄積され、他のユーザーへの回答として生成されてしまう危険性があります。

一度インターネット上に流出してしまった情報は、完全に削除することが極めて困難です。

企業の信用問題や法的なトラブルに発展する可能性もあるため、入力する情報には最大限の注意を払わなければなりません。

特に、業務で利用する際には、個人の判断だけでなく、組織全体で情報管理のルールを徹底することが不可欠です。

デメリット②:誤った情報や偏った内容を生成する可能性

ChatGPTが生成する情報は、必ずしも正確であるとは限りません。

AIがもっともらしい嘘の情報を生成してしまう現象は「ハルシネーション」と呼ばれ、大きなデメリットの一つです。

ChatGPTは、インターネット上の膨大なテキストデータを学習していますが、その元データに誤りや偏りが含まれている場合、生成される回答にもそれが反映されてしまいます。

例えば、古い情報や特定の意見に偏った内容、あるいは存在しない事実を、さも真実であるかのように提示することがあります。

これを信じてしまうと、誤った知識を得てしまったり、ビジネス上の重要な意思決定を誤ったりする可能性があります。

ChatGPTから得た情報は、あくまで参考程度に留め、必ず信頼できる情報源で裏付けを取る「ファクトチェック」が欠かせません。

デメリット③:著作権を侵害してしまう恐れ

ChatGPTは、既存の著作物を含む膨大なデータを学習して文章を生成します。そのため、生成されたコンテンツが、意図せず他者の著作物と酷似してしまい、著作権侵害にあたるリスクがあります。

例えば、ブログ記事やレポートの作成を依頼した際に、特定のウェブサイトや書籍の内容とそっくりな文章が出力される可能性があります。

これに気づかず公開・発表してしまうと、盗用や剽窃とみなされ、法的なトラブルに発展しかねません。

特に、生成物を商用利用する場合は、より一層の注意が必要です。

生成されたコンテンツは、必ずオリジナルの表現になっているか、コピペチェックツールなどを活用して確認する作業が重要になります。

安易な利用は、企業のブランドイメージを損なうことにもつながるため、慎重な取り扱いが求められます。

こちらは、ChatGPTの著作権に関するリスクや注意点について解説した記事です。 合わせてご覧ください。

デメリット④:指示通りに回答しないことがある

ChatGPTは非常に高性能ですが、万能ではありません。ユーザーの指示(プロンプト)が曖昧だったり、文脈が複雑すぎたりすると、意図を正確に汲み取れず、見当違いな回答を生成することがあります。

例えば、「もっと良い感じにして」といった抽象的な指示では、AIは何を求められているのか判断できません。

また、複数の条件が絡み合う複雑な質問に対しては、一部の条件を見落としたり、誤って解釈したりすることもあります。

期待通りの回答を得るためには、具体的で、明確な指示を与える「プロンプトエンジニアリング」のスキルが求められます。

ChatGPTが的外れな回答をしたからといって「使えない」と判断するのではなく、どうすれば意図が伝わるかを考え、指示の出し方を工夫することが、このデメリットを乗り越える鍵となります。

こちらは、プロンプトエンジニアリングの基本から活用方法まで解説した記事です。合わせてご覧ください。

デメリット⑤:過信してしまい業務ミスにつながる

ChatGPTの便利さゆえに、その回答を無条件に信じてしまう「過信」は、思わぬ業務ミスを引き起こす危険なデメリットです。

生成される文章は流暢で説得力があるため、内容の真偽を疑うことなく受け入れてしまいがちです。

例えば、ChatGPTが生成したプログラムのコードをレビューせずにそのまま使用し、システムに重大なバグを生じさせてしまうケースが考えられます。

また、生成された市場分析レポートを鵜呑みにして事業計画を立てた結果、大きな損失につながる可能性もあります。

ChatGPTはあくまで業務を補助する「アシスタント」であり、最終的な判断や責任は利用する人間にあります。

生成された内容は必ず自分の目で確認し、批判的な視点を持つことが重要です。

効率化の裏側にあるリスクを常に意識し、ツールに依存しすぎない姿勢が求められます。

【シーン別】ChatGPTのデメリットが引き起こす問題の具体例

ここからは、これまで解説してきたChatGPTのデメリットが、実際のビジネスや個人の活動において、どのような問題を引き起こすのかを具体的なシーンに沿ってご紹介します。

- ビジネスでの利用:顧客対応で誤情報を案内してしまう

- コンテンツ制作:無意識に他者のコンテンツを盗用してしまう

- 情報収集:間違った情報をもとに重要な意思決定をしてしまう

これらの具体例を知ることで、リスクをより現実的なものとして捉え、対策の重要性を理解できるはずです。

ビジネスでの利用:顧客対応で誤情報を案内してしまう

カスタマーサポートの問い合わせ対応にChatGPTを活用するシーンを考えてみましょう。

例えば、顧客からの製品仕様に関する質問に対し、ChatGPTが学習データの古い情報を基に、現在は変更されている仕様を回答してしまう可能性があります。

担当者がその内容をファクトチェックせずにそのまま顧客に伝えてしまった場合、顧客は誤った情報を信じて製品を購入し、後から「話が違う」とクレームに発展するかもしれません。

また、料金プランに関する問い合わせで、誤った金額を案内してしまえば、金銭的なトラブルや企業の信頼失墜に直接つながります。

このように、ChatGPTによる誤情報生成のデメリットは、ビジネスの最前線において顧客との信頼関係を揺るがす重大な問題を引き起こす可能性があるのです。

コンテンツ制作:無意識に他者のコンテンツを盗用してしまう

Webメディアのライターが、記事作成の時間短縮のためにChatGPTを利用するケースです。

あるテーマについて記事の執筆を指示したところ、ChatGPTは学習データの中から複数の既存記事を組み合わせて、非常に質の高い文章を生成しました。

ライターは、その出来栄えに満足し、特に確認することなく記事を公開しました。

しかし後日、記事の一部が特定のブログの文章と酷似していることが発覚し、読者や元の記事の作者から「盗用ではないか」との指摘が殺到しました。

この結果、メディアの信頼性は大きく損なわれ、謝罪や記事の削除といった対応に追われることになります。

著作権侵害というデメリットを軽視した結果、個人のキャリアだけでなく、企業全体のブランドイメージにも傷をつけてしまう典型的な例です。

情報収集:間違った情報をもとに重要な意思決定をしてしまう

ある企業の経営企画担当者が、新規事業の市場調査のためにChatGPTを活用したとします。

「今後5年間で最も成長が期待される市場は?」という質問に対し、ChatGPTは特定の市場について、具体的な成長率の予測データや有望な理由を詳細に回答しました。

担当者はその説得力のある回答を信じ、その情報を基にした事業計画を役員会で提案し、承認されました。

しかし、実際に事業を開始してみると、ChatGPTが示した成長予測は数年前に話題になった古いデータに基づくものであり、現状とは大きく異なっていました。

間違った情報というデメリットが原因で、会社は多額の投資を無駄にし、大きな経営判断のミスを犯してしまいました。

重要な意思決定の根拠として利用する際には、情報の正確性を担保することがいかに重要かを示す事例です。

ChatGPTのデメリットを回避!安全に使うための5つの対策

ここまで解説してきたChatGPTのデメリットは、決して無視できるものではありません。

しかし、適切な対策を講じることで、そのリスクを大幅に軽減し、安全に活用することが可能です。

- 個人情報や社内の機密情報を入力しない

- 生成された情報は必ずファクトチェックする

- 社内での利用ルールを明確に定める

- 入力データを学習させない設定(オプトアウト)を行う

- セキュリティレベルの高いプランやサービスを利用する

これらの対策を実践し、賢くChatGPTと付き合っていきましょう。

それでは、一つずつ詳しく見ていきます。

対策①:個人情報や社内の機密情報を入力しない

情報漏洩のリスクを回避するための最も基本的かつ重要な対策は、そもそも機密性の高い情報を入力しないことです。

これは、個人・法人を問わず、すべてのユーザーが徹底すべき原則です。

具体的には、氏名、住所、電話番号、メールアドレス、クレジットカード番号といった個人情報は絶対に入力してはいけません。

お客様の本サービス利用により当社が受領する個人情報 お客様が本サービスサイトを閲覧し、利用し、又はやりとりする場合、当社は、以下の情報(「技術情報」といいます)を受領します。

・ログデータ:お客様が本サービスを利用する際に、お客様のブラウザ又はデバイスから自動的に送信される情報を取得します。ログデータには、お客様のインターネットプロトコルアドレス、ブラウザの種類及び設定、お客様によるリクエストの日時及びお客様の当社の本サービスにおけるやりとりが含まれます。

・利用データ:当社は、お客様が閲覧又は関与したコンテンツの種類、お客様が利用した機能及びお客様がとった行動、お客様のタイムゾーン、国、アクセスの日時、ユーザーエージェント及びバージョン、コンピュータ又はモバイルデバイスの種類、コンピュータ接続など、お客様の本サービスの利用に関する情報を取得します。

引用元:プライバシーポリシー(個人情報保護方針) | OpenAI

上記の通り、サービス利用時に情報が取得されています。

また、ビジネスで利用する際には、顧客データ、未公開の財務情報、新製品の開発計画、社内システムのIDやパスワードなど、社外秘にあたる情報はすべて入力禁止とすべきです。

「このくらいなら大丈夫だろう」という安易な判断が、重大な情報漏洩につながる可能性があります。

何が機密情報にあたるのかを常に意識し、迷った場合は入力しないという判断を徹底しましょう。

対策②:生成された情報は必ずファクトチェックする

ChatGPTが生成する情報の誤りや偏りによるデメリットを回避するためには、ファクトチェックの徹底が不可欠です。

ChatGPTからの回答は、あくまで「下書き」や「アイデアの種」として捉え、その内容を鵜呑みにしないようにしましょう。

特に、統計データ、歴史的な事実、法律や医療に関する専門的な情報、固有名詞(人名、企業名、製品名など)が含まれている場合は、注意が必要です。

必ず、公的機関のウェブサイト、信頼できる報道機関、専門家の論文、公式サイトなど、一次情報や信頼性の高い情報源にあたって裏付けを取る習慣をつけてください。

この一手間を惜しむと、誤った情報に基づいて行動してしまい、個人的な失敗やビジネス上の損失につながる可能性があります。

最終的な情報の正しさを担保するのは、AIではなく利用者自身であると認識することが重要です。

お客様は、本サービスからのアウトプットを使用又は共有する前に、必要に応じて人による確認を行うなど、お客様のご利用事案に対するアウトプットの正確性と適切性を評価する必要があります。

引用元:利用規約 | OpenAI

対策③:社内での利用ルールを明確に定める

企業や組織としてChatGPTを導入する場合には、全従業員が遵守すべき明確な利用ルール(ガイドライン)を策定することが極めて重要です。

個人のリテラシーに任せるだけでは、セキュリティインシデントやコンプライアンス違反が発生するリスクを防ぎきれません。

ガイドラインには、以下のような項目を盛り込むべきです。

まず、入力してはいけない情報(個人情報、顧客情報、社外秘情報など)の具体的な定義。

次に、利用を許可する業務の範囲。そして、生成物の取り扱い方法(ファクトチェックや著作権確認の義務化など)。

最後に、問題が発生した際の報告手順や相談窓口を明確に定めます。

策定したルールは、研修などを通じて全従業員に周知徹底し、なぜそのルールが必要なのかという背景(デメリットやリスク)も含めて理解を促すことが、形骸化させないためのポイントです。

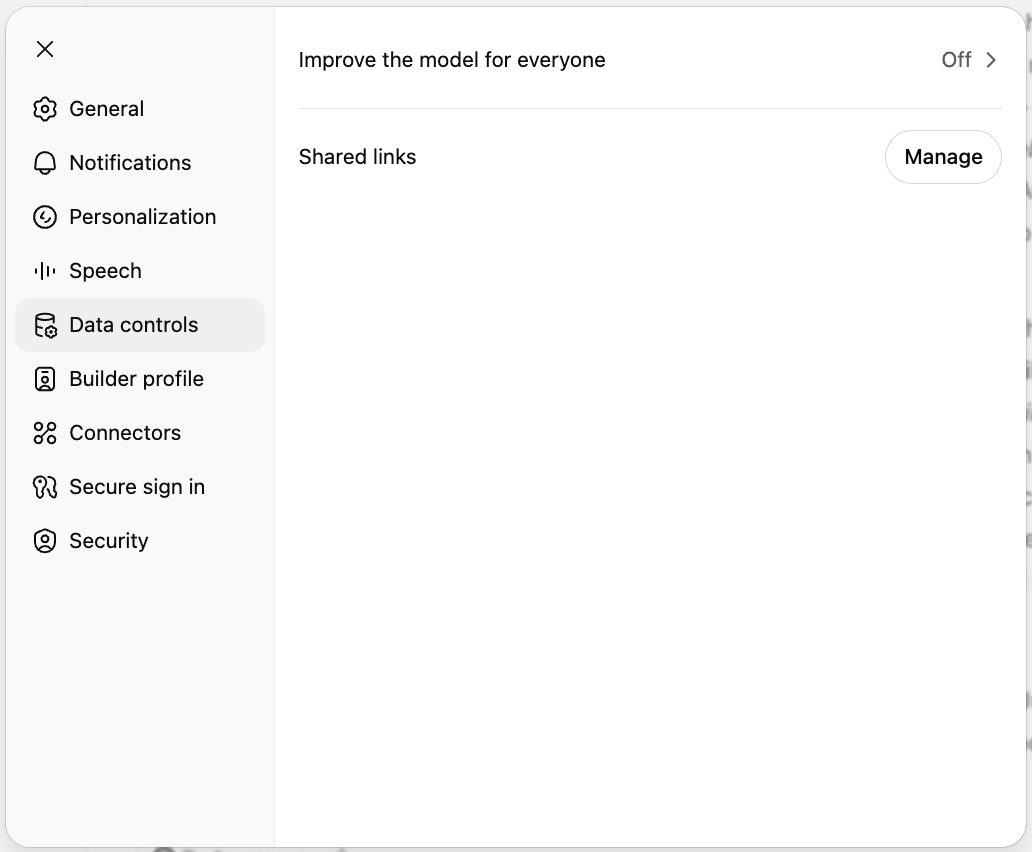

対策④:入力データを学習させない設定(オプトアウト)を行う

ChatGPTには、入力した会話データをAIの学習に利用させないようにする「オプトアウト」という設定が用意されています。

この設定を行うことで、情報漏洩のリスクを低減させることができます。

Web版のChatGPT(無料版およびPlus)では、設定画面にある「Chat history & training」という項目をオフにすることで、以降の会話がAIの学習に使われなくなります。

使用停止(オプトアウト) 当社モデルの学習にお客様の本コンテンツを使用することを望まない場合、このヘルプセンターの記事(新しいウィンドウで開く)の手順に従って使用停止を要求できます。当社の本サービスはお客様の特定の目的にそって処理されるものですが、場合によっては、そのよりよく処理する能力が制限されうることにご留意ください。

引用元:利用規約 | OpenAI

ただし、この設定を有効にすると、過去の会話履歴がサイドバーに保存されなくなるため、その点は理解しておく必要があります。

この設定は、ユーザー自身が能動的に行わなければ適用されません。

特に機密情報を扱う可能性のある業務で利用する際には、まずこの設定を確認・変更することが、基本的なセキュリティ対策となります。

対策⑤:セキュリティレベルの高いプランやサービスを利用する

より高いレベルのセキュリティを求める場合、特に法人での利用においては、有料の法人向けプランやサービスの導入を検討することが有効な対策となります。

代表的なものに「ChatGPT Enterprise」や、Microsoftが提供する「Azure OpenAI Service」があります。

これらのサービスは、入力されたデータがAIの学習に利用されないことが保証されているだけでなく、アクセス管理やデータ暗号化といった高度なセキュリティ機能が備わっています。

そのため、一般的な無料版や個人向け有料版(Plus)に比べて、機密情報をより安全に取り扱うことが可能です。

また、「ChatSense」のような法人向けに特化したサービスを利用することも選択肢の一つです。

これらのサービスは、セキュリティを強化しつつ、業務利用に特化した機能を提供しています。

コストはかかりますが、情報漏洩によって失う企業の信頼や損害を考えれば、重要な投資と言えるでしょう。

デメリットだけじゃない!ChatGPTを賢く活用するメリット

ここまでChatGPTのデメリットとその対策を中心に解説してきましたが、もちろんそれを上回るほどの多くのメリットが存在します。

リスクを正しく理解し、適切に管理することで、ChatGPTは業務の強力なパートナーとなります。

- 情報収集や資料作成の時間を大幅に短縮できる

- 新しいアイデアや企画のヒントを得られる

- 文章作成や翻訳などの業務を効率化できる

デメリットを理解した上で、これらのメリットを最大限に引き出す使い方を見ていきましょう。

情報収集や資料作成の時間を大幅に短縮できる

通常であれば多くの時間と手間がかかる情報収集や資料作成の作業を、ChatGPTは劇的に効率化してくれます。

例えば、特定のテーマに関する情報をインターネット上から探し出して要約させたり、プレゼンテーションの構成案やスライドのテキストを瞬時に作成させたりすることが可能です。

これにより、人間は単純な作業から解放され、より分析的・創造的な、付加価値の高い業務に集中できるようになります。

調査や資料作成の初動にかかる時間を大幅に短縮できる点は、ChatGPTがもたらす最大のメリットの一つと言えるでしょう。

新しいアイデアや企画のヒントを得られる

自分一人で考えていると、どうしても思考が偏ったり、アイデアが行き詰まったりすることがあります。そんな時、ChatGPTは優れた壁打ち相手になってくれます。

新しい商品のキャッチコピーを100個提案してもらったり、イベント企画のアイデアを多角的な視点から出してもらったりと、自分だけでは思いつかないような発想のヒントを得ることができます。

生成されたアイデアをそのまま使うのではなく、それらをたたき台としてさらに思考を深めていくことで、企画の質を大きく向上させることが可能です。

創造性を刺激するツールとして、非常に有効に活用できます。

文章作成や翻訳などの業務を効率化できる

日々の業務で発生する様々なライティングタスクも、ChatGPTを使えば大幅に効率化できます。

例えば、丁寧な表現が求められる取引先へのメール文の作成、長時間の会議の議事録の要約、ブログ記事やプレスリリースの下書き作成などを任せることができます。

また、精度の高い翻訳機能も大きなメリットです。

海外の文献を読んだり、外国語でメールを作成したりする際に、翻訳ツールとして活用することで、言語の壁を越えたコミュニケーションがスムーズになります。

これらの定型的な業務をChatGPTに任せることで、本来注力すべきコア業務に多くの時間を割くことができます。

ChatGPTのデメリットに関するよくある質問

最後に、ChatGPTのデメリットに関して多くの方が抱く疑問について、Q&A形式でお答えします。

- ChatGPTが生成した情報の正確性はどのくらいですか?

- 仕事でChatGPTを使うのは危険ですか?

- 情報漏洩を防ぐための具体的な設定方法はありますか?

これらの疑問を解消し、より安心してChatGPTを活用するための一助となれば幸いです。

ChatGPTが生成した情報の正確性はどのくらいですか?

結論から言うと、ChatGPTが生成する情報の正確性は100%ではありません。

GPT-5のような最新モデルの登場により、その精度は日々向上していますが、誤った情報を生成する「ハルシネーション」のリスクが完全になくなったわけではありません。

特に、2023年以降の最新の出来事や、非常に専門性の高いニッチな分野、刻々と変化する情報(株価や法律など)については、情報が古かったり、不正確だったりする可能性が高くなります。

そのため、ChatGPTが提示する情報を絶対的な事実として捉えるのは危険です。

重要な情報であればあるほど、必ず信頼できる情報源でのファクトチェックを行うことが不可欠です。

仕事でChatGPTを使うのは危険ですか?

「無防備に使うと危険ですが、ルールを守れば非常に有用なツールになる」というのが答えです。

本記事で解説したようなデメリット、特に情報漏洩や著作権侵害、誤情報といったリスクを理解せず、何の対策も講じないまま仕事で使うのは非常に危険です。

しかし、会社のガイドラインに従い、「機密情報を入力しない」「生成された情報は必ずファクトチェックする」といった基本的なルールを徹底すれば、危険性を大幅に下げることができます。

リスクを正しく管理することで、業務効率を飛躍的に向上させる強力な味方になります。

危険かどうかは、ツールそのものではなく、利用者の使い方次第と言えるでしょう。

情報漏洩を防ぐための具体的な設定方法はありますか?

はい、あります。最も手軽な方法は、入力データをAIの学習から除外する「オプトアウト」設定を行うことです。

ChatGPTのウェブサイトにログイン後、設定(Settings)を開き、「Data controls」の中にある「Chat history & training」のトグルをオフにしてください。https://help.openai.com/en/articles/7730893-data-controls-faq

これにより、あなたの会話データがOpenAIのモデル学習に使われるのを防ぐことができます。

ただし、この設定をすると会話履歴が残らなくなる点には注意が必要です。

より高度なセキュリティを求める法人利用の場合は、入力データがデフォルトで学習に使われない「ChatGPT Enterprise」プランや、API経由での利用を検討することをおすすめします。

あなたの会社は大丈夫?ChatGPT導入で「失敗する企業」の3つの共通点

ChatGPTの導入を急ぐあまり、かえって業務効率を下げてしまったり、思わぬトラブルを招いてしまったりする企業が後を絶ちません。実は、その失敗にはいくつかの共通したパターンが存在します。スタンフォード大学の研究では、AIツールの導入効果は、組織の準備度や従業員のリテラシーに大きく左右されることが示唆されています。この記事では、ChatGPT導入で失敗する企業に見られる3つの共通点を、具体的な対策とともに解説します。自社が当てはまっていないか、ぜひチェックしてみてください。

失敗する企業の共通点①:目的意識のない「とりあえず導入」

最も多い失敗パターンが、「流行っているから」「競合が導入したから」といった理由だけで、明確な目的なく導入してしまうケースです。これでは、従業員は何のために使えば良いのか分からず、結局一部の人が物珍しさで使うだけで定着しません。結果として、「思ったより使えない」という結論に至りがちです。AIはあくまで課題解決のための手段です。まずは「どの業務の、どの部分を、どのように効率化したいのか」という目的を具体的に設定することが、成功への第一歩となります。

失敗する企業の共通点②:リスク管理の丸投げ

ChatGPTには情報漏洩や誤情報、著作権侵害といった無視できないリスクが伴います。失敗する企業は、これらのリスクに対する具体的なルールを定めず、従業員の良識やITリテラシーに丸投げしてしまいます。その結果、ある日突然、社員が顧客情報を入力してしまったり、AIが生成した誤った情報を外部に発信してしまったりといった重大なインシデントが発生する可能性があります。利用を許可する業務範囲の定義、入力禁止情報のリスト化、生成物のチェック体制など、組織としての明確なガイドライン策定と周知徹底が不可欠です。

失敗する企業の共通点③:「AI任せ」で思考停止に陥る

便利なツールであるほど、私たちはそれに依存し、考えることをやめてしまう傾向があります。失敗する企業では、従業員がChatGPTの出す答えを鵜呑みにし、自ら考えることやファクトチェックを怠るようになります。AIはあくまでアシスタントであり、最終的な判断と責任は人間が負うべきです。AIからの提案を「たたき台」として活用し、そこからさらに思考を深め、独自の付加価値を生み出す姿勢がなければ、個人の成長も企業の成長も望めません。

引用元:

Brynjolfsson, E., & Mitchell, T. (2017). “What can machine learning do? Workforce implications.” Science, 358(6370), 1530-1534. この研究では、AI技術が人間のスキルを代替するだけでなく補完する可能性に言及し、導入成功には組織的な対応が重要であると論じている。

まとめ

企業はChatGPTをはじめとする生成AIを業務効率化やDX推進の切り札として注目しています。

しかし、本記事で解説したように、情報漏洩や誤情報、著作権侵害といったデメリットや、従業員がうまく使いこなせないといった課題があり、導入に踏み切れずにいる企業も少なくありません。

そこでおすすめしたいのが、Taskhubです。

Taskhubは日本初のアプリ型インターフェースを採用し、200種類以上の実用的なAIタスクをパッケージ化した生成AI活用プラットフォームです。

たとえば、メール作成や議事録作成、画像からの文字起こし、さらにレポート自動生成など、さまざまな業務を「アプリ」として選ぶだけで、誰でも直感的にAIを活用できます。

しかも、Azure OpenAI Serviceを基盤にしているため、データセキュリティが万全で、情報漏えいの心配もありません。

さらに、AIコンサルタントによる手厚い導入サポートがあるため、「何をどう使えばいいのかわからない」という初心者企業でも安心してスタートできます。

導入後すぐに効果を実感できる設計なので、複雑なプログラミングや高度なAI知識がなくても、すぐに業務効率化が図れる点が大きな魅力です。

まずは、Taskhubの活用事例や機能を詳しくまとめた【サービス概要資料】を無料でダウンロードしてください。

Taskhubで“最速の生成AI活用”を体験し、御社のDXを一気に加速させましょう。