「生成AIを業務に導入したいけど、情報漏洩や著作権侵害が心配…。」

「社員に自由に利用させたいけど、リスクをどう管理すればいいかわからない。」

このような悩みを抱えている企業は少なくありません。

生成AIの活用は、業務効率化や生産性向上に直結する一方で、予期せぬリスクも伴います。

そこで重要になるのが、企業全体で安全かつ効果的に生成AIを利用するための「社内規定」の策定です。

本記事では、生成AIの社内規定を策定する際の具体的な手順から、盛り込むべき項目、さらには他社の成功事例や無料で使える雛形までを網羅的に解説します。

この記事を読めば、あなたの会社に最適な生成AIの社内規定をスムーズに作成できるようになるでしょう。

ぜひ最後までご覧ください。

そもそも生成AIの社内規定(ガイドライン)とは?

ここからは、生成AIの社内規定の基本的な考え方について解説します。

社内規定は、企業が生成AIを安全に利用するための基盤であり、企業の成長と安全を守る上で不可欠なものです。

生成AIの社内規定は企業の成長と安全を守るルールブック

生成AIの社内規定(ガイドライン)とは、企業が生成AIツールを業務で利用する際に、社員が遵守すべきルールや利用方針を定めたものです。

これにより、社員は安心してAIを活用できるだけでなく、企業は情報漏洩や著作権侵害といった潜在的なリスクを未然に防ぐことが可能になります。

たとえば、社員がChatGPTのような生成AIに社内の機密情報や個人情報を入力してしまうと、その情報が学習データとして利用され、意図しない形で外部に流出するリスクがあります。

このような事態を防ぐために、「入力してはいけない情報」や「生成物の確認方法」などを具体的に定めておくのが社内規定です。

また、生成AIを業務に積極的に取り入れることで生産性向上を目指す一方で、企業としての責任を果たすための「守りのルール」としても機能します。

社内規定を策定することは、単なるリスク回避策ではありません。

生成AIの安全な活用を促し、社員一人ひとりのAIリテラシーを高め、結果として企業の成長を加速させるための戦略的な取り組みと言えるでしょう。

社内規定とガイドラインの違い

生成AIの利用ルールを定める際、「社内規定」と「ガイドライン」という言葉がよく使われます。

この2つの言葉は混同されがちですが、厳密には以下のような違いがあります。

社内規定は、一般的に企業の就業規則や服務規律に紐づく、強制力を持つ正式なルールです。

違反した場合には、社内規定に基づいた罰則が科される可能性があります。

一方、ガイドラインは、社員が生成AIを適切に利用するための指針や推奨事項を示すものです。

法的拘束力はありませんが、具体的な活用方法や注意点を分かりやすく示し、社員の行動を促す目的で策定されます。

多くの企業では、まず法的・倫理的リスクを管理するための基本的なルールを「社内規定」として策定し、

その上で、より実践的な活用方法や好事例を「ガイドライン」として補足するケースが増えています。

どちらも企業にとって重要ですが、法的拘束力の有無を理解して使い分けることが大切です。

なぜ今、生成AIの社内規定策定が重要なのか?

生成AIは、現代のビジネスにおいて不可欠なツールになりつつあります。

しかし、その導入にあたっては、社内規定の策定が急務です。

ここでは、社内規定策定がなぜこれほどまでに重要視されているのか、その理由を3つの視点から解説します。

社員が安心して生成AIを活用できるようになるため

生成AIの導入が進む一方で、社員の中には「何を入力していいのかわからない」「生成した文章を使って問題ないか不安」といった漠然とした不安を抱える人も少なくありません。

こうした不安は、せっかく導入したツールの利用を妨げ、生産性向上の機会を失わせてしまいます。

明確な社内規定があれば、社員は「この範囲なら自由に利用して良い」「この情報は入力してはいけない」といった判断基準を持つことができます。

これにより、安心して生成AIを業務に組み込むことが可能となり、自律的な活用が促進されます。

また、ルールを定めることで、社員はツールの特性やリスクについて学ぶきっかけとなり、自然とAIリテラシーの向上にもつながります。

社内規定は、社員が生成AIを使いこなすための道しるべとなり、企業のDXを加速させる上で不可欠な役割を担います。

法的・倫理的リスクから企業を守るため

生成AIの利用は、情報漏洩や著作権侵害といった深刻な法的・倫理的リスクと隣り合わせです。

たとえば、社員が顧客の個人情報や会社の機密情報をAIに入力してしまい、それが意図せず外部に流出する可能性があります。

また、AIが生成したコンテンツが、既存の著作物と酷似しており、著作権侵害にあたるリスクも無視できません。

こうした事態が発生した場合、企業は社会的な信用の失墜だけでなく、多額の損害賠償や法的措置に直面する可能性があります。

社内規定は、このようなリスクを未然に防ぐためのセーフティネットです。

機密情報の取り扱い方や、生成物のファクトチェックの義務、著作権侵害の禁止などを明文化することで、社員の行動を適切に管理し、企業全体のリスクを最小限に抑えることができます。

特に、ビジネスにおけるコンプライアンスが厳格化している現代において、法的・倫理的リスクへの備えは、企業の存続に関わる重要な課題です。

生産性向上を最大化するため

生成AIは、単純作業の自動化から、新しいアイデアの創出、データ分析まで、幅広い業務で生産性を飛躍的に向上させる可能性を秘めています。

しかし、社員がそれぞれ勝手な方法で利用を始めると、かえって非効率になったり、ツールの乱立による管理コストが増加したりする恐れがあります。

社内規定で、どの部署でどのような目的でAIを利用するか、どのツールを推奨するかを明確にすることで、企業全体の生産性向上を戦略的に進めることができます。

例えば、カスタマーサポート部門では顧客対応の自動化に特化し、マーケティング部門ではコンテンツ作成を効率化するなど、各部門の業務に合わせた最適な活用方法を定めることが重要です。

また、社内規定を通じて成功事例を共有する仕組みを構築すれば、部署や社員間でノウハウが横展開され、企業全体のAI活用レベルが底上げされます。

結果として、生成AIの持つポテンシャルを最大限に引き出し、企業の競争力強化につながります。

生成AIの社内規定を作成する3つのメリット

生成AIの社内規定を策定することは、企業に様々なメリットをもたらします。

ここでは、特に重要な3つのメリットについて詳しく解説します。

メリット①:情報漏洩などのセキュリティリスクを未然に防ぐ

生成AIの利用において最も懸念されるのが、情報漏洩のリスクです。

不注意や知識不足から、社員が顧客情報や社内プロジェクトの機密情報などをAIに入力してしまうと、取り返しのつかない事態に発展する可能性があります。

社内規定で「入力禁止情報」を具体的に定義し、その取り扱いについて明確なルールを定めることで、こうしたセキュリティリスクを未然に防ぐことができます。

例えば、

・顧客の個人情報(氏名、住所、電話番号など)

・未公開の財務情報や事業計画

・開発中の製品の仕様やソースコード

・他社とのNDA(秘密保持契約)に関わる情報

などを入力してはならないと明記します。

さらに、生成AIツールそのもののセキュリティレベル(データの保存場所、暗号化の有無など)についても規定に盛り込むことで、より強固なセキュリティ体制を構築できます。

これにより、社員は安全な範囲でAIを利用できるようになり、企業は安心してデジタルトランスフォーメーションを進めることが可能です。

ChatGPTの企業向け導入における料金、セキュリティ、活用事例については、こちらのガイドで詳しく解説しています。 合わせてご覧ください。 https://taskhub.jp/useful/chatgpt-for-companies/

メリット②:社員のAIリテラシーが向上し生産性がアップする

社内規定の策定プロセスは、社員が生成AIについて学び、理解を深める絶好の機会です。

規定の周知や研修を通じて、社員はツールの正しい使い方、リスク、そして最大限に活用するためのコツを習得できます。

この過程で社員のAIリテラシーが向上し、単にツールを使うだけでなく、業務にどう活かすかを自ら考えられるようになります。

例えば、単純な文章作成だけでなく、要約、ブレインストーミング、データ分析など、様々な用途で生成AIを活用するスキルが身につきます。

これにより、個々の業務効率が大幅に改善され、企業全体の生産性向上につながります。

また、AIリテラシーが高まることで、社員は新しい技術への抵抗感が薄れ、今後登場する最新技術も積極的に取り入れようとする文化が醸成されるでしょう。

メリット③:明確なルールで社員が積極的に生成AIを利用するようになる

ルールがない状態では、「もし何かあったらどうしよう…」という不安から、社員は生成AIの利用に二の足を踏みがちです。

しかし、明確な社内規定があれば、社員は安心してAIを活用できます。

「この範囲なら使っても良い」という許可の線引きが明確になることで、心理的なハードルが下がり、積極的に業務に取り入れることが可能になります。

例えば、「マーケティング部門はブログ記事の草案作成に利用可能」「人事部門は採用メールのテンプレート作成に利用可能」といった形で、利用範囲を具体的に示すことで、社員は迷うことなく業務に取りかかれます。

また、社内規定に成功事例を盛り込むことで、他の社員も「こんな使い方ができるのか!」と刺激を受け、社内全体でAI活用の機運が高まります。

これにより、生成AIのポテンシャルを最大限に引き出し、企業全体のイノベーションを加速させることができるのです。

【要注意】生成AIの社内規定がない場合に潜むリスクと事故事例

社内規定がない状態で生成AIを安易に利用すると、企業は様々なリスクに直面します。

ここでは、特に注意すべき3つのリスクと、実際に起きた事故事例について解説します。

これらのリスクを理解することが、適切な社内規定を策定するための第一歩となります。

リスク①:機密情報や個人情報の漏洩

社内規定がない場合、社員は機密情報や個人情報を不用意に生成AIのシステムに入力してしまう可能性があります。

多くの生成AIツールは、ユーザーが入力したデータを学習データとして利用する場合があります。

この際、機密情報や顧客の個人情報などが含まれていると、それが他のユーザーへの応答に反映されてしまうリスクがあります。

これにより、企業の競争力を左右する情報や、保護すべき個人情報が外部に漏洩し、企業の信用失墜や法的責任を問われる事態に発展する恐れがあります。

リスク②:著作権や商標権の侵害

生成AIが生成したコンテンツが、既存の著作物と酷似している場合、意図せず著作権を侵害してしまうリスクがあります。

たとえば、AIに特定の画風や文章スタイルを要求した場合、既存の作品に極めて似たものが生成される可能性があります。

また、商標権を侵害するようなロゴやデザインが生成され、それを商用利用してしまうと、法的な問題に発展する可能性があります。

社内規定がない場合、社員が生成物の著作権や商標権について意識することなく利用し、結果として企業が訴訟リスクにさらされることになります。

リスク③:不正確・差別的な情報の生成と拡散

生成AIは、時に不正確な情報や、偏見に基づいた差別的な内容を生成することがあります。

これを「ハルシネーション(Hallucination)」と呼びます。

社内規定でファクトチェックの義務を定めない場合、社員は生成された情報を鵜呑みにしてしまい、誤った情報を社内外に拡散してしまうリスクがあります。

例えば、顧客への回答やプレスリリースに不正確な情報が含まれていた場合、企業の信頼は大きく損なわれます。

また、AIが生成した差別的なコンテンツを社員が不用意に利用した場合、企業の倫理観が問われる事態に発展する可能性があります。

こちらはAIのハルシネーションを防ぐ方法について解説した記事です。 合わせてご覧ください。 https://taskhub.jp/use-case/chatgpt-prevent-hallucination/

【事故事例】大手電子メーカーで機密のソースコードが流出

2023年、大手電子メーカーの社員が、業務効率化のためにChatGPTに社内の機密情報を含むソースコードを入力し、その情報が流出したという事故事例が報道されました。

この企業は、生成AIの利用に関する明確な社内規定を定めておらず、社員はリスクを認識しないまま機密情報を入力してしまったと考えられます。

この事件は、社内規定がないことの危険性を社会に広く知らしめるきっかけとなりました。

この事態を受け、多くの企業が生成AIの利用に関するルール策定を急ぐこととなりました。

【事故事例】弁護士が実在しない判例を誤って提出

米国では、AIが生成した「架空の判例」を信じて、弁護士が裁判所に提出してしまった事故事例が報告されています。

この弁護士は、訴訟準備のために生成AIを利用し、AIが生成した存在しない判例をそのまま引用して裁判書類を作成しました。

判例の真偽を自分で確認しなかったことが原因です。

この事態は裁判所から厳しく指摘され、弁護士の倫理観が問われる問題となりました。

この事例は、生成された情報の「ファクトチェック」がいかに重要であるかを示しています。

特に専門性の高い業務では、AIの出力を安易に信用せず、必ず人間が最終確認を行うというルールが不可欠です。

【5ステップ】生成AIの社内規定の作り方と策定フロー

生成AIの社内規定を策定する際は、以下の5つのステップに沿って進めることで、スムーズかつ効果的に作成できます。

各ステップを丁寧に踏むことが、社員に受け入れられ、実効性のある規定を作る上で重要です。

Step1:利用目的と基本方針を明確化する

まず、なぜ生成AIの社内規定が必要なのか、その目的と基本方針を明確に定義します。

「生産性向上とセキュリティの両立」「社員のAIリテラシー向上」「機密情報の保護」など、具体的な目標を設定しましょう。

この基本方針は、規定の全項目に一貫性を持たせるための羅針盤となります。

経営層や主要部門の責任者と事前に議論し、全社的なコンセンサスを得ることが重要です。

このステップを省略すると、後々のプロセスで目的がブレてしまい、形骸化した規定になるリスクがあります。

Step2:部門横断でプロジェクトチームを編成する

次に、規定策定のためのプロジェクトチームを編成します。

このチームは、法務、情報システム、人事、そして実際にAIを利用する現場部門(営業、マーケティング、開発など)からメンバーを集めることが理想的です。

法務は法的リスク、情報システムはセキュリティ、人事は社員への影響、現場部門は実務的な視点から、それぞれの専門知識を持ち寄ることで、多角的な視点から網羅性の高い規定を作成できます。

また、異なる部門の意見を反映させることで、規定が特定の部署に偏らず、全社的に受け入れられやすくなります。

Step3:雛形(テンプレート)を参考に草案を作成する

プロジェクトチームで、生成AIの社内規定の草案を作成します。

この際、ゼロから全てを考えるのではなく、公開されている雛形やテンプレートを参考にすると効率的です。

経済産業省や日本ディープラーニング協会(JDLA)などが提供するガイドラインは、法的・倫理的な観点から網羅的に作成されており、ベースとして非常に役立ちます。

これらの雛形を参考に、自社の基本方針に沿った形で項目の洗い出しを行い、最初のドラフトを作成します。

この段階では、細部にこだわりすぎず、まずは全体像を固めることを優先しましょう。

Step4:自社の状況に合わせて内容をカスタマイズする

草案ができたら、それを自社のビジネスモデルや組織文化、利用するツールの種類に合わせてカスタマイズします。

例えば、機密性の高い情報を扱う企業であれば、入力禁止情報の定義をより厳格にする必要があります。

また、開発部門が主要なAIユーザーである場合は、ソースコードの取り扱いに関する規定を詳細に盛り込む必要があるでしょう。

各部門の代表者や社員からフィードバックを募り、現実的な運用が可能か、内容に漏れがないかを最終確認します。

この過程で、規定を一方的に押し付けるのではなく、社員と一緒に作り上げるという意識を持つことが、その後の定着率を高める上で重要です。

Step5:全社へ周知し、定期的な見直しを行う

策定した社内規定は、全社員に周知徹底します。

社内ポータルサイトへの掲載、全社員向けのメール、研修会の実施など、複数のチャネルを使って繰り返し周知しましょう。

ただ情報を伝えるだけでなく、規定の背景にある意図や目的を丁寧に説明することで、社員の理解と協力を得やすくなります。

また、生成AI技術は日々進化するため、規定も一度作ったら終わりではありません。

最低でも年に一度、または新しいツールを導入する際など、定期的に内容を見直し、最新の状況に合わせてアップデートする体制を整えておくことが不可欠です。

生成AIの社内規定に盛り込むべき必須項目7選

実効性のある生成AIの社内規定を作成するためには、以下に挙げる7つの必須項目を網羅的に盛り込むことが重要です。

これらの項目は、リスク管理と活用促進の両面から、バランスの取れた規定を構成する上で不可欠です。

①:利用を許可/禁止する用途・業務範囲の明記

生成AIの利用をどの業務や部署で許可し、どこで禁止するかを明確に定義します。

例えば、「広報部門はプレスリリースの草稿作成に利用可能」「財務部門は未公開の財務データの分析には利用禁止」といった形で、具体的に記載します。

これにより、社員は安心してAIを活用でき、企業はリスクを最小限に抑えつつ、戦略的にAIを導入できます。

②:入力してはいけない情報(機密情報・個人情報など)の定義

最も重要な項目の一つです。

社外秘のプロジェクト情報、顧客の氏名や連絡先、社員の個人情報など、AIに入力してはならない情報を具体的に列挙します。

これらの情報が漏洩した場合の重大なリスクを社員に周知し、規定違反が発見された場合の対応策も明記しておきましょう。

③:生成物の利用時(ファクトチェックなど)の注意点

AIが生成した情報には誤り(ハルシネーション)が含まれる可能性があることを明確に伝えます。

生成物の利用に際しては、必ず社員が内容の正確性を確認(ファクトチェック)し、最終的な責任は利用者が負うことを規定に盛り込みます。

これにより、不正確な情報が社内外に拡散するリスクを防ぎます。

④:著作権や倫理に関する遵守事項

生成AIが生成したコンテンツの著作権や、他者の知的財産権を侵害しないためのルールを定めます。

「生成物の商用利用には注意を払う」「既存の著作物に酷似したものを利用しない」といった具体的な注意点を記載します。

また、差別的・不快なコンテンツを生成・利用しないといった倫理的な観点も盛り込むことが重要です。

⑤:違反した場合の罰則規定

規定を実効性のあるものにするために、違反した場合の罰則を明確に定めます。

例えば、軽微な違反の場合は注意喚起、悪質な違反の場合は懲戒処分など、違反の程度に応じた措置を明記します。

ただし、罰則規定は社員の利用を萎縮させないよう、脅威を与えるものではなく、あくまでもルールを守るための抑止力として機能するように配慮が必要です。

⑥:社内の利用申請フローや相談窓口

社員が新しい生成AIツールを利用したい場合や、利用に関して疑問や不安を抱いた場合に、誰に相談すればよいかを明確にします。

例えば、「新しいツールの導入には情報システム部門の承認が必要」といった申請フローや、規定に関する質問を受け付ける相談窓口(担当部署やメールアドレスなど)を設けることで、社員は安心して利用を継続できます。

⑦:ツールの利用状況のモニタリングに関する規定

企業が社員の生成AI利用状況をモニタリングする可能性があることを明記します。

これにより、不正利用の抑止力となるだけでなく、どの部門でAIが活発に利用されているか、どのような課題があるかを把握し、今後のAI戦略に活かすことができます。

ただし、モニタリングはプライバシーに配慮し、透明性を持って行うことを明確に伝える必要があります。

生成AIの社内規定策定で参考にしたい企業事例5選

実際に生成AIの社内規定を策定し、成功を収めている企業の事例は、自社の規定を作る上で非常に参考になります。

ここでは、特に優れた5つの企業事例を紹介します。

事例①:パーソルHD|「社内利用」と「プロダクト開発」で分離

パーソルホールディングスは、生成AIの利用ガイドラインを「社内利用」と「プロダクト開発」の2つに分けて策定しました。

これにより、社員が業務効率化のためにAIを利用する際のルールと、顧客向けのサービス開発にAIを組み込む際のルールを明確に区別しています。

この分離策は、それぞれの目的とリスクに応じて最適なルールを適用することを可能にし、安全性を確保しつつ、イノベーションを加速させています。

特に、顧客向けプロダクト開発では、データの取り扱いや著作権についてより厳格なルールを設けています。

事例②:日清食品|具体的な活用事例とリスク管理を両立

日清食品は、生成AIの利用ガイドラインを公開し、その中で具体的な活用事例を豊富に紹介しています。

例えば、「新商品のネーミング案作成」「プレゼン資料の構成作成」など、社員がすぐに実践できるアイデアを提示することで、利用を促進しています。

一方で、「機密情報の入力禁止」や「生成物の最終確認の義務」といったリスク管理のルールも明確に示しており、活用とリスク管理を高いレベルで両立させている点が特徴です。

事例③:パナソニックコネクト|全社員参加でリスクと活用法を議論

パナソニックコネクトは、生成AIの社内ガイドラインを策定する際、全社員が参加するワークショップやアンケートを実施しました。

これにより、現場のリアルな声やニーズを反映させると同時に、社員一人ひとりがガイドラインの意義を自分事として捉える文化を醸成しました。

トップダウンでルールを押し付けるのではなく、ボトムアップで作り上げるアプローチは、社員のエンゲージメントを高め、ガイドラインの定着率を飛躍的に向上させます。

事例④:ベネッセ|教育利用を前提とした詳細なガイドライン

教育サービスを提供するベネッセは、教育分野での生成AI利用を前提とした詳細なガイドラインを策定しています。

特に、生徒や保護者の個人情報保護、コンテンツの信頼性確保について厳格なルールを設けています。

例えば、「生成AIに生徒の個人情報を入力しない」「生成した文章は、教育的な観点から必ず教員が内容を吟味する」といった具体的な規定は、教育業界ならではの課題に対応したものです。

各業界の特性に応じたルール設定の重要性を示唆しています。

事例⑤:GMOペパボ|エンジニア向けに特化した利用ガイドライン

GMOペパボは、主にエンジニア向けの利用ガイドラインを策定しています。

ソースコードの生成やデバッグに生成AIを利用する際の注意点、セキュリティ対策、著作権に関するルールなどを詳細に定めています。

特に、「入力するコードは個人を特定できる情報を除去する」「生成されたコードはセキュリティチェックを通過させる」といったルールは、エンジニアの生産性向上とセキュリティの両立を目指す同社の姿勢を象徴しています。

【雛形】生成AIの社内規定作成で使えるガイドライン4選

生成AIの社内規定をゼロから作成するのは大変な作業です。

しかし、幸いなことに、多くの公的機関や業界団体が優れたガイドラインを公開しており、これらを雛形(テンプレート)として活用できます。

ここでは、特におすすめの4つの雛形を紹介します。

①:日本ディープラーニング協会(JDLA)|汎用性が高くベースに最適

日本ディープラーニング協会(JDLA)が公開している「生成AIの利用ガイドライン」は、非常に汎用性が高く、多くの企業にとってベースとして最適です。

このガイドラインは、「禁止事項」「注意事項」「推奨事項」の3つのカテゴリで構成されており、生成AIを安全に利用するための基本的な考え方が網羅されています。

特に、利用シーンごとのリスクと対策が分かりやすく整理されており、これを参考に自社の規定を作成することで、抜け漏れのない規定を作ることができます。

②:東京都デジタルサービス局|行政機関の視点を取り入れたい場合に

東京都デジタルサービス局が策定した「生成AI利用ガイドライン」は、行政機関がAIを利用する際の視点を取り入れたい場合に参考になります。

行政は、個人情報や機密情報を厳格に管理する必要があり、そのための考え方やルールが詳細に記載されています。

プライバシー保護や情報セキュリティに関する項目が特に充実しており、高いレベルのセキュリティが求められる企業にとって、非常に役立つでしょう。

③:経済産業省|AI事業者ガイドラインで法的リスクをチェック

経済産業省が策定した「AI事業者ガイドライン」は、AIを提供する事業者を対象としたものですが、AIを利用する企業にとっても、法的リスクをチェックする上で非常に重要です。

著作権、個人情報、不正競争防止法など、AIに関連する法的論点が網羅的に解説されており、自社の規定がこれらの法令に準拠しているかを確認する際のチェックリストとして活用できます。

法務部門の担当者は必読の資料と言えるでしょう。

④:自社に合わせた雛形を提供してくれるサービス

自社の状況に完全に合致した雛形を見つけるのは難しい場合があります。

その場合、外部の専門コンサルティングサービスを利用することも一つの選択肢です。

多くのサービスが、企業の業種や事業内容、利用目的に合わせて、カスタマイズされた雛形や策定支援を提供しています。

専門家の知見を活用することで、自社独自の課題に対応した、より実効性の高い規定を効率的に作成できます。

策定した生成AIの社内規定を成功に導く5つのポイント

生成AIの社内規定を策定するだけでは不十分です。

規定を社員に浸透させ、実効性のあるものにするためには、いくつかの重要なポイントがあります。

ここでは、策定した規定を成功に導くための5つのポイントを解説します。

ポイント①:まずはスモールスタートで導入する

完璧な規定を一気に作り上げようとすると、時間がかかりすぎてしまい、技術の進化に追いつけなくなります。

まずは、必要最低限のルールを定めた「ベータ版」の規定を策定し、特定の部署やプロジェクトでスモールスタートで導入してみるのがおすすめです。

実際に運用する中で出てきた課題や社員からのフィードバックを反映させ、段階的に規定を洗練させていくアプローチが効果的です。

ポイント②:定期的な研修で社員のAIリテラシーを向上させる

規定をただ配布するだけでは、社員に浸透しません。

定期的な研修会やワークショップを開催し、生成AIの正しい使い方、リスク、そして社内規定の重要性を継続的に教育することが重要です。

研修には、実際の業務に役立つプロンプト作成のコツや、具体的な活用事例を盛り込むことで、社員の参加意欲を高めることができます。

ポイント③:利用状況を可視化・管理するツールを導入する

社員がどの生成AIツールを、どのような目的で、どれくらい利用しているかを把握することは、規定の遵守状況をモニタリングし、今後のAI戦略を立てる上で不可欠です。

利用状況を可視化・管理するツールを導入することで、不正利用の早期発見や、利用が活発な部署への支援強化が可能になります。

これにより、セキュリティを確保しつつ、効果的にAI活用を促進できます。

ポイント④:ガイドラインを定期的にアップデートする

生成AIの技術は驚くべき速さで進化しています。

それに伴い、新たなリスクや活用方法も常に生まれています。

そのため、策定したガイドラインは一度作ったら終わりではなく、定期的に見直す体制を構築する必要があります。

新しいツールが導入されたり、重大な事故事例が発生したりした際には、迅速に規定をアップデートし、全社員に周知することが重要です。

ポイント⑤:成功事例を共有し、社内での活用を促進する

規定は「守りのルール」だけでなく、「攻めのルール」としても機能させることが重要です。

社内ポータルやニュースレターなどを活用して、生成AIを使って業務効率化に成功した社員の事例を積極的に共有しましょう。

これにより、他の社員も「自分もやってみよう」という意欲が湧き、社内全体でAI活用の機運が高まります。

成功事例の共有は、規定を単なる義務ではなく、企業全体の成長を促すツールとして認識させる上で非常に効果的です。

なぜあなたの会社に「AI秘書」が不可欠なのか?ハーバード大学も注目する“AIと生産性”の関係

ハーバード・ビジネス・スクールが、生成AIがホワイトカラーの生産性に与える影響について、ある興味深い研究結果を発表しました。この研究によると、AIを適切に活用した社員は、そうでない社員に比べて、タスク完了速度が平均で12.2%速く、さらにアウトプットの質も平均で25.1%向上したことが明らかになりました。

これは、生成AIが単なるツールではなく、私たちの「第二の脳」として機能し、業務のボトルネックを解消する強力なパートナーとなりうることを示唆しています。しかし、多くの企業が「情報漏洩が怖い」「社員のスキルが追いつかない」といった理由で導入をためらい、この大きな生産性向上の機会を逃しています。

あなたの会社は、AI活用で“先行者”となり、競合を大きく引き離す準備ができていますか?それとも、AIの波に乗り遅れ、時代に取り残されてしまいますか?今こそ、生成AIをリスクなく、かつ最大限に活用するための戦略を立てる時です。

引用元:

N. P. Agrawal, M. M. Ransbotham, R. G. Z. Iansiti, and K. R. Lakhani, “The Impact of Artificial Intelligence on White-Collar Productivity,” Harvard Business School Working Paper, 2023.

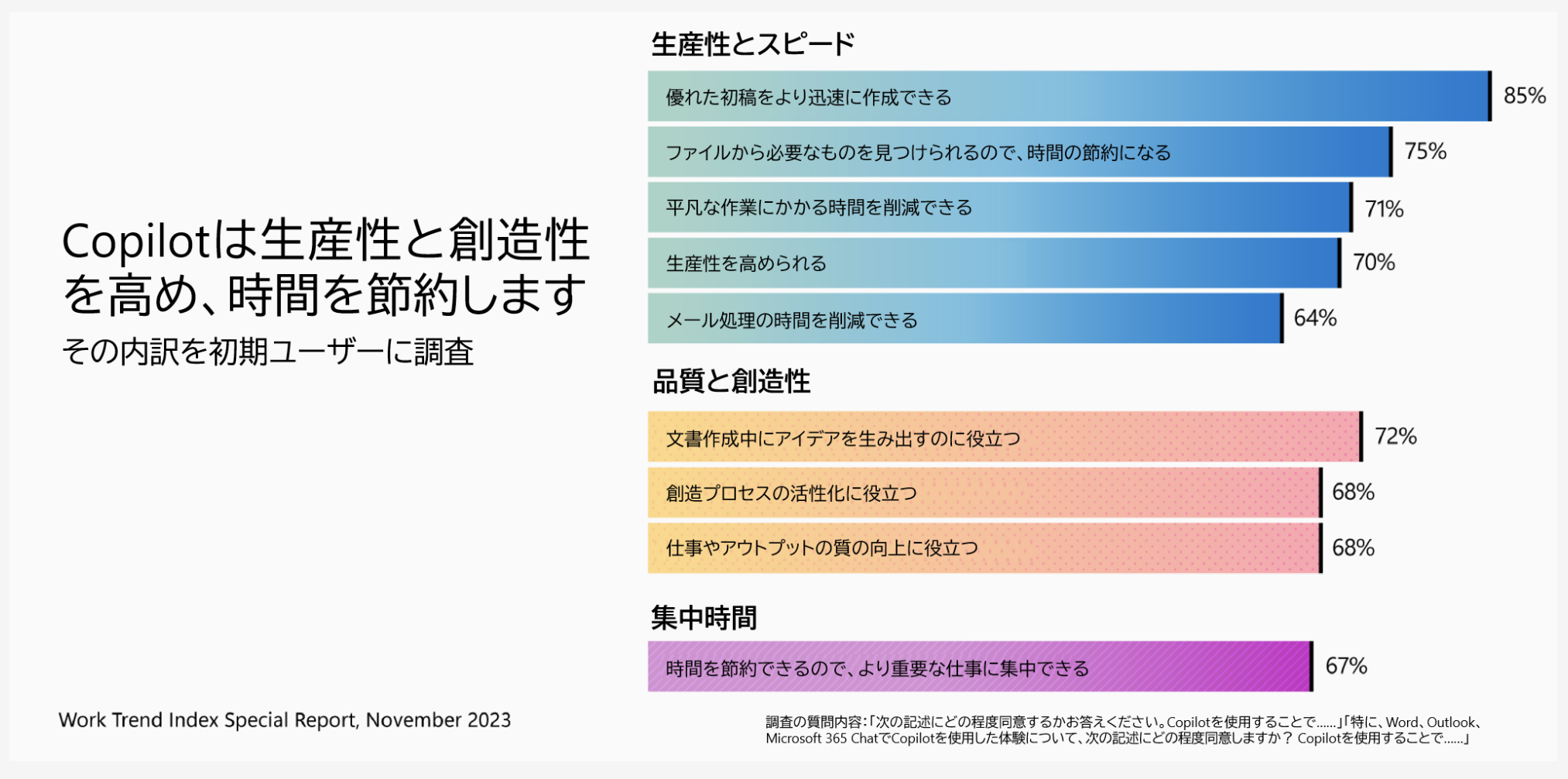

また、AIと生産性に関する研究として、Microsoftが公開した「Copilot’s earliest users teach us about generative AI at work」も非常に興味深い内容です。

まとめ

企業が生成AIを導入する際、最も懸念されるのが、情報漏洩や著作権侵害といったセキュリティリスクです。一方で、「社員に積極的に使ってもらいたい」「生産性を向上させたい」という期待も高まっています。しかし、多くの企業が「何から手をつければいいかわからない」「社内に専門人材がいない」という理由で、導入に踏み切れていないのが現状です。

そこでおすすめしたいのが、Taskhubです。Taskhubは、日本初のアプリ型インターフェースを採用した生成AI活用プラットフォームで、200種類以上の実用的なAIタスクを「アプリ」として提供しています。議事録作成、レポート自動生成、マーケティング文案作成など、さまざまな業務を誰でも直感的にAIで効率化できます。

さらに、TaskhubはAzure OpenAI Serviceを基盤としているため、社内の機密情報や個人情報がAIの学習データとして利用される心配がなく、強固なセキュリティ体制のもとで安心して利用できます。また、AIコンサルタントによる手厚い導入サポートが付いているため、AIの専門知識がない企業でもスムーズに導入を進められます。

Taskhubを導入すれば、複雑なプログラミングや高度なAI知識は不要です。まず、Taskhubの活用事例や詳細な機能を紹介したサービス概要資料を無料でダウンロードし、御社のDXを一気に加速させましょう。