「GPT-5.1が発表されたらしいけど、GPT-5と何が違うの?」

「新機能の『Instant』と『Thinking』モードって具体的にどう便利になった?」

こういった疑問を持つ方も多いでしょう。

本記事では、OpenAIから発表された最新モデル「GPT-5.1」について、GPT-5からの進化点、新機能「適応型Reasoning」の詳細、APIの価格、ChatGPTでの使い方まで、網羅的に解説します。

上場企業をメインに生成AIコンサルティング事業を展開している弊社が、GPT-5.1の技術仕様や公式発表を徹底的に分析した情報のみをご紹介します。

ぜひ最後までご覧ください。

速報:OpenAIが発表した「GPT-5.1」の要点

ここからは、OpenAIが新たに発表した「GPT-5.1」の概要と、GPT-5からの主な進化点について解説します。

- GPT-5.1の概要と位置づけ

- 提供されるモデル一覧

これらを把握することで、GPT-5.1がどのようなモデルなのかを素早く理解できます。

それでは、1つずつ見ていきましょう。

GPT-5.1とは?GPT-5からの進化と位置づけ

GPT-5.1は、2025年8月にリリースされたGPT-5のメジャーアップデート版として発表された最新言語モデルです。

GPT-5のリリース情報や機能の詳細については、こちらの記事で詳しく解説しています。 合わせてご覧ください。

GPT-5が特徴としていた「思考時間の自動切替」能力をさらに洗練させ、より高度な「適応型Reasoning(推論)」を搭載した点が最大の違いです。

GPT-5では、質問の難易度に応じて即時応答と長考を切り替えていましたが、GPT-5.1ではこの切り替えがよりシームレスになったほか、ユーザーが思考のプロセスを一部調整できるようになりました。

また、GPT-5.1は単なる性能向上だけでなく、会話の自然さや指示への追従性、コーディング能力など、実用面での使いやすさが大幅に強化されています。

OpenAIは、GPT-5.1を「より賢く、より速く、より使いやすい」モデルとして位置づけており、GPT-5で確立した基盤をさらに強固にするモデルと言えるでしょう。

これにより、複雑なタスクの自動化から日常的な会話アシスタントまで、幅広い用途での活用が期待されています。

こちらはOpenAIによるGPT-5.1の公式発表ブログです。 合わせてご覧ください。 https://openai.com/index/gpt-5-1/

発表されたGPT-5.1のモデル一覧

今回発表されたGPT-5.1では、用途に応じて最適化された複数のモデルが提供されます。

GPT-5では「gpt-5」「gpt-5-mini」「gpt-5-nano」が提供されていましたが、GPT-5.1では性能と役割がより明確化されました。

主なモデルは以下の通りです。

GPT-5.1 (Standard):

最も高性能なフラッグシップモデルです。「Instant」モードと「Thinking」モードの両方を最大限に活用でき、複雑な推論、データ分析、高度なコーディングに対応します。

GPT-5.1-mini:

GPT-5-miniの後継にあたる、速度とコスト効率に優れたモデルです。日常的なタスクや、高速なレスポンスが求められるチャットボットなどに適しています。

GPT-5.1-codex:

コーディング(プログラミング)タスクに特化したモデルです。後述するエージェント型コーディング機能を備え、開発効率を劇的に向上させます。

GPT-5.1-codex-mini:

Codexの軽量版で、コード補完や簡単なスクリプト作成など、リアルタイム性の高い開発支援に適しています。

これらのモデルは、ChatGPT上での利用のほか、APIを通じても提供され、開発者はニーズに最適なモデルを選択できます。

GPT-5.1の主要モード「Instant」と「Thinking」を解説

GPT-5.1の大きな特徴である「Instant」モードと「Thinking」モードについて、それぞれの機能と違いを解説します。

- Instantモード:自然な会話と指示追従性

- Thinkingモード:思考の調整と丁寧な説明

GPT-5では自動切替がメインでしたが、GPT-5.1ではこれらのモードを意識的に使い分けることが可能になりました。

それぞれの特徴を見ていきましょう。

「Instant」モードの特徴:より自然な会話と指示追従性

「Instant」モードは、GPT-5の「即時応答」能力をさらに強化したものです。

GPT-5.1では、このモードの応答速度が向上しただけでなく、会話の文脈を深く理解し、より自然でキャッチボールのような対話が可能になりました。

従来のモデルでは、応答は速くても会話が途切れがちだったり、少し前の指示を忘れてしまったりすることがありました。

しかし、GPT-5.1のInstantモードは、短いやり取りの中でもユーザーの意図や好みを記憶し、スムーズに応答に反映させます。

例えば、雑談やアイデア出しのブレインストーミング、簡単な情報検索など、スピード感が求められる場面で非常に高いパフォーマンスを発揮します。

また、後述するカスタム指示への追従性も向上しており、「いつもの口調で答えて」といった指示にも、これまで以上に正確に応えてくれるようになっています。

「Thinking」モードの特徴:思考の調整と丁寧な説明

「Thinking」モードは、GPT-5の「長考(推論)」能力を進化させた、GPT-5.1の核となる機能の一つです。

GPT-5が複雑な質問に対して「じっくり考えて」回答したように、Thinkingモードはコーディング、数学、データ分析、詳細なレポート作成など、高度な推論が必要なタスクで真価を発揮します。

GPT-5.1の最大進化点は、ユーザーがこの「思考」のプロセスに介入できるようになったことです。

具体的には、回答を生成する前に、どのようなステップで考えるか(思考のプラン)を提示させたり、特定の観点を重視するように指示したりすることが可能になりました。

また、Thinkingモードで生成された回答は、単に結論を示すだけでなく、なぜその結論に至ったのかという「理由」や「思考のプロセス」を丁寧に説明してくれます。

これにより、ユーザーは回答の信頼性を確認しやすくなり、AIとの共同作業がより深いレベルで実現可能になりました。

GPT-5.1の核となる新機能「適応型Reasoning」とは

GPT-5.1の性能を飛躍的に向上させた新機能「適応型Reasoning(Adaptive Reasoning)」について、その仕組みと関連機能を詳しく解説します。

- 適応型Reasoningの機能

- 速度優先の「no reasoning」モード

- プロンプトキャッシュの拡張

これらの新技術が、GPT-5.1の賢さと速さを両立させています。

順に見ていきましょう。

適応型Reasoningはどのように機能するのか

「適応型Reasoning」は、GPT-5.1が質問やタスクの複雑性を瞬時に判断し、解決に必要な「思考リソース」を動的に割り当てる技術です。

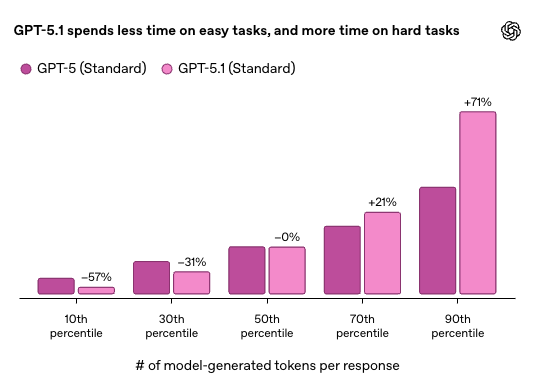

GPT-5では「即時応答」か「長考」かの二択に近い形でしたが、GPT-5.1ではより柔軟に対応します。

例えば、簡単な質問には最小限のリソース(Instantモードに近い)を使い、複雑な数学の問題には最大限のリソース(Thinkingモード)を割り当てます。

この技術の革新的な点は、単なるリソース配分だけでなく、推論の「深さ」と「幅」をタスクに応じて変える点にあります。

複数のステップが必要な問題(例:データ分析とグラフ作成)では、問題を自動的に分解し、各ステップに最適な推論プロセスを適用します。

これにより、無駄な計算を省きながらも、必要な場面では深く考えることができ、GPT-5と比較しても精度と効率が大幅に向上しました。

速度を優先する「no reasoning」モードとは

適応型Reasoningの機能の一部として、新たに「no reasoning(推論なし)」モードが導入されました。

これは、推論プロセスを意図的に最小限に抑え、応答速度を最大化するためのモードです。

Instantモードが「簡単な会話」レベルの速度だとすれば、no reasoningモードは「単純なテキスト補完」や「キーワード応答」に近い、極めて高速なレスポンスを実現します。

このモードは、API利用において特に有用です。

例えば、アプリケーションの入力補完、大量データの単純な分類、チャットボットの定型的な応答など、推論の正確さよりも速度が最優先される場合に「gpt-5.1-nano」などと組み合わせて使用することが想定されています。

ユーザーがChatGPT上で直接このモードを選択する機会は少ないかもしれませんが、GPT-5.1のアーキテクチャの柔軟性を示す機能と言えます。

効率化を実現するプロンプトキャッシュの拡張

GPT-5.1では、API利用時のコストと速度を改善するため、プロンプトキャッシュ機能が大幅に拡張されました。

プロンプトキャッシュとは、一度送信されたプロンプト(特にシステムプロンプトや長い指示文)を記憶しておき、次回以降のやり取りで再送信を不要にする技術です。

GPT-5.1では、このキャッシュの保持期間や容量が拡大され、より複雑なコンテキストを維持したまま、効率的にAPIコールを行えるようになりました。

例えば、長いドキュメントを読み込ませて対話する場合、従来は対話のたびにドキュメント全体(あるいはその一部)をトークンとして消費していました。

GPT-5.1では、このドキュメントをキャッシュすることで、2回目以降の質問にかかる入力トークンコストを劇的に削減できます。

これにより、開発者はコストを抑えながら、よりリッチなコンテキストを持つアプリケーションを構築できるようになります。

GPT-5.1の性能は?GPT-5やGPT-4.1と比較

最新モデルであるGPT-5.1は、先行するモデルと比べてどれほど性能が向上したのでしょうか。

- 主要ベンチマークでの性能比較

- 処理速度とコスト効率の改善

ここでは、OpenAIが公開したデータに基づき、GPT-5やGPT-4.1(仮の旧モデル)との性能比較を見ていきます。

主要ベンチマークでの性能比較結果

OpenAIの発表によると、GPT-5.1は主要なAI性能ベンチマークの多くでGPT-5を上回り、過去最高のスコアを記録しました。

特に顕著なのが、MMLU(一般的な知識・問題解決能力)やGPQA(専門的な科学知識)、MATH(数学)といった、高度な推論能力を必要とするベンチマークです。

これは、新搭載の「適応型Reasoning」と「Thinking」モードの強化が直接的に寄与していると考えられます。

GPT-5もこれらのベンチマークで高いスコアを出していましたが、GPT-5.1は特に「思考の深さ」が求められる難問での正答率が飛躍的に向上しています。

また、コーディング能力を測るHumanEvalやMBPPにおいても、GPT-5.1-codexモデルがGPT-5のコーディング能力を凌駕し、より複雑で実用的なコードを生成できることが示されています。

処理速度とコスト効率はどれくらい改善したか

GPT-5.1は、性能向上と同時に、処理速度とコスト効率の改善も実現しています。特に「Instant」モードや、軽量モデルである「GPT-5.1-mini」は、GPT-5の同等モデルと比較して、応答速度(Time to First Token)が大幅に短縮されました。

これは、適応型Reasoningによるリソース配分の最適化や、モデルアーキテクチャ自体の効率化によるものです。

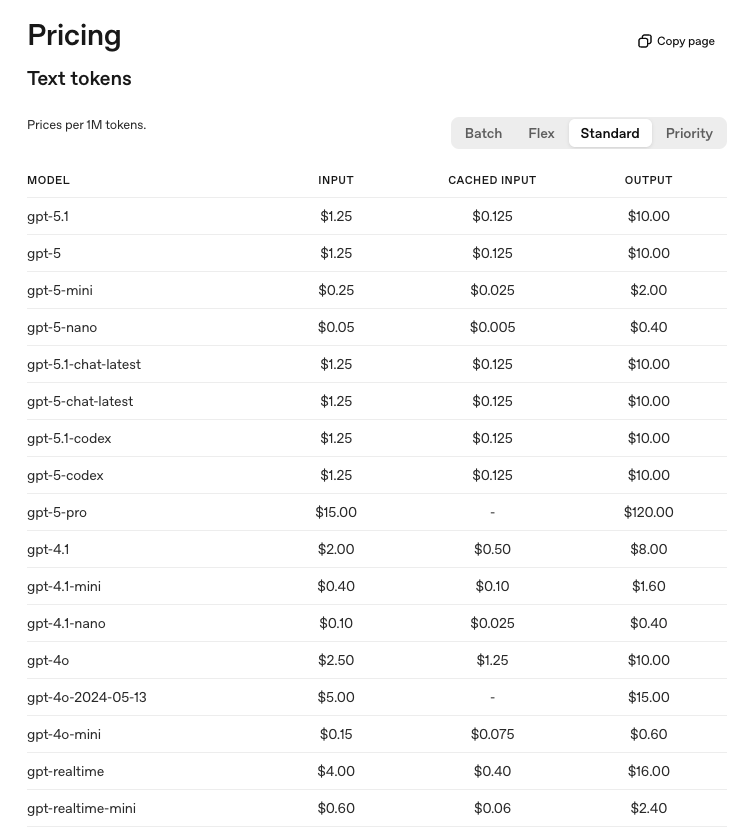

コスト面では、API価格において、特に「入力トークン」の単価がGPT-5よりも安価に設定される傾向があります。

これは、前述のプロンプトキャッシュ拡張と合わせ、開発者がより低コストで高機能なAIアプリケーションを運用できるようにするための戦略的な価格設定と言えます。

高性能な「Thinking」モードは利用コストが高くなる可能性がありますが、タスクに応じてモデルを使い分けることで、全体的なコストパフォーマンスはGPT-5時代よりも向上すると期待されます。

こちらはOpenAIのAPIモデルの最新価格設定ページです。 合わせてご覧ください。 https://platform.openai.com/docs/pricing

GPT-5.1でChatGPTの会話体験はどう変わるか

これらの技術的な進化は、私たちが日常的に使うChatGPTの会話体験にどのような変化をもたらすのでしょうか。GPT-5.1によって変わる3つのポイントを紹介します。

- スムーズになった会話のキャッチボール

- カスタム指示への追従性向上

- 回答の正確性と信頼性向上

GPT-5.1は、より「アシスタント」としての能力が向上しています。

具体的に見ていきましょう。

よりスムーズになった会話のキャッチボール

GPT-5.1を搭載したChatGPTは、会話の「間(ま)」がより自然になりました。

Instantモードの応答速度向上により、私たちが話しかけると、まるで人間とチャットしているかのような速さで返答が返ってきます。

従来のモデルでは、返答を待つ間に思考が中断されることもありましたが、GPT-5.1ではそのストレスが大幅に軽減されます。

また、単に速いだけでなく、短い返事(「そうだね」「それで?」など)や、文脈を踏まえた相槌も得意になりました。

これにより、単なる「質問と回答」の往復ではなく、アイデアを一緒に練り上げるような、創造的な「対話」が可能になります。

ブレインストーミングや雑談相手として、ChatGPTの利用価値がさらに高まるでしょう。

カスタム指示(指示の記憶)への追従性が向上

ChatGPTには、ユーザーの好みや指示をあらかじめ記憶させておく「カスタム指示」機能があります。

GPT-5.1では、このカスタム指示への追従性が劇的に向上しました。

例えば、「あなたは常にプロの編集者として、私の文章を簡潔に修正してください」「回答は必ず箇条書きでまとめてください」といった指示を、会話の途中で忘れることなく、高い精度で守り続けます。

GPT-5以前のモデルでは、会話が長くなるとカスタム指示が反映されにくくなることがありましたが、GPT-5.1では会話の全編を通して一貫したトーンや形式を維持できます。

これにより、ユーザーは自分のニーズに合わせてChatGPTを「チューニング」する手間が減り、よりパーソナライズされたAIアシスタントとして活用できます。

回答の正確性と信頼性の向上

GPT-5.1は、「Thinking」モードと「適応型Reasoning」により、回答の正確性が格段に向上しました。特に専門的な知識や複雑なロジックが要求される質問において、その差は顕著です。

GPT-5.1は、不確かな情報や推測に基づく回答を減らし、根拠に基づいた回答を生成するよう訓練されています。

また、回答生成のプロセスで「自己修正」を行う能力も強化されました。

一度考えた答えが論理的に矛盾していないか、ユーザーの指示と合致しているかを内部的にチェックし、より精度の高い回答を最終的に出力します。

これにより、ユーザーはChatGPTから得られる情報を、これまで以上に信頼できるようになります。

安全性の面でも、不正な指示(プロンプトインジェクション)への耐性が高まっており、安心して利用できる環境が整備されています。

GPT-5.1のパーソナライズ機能:回答のトーンやスタイルを調整

GPT-5.1では、ユーザー体験を向上させるための新しいパーソナライズ機能が追加されました。

ここでは、プリセットスタイルとトーン設定の使い方について解説します。

プリセットスタイルとトーン設定の使い方

GPT-5.1を搭載したChatGPTでは、回答の「スタイル」や「トーン」を簡単に調整できる新機能が導入されました。

これは、従来のカスタム指示よりも手軽に、その場の会話の目的に合わせてAIの振る舞いを変更できる機能です。

例えば、回答生成時に「フォーマル」「カジュアル」「ユーモラス」「専門的」「簡潔に」といったプリセットされたスタイルから選ぶことができます。

また、トーンについても「熱心に」「客観的に」「共感的に」といった設定が可能です。

これにより、同じ質問でも「ビジネスメール用のフォーマルな回答」と「友人に送るカジュアルなアドバイス」を即座に切り替えて生成させることができます。

この機能は、カスタム指示とは独立して機能するため、基本的な設定はカスタム指示で行い、一時的な変更をプリセットスタイルで行う、といった柔軟な使い分けが可能です。

GPT-5.1の高度な言語理解能力により、これらのスタイル指定は非常に高い精度で回答に反映されます。

GPT-5.1のコーディング能力の進化と新ツール

GPT-5.1は、開発者向けの機能、特にコーディング能力が大幅に進化しました。

ここでは、プログラミング機能の進化点と、開発を支援する新しいツールについて解説します。

- コーディング機能の進化点

- 新ツール「apply_patch」「shell」

これらは、GPT-5.1が単なるコード生成AIから「開発パートナー」へと進化していることを示しています。

コーディング(プログラミング)機能の進化点

GPT-5.1のコーディング能力は、GPT-5と比較して、より大規模で複雑なプロジェクトに対応できるよう進化しました。単にコードスニペット(断片)を書くだけでなく、プロジェクト全体の構造や依存関係を理解した上でのコード生成が可能です。

例えば、「既存のコードベースをリファクタリングする」「新しい機能を追加するために必要なファイルを修正する」といった、複数のファイルにまたがるタスクを実行できます。

これは、GPT-5.1がより大きなコンテキストウィンドウ(一度に処理できる情報量)を持ち、コードの文脈を深く理解できるようになったためです。

また、生成されるコードの正確性も向上しており、バグが少なく、より実行可能なコードを生成する能力が高まっています。

特に、マイナーな言語や最新のフレームワークに関する知識もアップデートされており、幅広い開発ニーズに対応可能です。

ChatGPTを使った具体的なプログラミングの上達方法や活用事例については、こちらの記事で詳細に解説しています。 合わせてご覧ください。

開発を支援する新ツール「apply_patch」「shell」

GPT-5.1のコーディング能力をさらに実用的にするため、2つの新しいツール機能が導入されました。

一つ目は「apply_patch」です。

これは、AIが生成したコードの変更(修正や追加)を、Linuxのpatchコマンドのように、既存のファイルに自動的に適用する機能です。

従来は、AIが提案したコードを開発者が手動でコピー&ペーストし、適切な場所に挿入する必要がありました。

「apply_patch」により、AIが「このファイルのこの部分をこう修正します」と提案し、ユーザーが承認するだけで自動的にコードが更新されるようになります。

二つ目は「shell」アクセス(制限付き)です。

AIがコードを実行したり、ファイルシステムを操作したりする必要がある場合、安全なサンドボックス環境内でシェルコマンドを実行できます。

これにより、コードのテスト、ライブラリのインストール、ファイルの移動などをAIが自律的に行えるようになり、開発プロセス全体の自動化がさらに進みます。

こちらは開発者向けに新ツールや適応型Reasoningを解説した公式ブログです。 合わせてご覧ください。 https://openai.com/index/gpt-5-1-for-developers/

GPT-5.1のCodexモデル:エージェント型コーディングとは

GPT-5.1のコーディング能力の進化は、専用の「Codex」モデルによって支えられています。

ここでは、GPT-5.1-codexが実現する「エージェント型コーディング」と、モデルの違いについて解説します。

GPT-5.1-codex と GPT-5.1-codex-miniの違い

GPT-5.1-codexは、プログラミングタスクに特化してファインチューニングされたモデルです。

このモデルの最大の特徴は、「エージェント型コーディング」能力にあります。

エージェント型コーディングとは、AIが単に指示されたコードを書くだけでなく、与えられた「目標」(例:「ECサイトに決済機能を追加する」)を達成するために、自らタスクを分解し、計画を立て、コードを書き、テストし、デバッグする一連のプロセスを自律的に実行することです。

GPT-5.1-codexは、前述の「apply_patch」や「shell」ツールと連携し、開発環境全体を操作するエージェントとして機能します。

一方、GPT-5.1-codex-miniは、このCodexモデルの軽量版です。

エージェントとしての自律性は制限されますが、リアルタイムのコード補完(IDE内でのサジェスト)や、小規模な関数の生成、コードレビューの支援など、開発者の日常的な作業を高速化するタスクに最適化されています。

速度とコスト効率に優れており、開発ワークフローに組み込みやすいモデルです。

こちらはGitHub CopilotでのGPT-5.1-codexのプレビュー提供に関するお知らせです。 合わせてご覧ください。 https://github.blog/changelog/2025-11-13-openais-gpt-5-1-gpt-5-1-codex-and-gpt-5-1-codex-mini-are-now-in-public-preview-for-github-copilot/

GPT-5.1のAPI利用:提供状況と価格(料金)

開発者や企業にとって重要な、GPT-5.1のAPI利用に関する情報です。

提供時期とアクセス方法、そして気になる価格(料金)についてまとめました。

- APIの提供開始時期とアクセス方法

- モデル別APIの価格設定

GPT-5.1では、用途に応じた複数のAPIが提供されます。

APIの提供開始時期とアクセス方法

GPT-5.1のAPIは、OpenAIの公式発表と同時に、一部の開発者向けにプレビュー版として提供が開始されました。

既存のGPT-5 APIを利用している開発者や、特定の基準を満たす企業ユーザーから優先的にアクセス権が付与されています。

一般公開(GA – General Availability)については、今後数週間以内に段階的に拡大される予定です。

APIへのアクセスは、従来のOpenAIプラットフォームを通じて行われます。

GPT-5.1を利用する際は、APIリクエストで指定するモデル名を「gpt-5.1」や「gpt-5.1-mini」などに変更する必要があります。

法人利用でセキュリティを重視する場合は、「ChatSense」のような法人向けAIプラットフォーム経由での利用も推奨されます。

これにより、入力したデータがAIの学習に利用されることなく、安全にGPT-5.1のパワーを活用できます。

モデル別APIの価格設定(料金表)

GPT-5.1のAPI価格は、モデルの性能と用途に応じて細かく設定されています。

全体的な傾向として、GPT-5と比較し、入力トークンの価格が比較的安価に設定されています。

以下は、発表された主要モデルの価格(例)です。(注:価格は変更される可能性があるため、公式サイトで最新情報をご確認ください)

GPT-5.1 (Standard):

Instantモード(入力/出力)とThinkingモード(入力/出力)で異なる料金体系が採用される可能性があります。Thinkingモードは計算リソースを多く消費するため、高価になることが予想されます。

GPT-5.1-mini:

GPT-5-miniよりもさらに低コスト化が進み、高速な応答が求められるチャットボットなどで、より利用しやすくなりました。

GPT-5.1-codex:

エージェント機能を利用する場合、実行時間や使用するツール(shell実行など)に応じた従量課金が導入される可能性があります。

GPT-5.1-nano (仮):

最速モデルとして、トークンあたりの単価は最も安価に設定されますが、推論能力は限定的です。

ChatGPTの月額料金や無料版と有料版の違いについて詳しく知りたい方は、こちらの記事をご確認ください。 合わせてご覧ください。

ChatGPTでGPT-5.1はいつから使える?プラン別の提供状況

APIだけでなく、私たちが直接触れるChatGPTでのGPT-5.1の提供状況も気になるところです。

プラン別の利用上限や制限について解説します。

- 既存モデル(GPT-5)はいつまで使えるか

- プラン別(無料・有料)の利用上限と制限

- 「Thinking」モードの専用利用上限

- コンテキストウィンドウとツール対応

GPT-5.1は、全てのユーザー(無料・有料)が利用可能ですが、プランによって制限が異なります。

こちらはChatGPTにおけるGPT-5.1の提供状況について解説したヘルプセンターの記事です。 合わせてご覧ください。 https://help.openai.com/en/articles/11909943-gpt-5-in-chatgpt

既存モデル(GPT-5)はいつまで使えるか

GPT-5.1のリリースに伴い、ChatGPTのデフォルトモデルはGPT-5.1に移行します。GPT-5は、GPT-5.1への移行をスムーズにするため、当面の間はモデル選択肢として残されます。

GPT-5は、GPT-5.1のリリースにより「旧モデル」と位置づけられましたが、APIなどでは引き続き利用可能です。

ChatGPT上でも、有料プランユーザーは互換性や過去の出力を確認するために、一定期間GPT-5を選択できるオプションが提供されます。

ただし、OpenAIはユーザーに最新かつ最も安全なGPT-5.1への移行を推奨しており、将来的にはGPT-5のサポートは終了する予定です。

プラン別(無料・有料)の利用上限と制限

GPT-5.1の利用は、ChatGPTのプラン(無料・有料)によって異なります。

無料プランユーザー:

GPT-5.1の「Instant」モード(または標準モード)を利用できます。ただし、利用にはメッセージ上限が設定されます(例:5時間あたり10メッセージなど)。

高性能な「Thinking」モードの利用は、1日に1回までなど、非常に厳しく制限されます。

有料プランユーザー (Plus, Team, Enterpriseなど):

メッセージ上限が無料プランに比べて大幅に緩和されます。

「Instant」モードと「Thinking」モードを、より柔軟に選択(あるいはAIが自動選択)して利用できます。

有料プランでは、「Fast(Instantモード)」と「Thinking」といったモードを明示的に選択できるUIが提供される場合があります。

「Thinking」モードの専用利用上限について

GPT-5.1の「Thinking」モードは、Instantモードと比較して数倍の計算リソースを消費します。そのため、有料プランユーザーであっても、「Thinking」モードの利用には専用の利用上限が設定されます。

これは、従来のGPT-4のメッセージ上限とは異なる、新しい制限(クレジット制や回数制など)になる可能性があります。

例えば、「Thinkingモード利用クレジット」が毎月付与され、複雑なタスクを実行するたびに、そのタスクの難易度(思考時間)に応じてクレジットを消費する、といった仕組みが考えられます。

OpenAIは、リソースの公平な分配と、高性能モデルの安定的な提供のために、この専用上限が必要であると説明しています。

無料プランユーザーがThinkingモードを利用できるのは、この機能を試すための「お試し」的な位置づけ(例:1日1回)となります。

コンテキストウィンドウのサイズとツール対応状況

GPT-5.1のコンテキストウィンドウ(一度に処理できるトークン数)は、GPT-5からさらに拡張されました。

標準モデルでも非常に大きなコンテキストを扱えるようになり、長いPDFドキュメントの読み込みや、数日間にわたるチャット履歴の記憶が可能になります。

ただし、最大コンテキストウィンドウサイズ(例:1Mトークンなど)の利用は、有料プランや特定のAPIプランに限定される可能性があります。

ツール(Webブラウジング、データ分析、DALL-Eによる画像生成など)の対応状況も向上しています。

GPT-5.1は、これらのツールをより賢く、適切なタイミングで呼び出すことができます。

特に「Thinking」モードでは、複数のツールを組み合わせて(例:Webで最新情報を検索し、その結果をデータ分析する)複雑なタスクを一度に実行する能力が強化されています。

Azure OpenAI ServiceでのGPT-5.1利用(法人向け)

多くの企業が利用するMicrosoftのAzure OpenAI Serviceにおいても、GPT-5.1の提供が開始されます。

ここでは、Azureでの利用可能なモデルと、ビジネス利用におけるモデル選択のガイドラインを解説します。

Azureで利用可能なGPT-5.1モデル

MicrosoftはOpenAIとの強力なパートナーシップに基づき、GPT-5.1の発表とほぼ同時に、Azure OpenAI Serviceでのプレビュー提供を開始しました。

Azureの管理コンソールから、GPT-5.1 (Standard)、GPT-5.1-mini、およびGPT-5.1-codexモデルをデプロイできるようになります。

Azureを利用する最大のメリットは、Microsoftが提供する堅牢なセキュリティ、コンプライアンス、プライベートネットワーク(VNet)統合など、エンタープライズグレードの機能と組み合わせてGPT-5.1を利用できる点です。

また、Azureのデータセンターを利用することで、データの所在(データレジデンシー)を国内に留めたいといった企業のニーズにも対応可能です。

Azure経由で利用する場合、入力されたデータがOpenAIのモデル学習に利用されることはありません。

こちらはAzure OpenAI ServiceでのReasoningモデル(GPT-5.1ファミリー)の利用方法に関するドキュメントです。 合わせてご覧ください。https://learn.microsoft.com/ja-jp/azure/ai-foundry/openai/how-to/reasoning?tabs=gpt-5%2Cpython%2Cpy

ビジネスで利用する場合のモデル選択ガイド

ビジネスでGPT-5.1を導入する際は、コストと性能のバランスを考慮したモデル選択が重要です。

カスタマーサポートのチャットボット(高速応答が重要):

この用途には「GPT-5.1-mini」が最適です。低コストかつ高速に応答を返し、多くのユーザーの定型的な質問に対応できます。

複雑な契約書のレビューや法的分析(正確性が重要):

高い推論能力が求められるため、「GPT-5.1 (Standard)」の「Thinking」モードを利用すべきです。

社内システムの開発・保守(コーディング支援):

開発者の生産性を最大化するために「GPT-5.1-codex」の導入が推奨されます。コードレビューやテスト自動化に活用できます。

マーケティングのコピー生成(速度と柔軟性が重要):

「GPT-5.1 (Standard)」の「Instant」モードや、プリセットスタイル機能を活用し、多様なパターンのテキストを迅速に生成するのが効果的です。

GPT-5.1の安全性は向上したか?モデル評価を解説

AIモデルが強力になるにつれて、その安全性も重要視されます。OpenAIは、GPT-5.1のリリースにあたり、広範な安全性評価を実施しました。

ここでは、GPT-5.1の安全対策と評価結果について解説します。

- 有害・禁止コンテンツへの対策

- メンタルヘルスや自傷行為に関する評価

- Jailbreak(脱獄)への耐性

- Vision(画像認識)機能の安全性

- OpenAIの安全対策「Preparedness Framework」

GPT-5.1では「出力中心の安全性」という概念が導入されています。

こちらはGPT-5.1の安全性評価に関するシステムカードの追加文書です。 合わせてご覧ください。 https://openai.com/index/gpt-5-system-card-addendum-gpt-5-1/

有害・禁止コンテンツ生成への対策

GPT-5.1は、ヘイトスピーチ、差別的な内容、暴力を助長するコンテンツなど、OpenAIのポリシーに違反する有害なコンテンツの生成を拒否するよう、厳しく訓練されています。

GPT-5と比較しても、これらのトピックに対する「セーフガード」は強化されています。

また、生物・化学兵器の開発やサイバー攻撃の計画など、危険な能力(CBRN)の悪用を防ぐための内部的な制限も高度化されています。

OpenAIは、モデルがこれらの危険な知識を詳細に出力しないよう、レッドチーム(攻撃的なテストを行う専門家チーム)によるテストを繰り返し実施しました。

メンタルヘルスや自傷行為に関する評価

GPT-5.1は、ユーザーが精神的な苦痛や自傷行為を示唆するような発言をした場合、専門的な助けを求めるよう促したり、公的な相談窓口(ホットラインなど)の情報を提供したりするよう設計されています。

医学的なアドバイスや診断を行うことはせず、あくまで支援的な情報提供に徹することで、ユーザーを安全な方向へ導くことを目指しています。

この分野の応答精度を高めるため、メンタルヘルスの専門家の監修のもと、モデルのファインチューニングが行われています。

Jailbreak(脱獄)への耐性は強化されたか

Jailbreak(脱獄)とは、AIの安全制限を回避しようとする特殊なプロンプト(指示)のことです。GPT-5.1では、このJailbreak(プロンプトインジェクション)への耐性が大幅に強化されました。

GPT-5で導入された「出力中心の安全性」というアプローチがさらに洗練されています。

これは、入力(プロンプト)が巧妙に偽装されていても、AIが生成しようとする「出力」自体が有害かどうかを最終段階でチェックし、ブロックする仕組みです。

GPT-5.1は、従来のJailbreak手法の多くを無効化することに成功しており、モデルの安全性をより強固なものにしています。

Vision(画像認識)機能の安全性評価

GPT-5.1は、テキストだけでなく画像も理解できるVision(視覚)機能を搭載しています。この機能の安全性評価も重点的に行われました。

特に、個人のプライバシーを侵害するような利用(例:画像から個人を特定する、監視目的で利用する)を防ぐための制限が設けられています。

例えば、GPT-5.1は画像に写っている人物の顔認識や、個人の身元を特定するような回答を拒否します。

また、不快感を与える可能性のある画像(暴力的なシーンや性的なコンテンツ)の分析についても、厳格なポリシーフィルターが適用されます。

OpenAIの安全対策「Preparedness Framework」とは

「Preparedness Framework(準備フレームワーク)」は、OpenAIが将来の高性能AIモデル(フロンティアモデル)のリスクを管理するために策定した、社内の安全対策プロセスです。

GPT-5.1は、このフレームワークに基づいて開発・評価された最初のモデルの一つです。

このフレームワークでは、AIモデルが社会に「壊滅的なリスク」をもたらす可能性がないかを、開発の各段階で厳しくチェックします。

評価分野には、前述のサイバーセキュリティ、CBRN(化学・生物・放射線・核)、Jailbreak耐性、自律性(AIが自己増殖する能力など)が含まれます。

GPT-5.1は、このフレームワークの基準をすべてクリアしたため、安全に一般公開できると判断されました。

これは、OpenAIがAIの能力向上と同時に、安全性の確保にも全力を挙げていることを示すものです。

【警告】ChatGPTはあなたの「脳をサボらせる」かもしれない

「ChatGPTに任せれば、頭を使わなくて済む」——。もしそう思っていたら、少し危険なサインです。MITの研究によると、ChatGPTを使って文章を作った人は、自力で考えた人に比べて脳の活動が半分以下に低下することがわかりました。

これは、脳が考えることをAIに丸投げしてしまう「思考の外部委託」が起きている証拠です。この状態が続くと、次のようなリスクが考えられます。

- 深く考える力が衰える: AIの答えを鵜呑みにし、「本当にそうかな?」と疑う力が鈍る。

- 記憶が定着しなくなる: 楽して得た情報は、脳に残りづらい。

- アイデアが湧かなくなる: 脳が「省エネモード」に慣れてしまい、自ら発想する力が弱まる。

便利なツールに頼るうち、気づかぬ間に、本来持っていたはずの「考える力」が失われていく可能性があるのです。

引用元:

MITの研究者たちは、大規模言語モデル(LLM)が人間の認知プロセスに与える影響について調査しました。その結果、LLM支援のライティングタスクでは、人間の脳内の認知活動が大幅に低下することが示されました。(Shmidman, A., Sciacca, B., et al. “Does the use of large language models affect human cognition?” 2024年)

【実践】AIを「脳のジム」に変える東大式の使い方

では、「賢くなる人」はChatGPTをどう使っているのでしょうか?答えはシンプルです。彼らはAIを「答えを出す機械」ではなく、「思考を鍛えるパートナー」として利用しています。ここでは、誰でも今日から真似できる3つの「賢い」使い方をご紹介します。

使い方①:最強の「壁打ち相手」にする

自分の考えを深めるには、反論や別の視点が不可欠です。そこで、ChatGPTをあえて「反対意見を言うパートナー」に設定しましょう。

魔法のプロンプト例:

「(あなたの意見や企画)について、あなたが優秀なコンサルタントだったら、どんな弱点を指摘しますか?最も鋭い反論を3つ挙げてください。」

これにより、一人では気づけなかった思考の穴を発見し、より強固な論理を組み立てる力が鍛えられます。

使い方②:あえて「無知な生徒」として教える

自分が本当にテーマを理解しているか試したければ、誰かに説明してみるのが一番です。ChatGPTを「何も知らない生徒役」にして、あなたが先生になってみましょう。

魔法のプロンプト例:

「今から『(あなたが学びたいテーマ)』について説明します。あなたは専門知識のない高校生だと思って、私の説明で少しでも分かりにくい部分があったら、遠慮なく質問してください。」

AIからの素朴な質問に答えることで、自分の理解度の甘い部分が明確になり、知識が驚くほど整理されます。

使い方③:アイデアを無限に生み出す「触媒」にする

ゼロから「面白いアイデアを出して」と頼むのは、思考停止への第一歩です。そうではなく、自分のアイデアの“種”をAIに投げかけ、化学反応を起こさせるのです。

魔法のプロンプト例:

「『(テーマ)』について考えています。キーワードは『A』『B』『C』です。これらの要素を組み合わせて、今までにない斬新な企画の切り口を5つ提案してください。」

AIが提案した意外な組み合わせをヒントに、最終的なアイデアに磨きをかけるのはあなた自身です。これにより、発想力が刺激され、創造性が大きく向上します。

まとめ

企業は労働力不足や業務効率化の課題を抱える中で、生成AIの活用がDX推進や業務改善の切り札として注目されています。

しかし、実際には「どこから手を付ければいいかわからない」「社内にAIリテラシーを持つ人材がいない」といった理由で、導入のハードルが高いと感じる企業も少なくありません。

そこでおすすめしたいのが、Taskhub です。

Taskhubは日本初のアプリ型インターフェースを採用し、200種類以上の実用的なAIタスクをパッケージ化した生成AI活用プラットフォームです。

たとえば、メール作成や議事録作成、画像からの文字起こし、さらにレポート自動生成など、さまざまな業務を「アプリ」として選ぶだけで、誰でも直感的にAIを活用できます。

しかも、Azure OpenAI Serviceを基盤にしているため、データセキュリティが万全で、情報漏えいの心配もありません。

さらに、AIコンサルタントによる手厚い導入サポートがあるため、「何をどう使えばいいのかわからない」という初心者企業でも安心してスタートできます。

導入後すぐに効果を実感できる設計なので、複雑なプログラミングや高度なAI知識がなくても、すぐに業務効率化が図れる点が大きな魅力です。

まずは、Taskhubの活用事例や機能を詳しくまとめた【サービス概要資料】を無料でダウンロードしてください。

Taskhubで“最速の生成AI活用”を体験し、御社のDXを一気に加速させましょう。