「ChatGPTの情報は古いと聞いたけど、もう使えないの?」

「最近、ChatGPTの回答が的外れな気がする…。もしかして時代遅れ?」

こういった疑問や不安を感じている方もいるのではないでしょうか?

本記事では、なぜChatGPTが「古い」と言われるのか、その具体的な理由と対策を徹底解説します。

さらに、ChatGPTの代わりになる最新のAIツール5選も紹介し、それぞれの特徴を比較します。

この記事を読めば、ChatGPTとの上手な付き合い方がわかり、AIを使いこなして生産性を最大化する方法が身につきます。

ぜひ最後までご覧ください。

なぜ「ChatGPTは古い」と言われるのか?3つの理由を解説

ChatGPTが「古い」と評されるのには、主に3つの理由があります。

- 学習データが特定の時点までで更新されないから

- リアルタイムの情報検索機能がないから(無料版)

- Geminiなど新しい競合AIが台頭しているから

これらの要因が重なり、「ChatGPTは最新情報に弱い」というイメージが定着しつつあります。

それでは、1つずつ具体的に見ていきましょう。

理由1:学習データが特定の時点までで更新されないから

ChatGPTが生成する回答は、事前に学習した膨大なデータに基づいています。

しかし、その学習データには「カットオフ」と呼ばれる知識の終点が存在します。

例えば、GPT-4oの知識は2023年10月までのものであり、それ以降に起きた出来事や発表された情報については基本的に知りません。

そのため、最新のニュースやトレンドに関する質問をしても、正確な回答を得ることができないのです。

この「知識のタイムラグ」が、「ChatGPTは古い」と言われる最大の理由です。

理由2:リアルタイムの情報検索機能がないから(無料版)

ChatGPTの無料版(GPT-3.5)には、インターネットに接続して最新情報を検索する機能がありません。

前述の通り、カットオフ時点までの知識しか持たないため、最新の情報を反映した回答を生成することができないのです。

有料版であるChatGPT Plusでは、Webブラウジング機能を使って最新情報にアクセスできますが、無料版のユーザーにとっては、情報の古さが際立って感じられます。

多くの人が利用する無料版にこの制限があることも、「古い」という印象を広める一因となっています。

理由3:Geminiなど新しい競合AIが台頭しているから

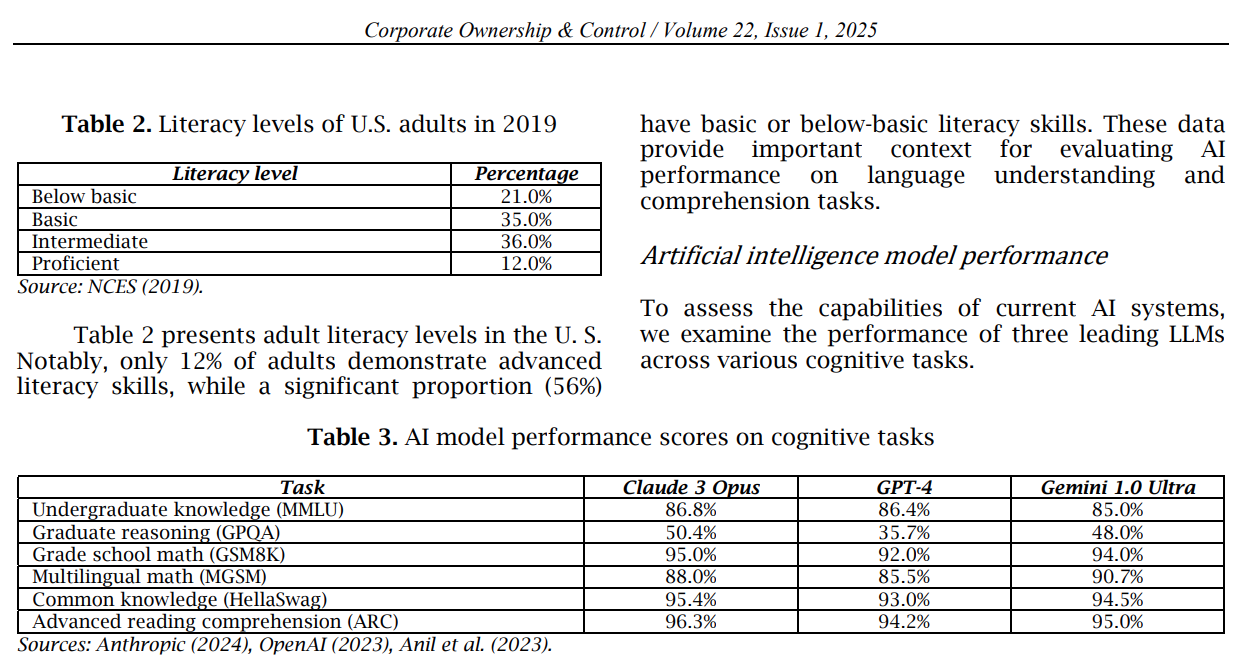

ChatGPTの登場以降、Googleの「Gemini」やAnthropicの「Claude」など、高性能な競合AIが次々と登場しています。

これらの新しいAIは、リアルタイムでのWeb検索機能を標準で搭載していたり、より大規模なデータを扱えたりと、ChatGPTの弱点を克服するような特徴を持っています。

特にGoogle Geminiは、Google検索と連携することで常に最新の情報に基づいた回答を生成できる強みがあります。

こうした競合の存在が、相対的にChatGPTを「古い」技術であるかのように見せている側面は否定できません。

こちらは、ChatGPT、Gemini、Claudeの3大AIの性能を定量的に比較した研究論文です。それぞれのAIの特性をより深く理解するのに役立ちます。 https://virtusinterpress.org/IMG/pdf/cocv22i1art8.pdf

そもそもChatGPTとは?「古い」と言われるAIの基本機能と活用例

「古い」と言われることがあっても、ChatGPTが非常に優れたAIであることに変わりはありません。

ここでは、改めてChatGPTの基本的な機能と、ビジネスにおける活用事例を確認しておきましょう。

ChatGPTの得意分野を理解することで、その限界と可能性を正しく見極めることができます。

ChatGPTでできること(得意な分野)

ChatGPTは、特に言語処理に関連するタスクを得意としています。

アイデアの壁打ち、文章の要約や翻訳、メールやブログ記事の草案作成、複雑なテーマの分かりやすい解説、さらにはプログラミングコードの生成やデバッグなど、その応用範囲は多岐にわたります。

これらのタスクは、必ずしも最新情報が必要なわけではありません。

普遍的な知識や創造性が求められる分野において、ChatGPTは今でも強力なアシスタントとして機能します。

ChatGPTのビジネス活用事例

ビジネスの現場では、多くの定型業務でChatGPTが活用されています。

例えば、顧客へのメール返信文の作成、会議の議事録の要約、プレゼンテーションの構成案作成、新商品のキャッチコピーのブレインストーミングなどが挙げられます。

これらの業務をChatGPTに任せることで、従業員はより創造的で戦略的な業務に集中できるようになります。

業務効率化や生産性向上という観点から見れば、ChatGPTは決して「古い」ツールではなく、むしろ不可欠な存在と言えるでしょう。

「ChatGPTの情報は古い」と感じる原因と仕組みを深掘り

ChatGPTがなぜ古い情報を生成してしまうのか、その背景にある技術的な仕組みをもう少し詳しく見ていきましょう。

「学習データのカットオフ」と「ハルシネーション」という2つのキーワードが重要です。

これらの仕組みを理解することで、AIの回答を鵜呑みにする危険性を回避できます。

学習データのカットオフとは?いつの情報まで対応?

前述の通り、ChatGPTの知識にはカットオフ(知識の期限)があります。

最新モデルであるGPT-4oの知識は2023年10月までの情報に基づいており、それ以降の出来事については学習していません。

例えば、「2024年の日本の首相は誰ですか?」と質問しても、カットオフ時点の情報で答えようとするため、正確な回答は期待できません。

この日付はモデルのアップデートによって更新されますが、常に数ヶ月から1年程度のタイムラグが存在することを認識しておく必要があります。

ハルシネーション(もっともらしい嘘)を生成する仕組み

ハルシネーションとは、AIが事実に基づかない情報を、あたかも事実であるかのように生成する現象のことです。

これは、AIが学習データの中にある単語や情報の関連性から、「次に来る確率が最も高い言葉」を予測して文章を組み立てるという仕組みに起因します。

AIは情報の正しさを理解しているわけではありません。

そのため、学習データに誤った情報が含まれていたり、情報が古かったりすると、平然と「もっともらしい嘘」を生成してしまうのです。

これが、「情報が古い」と感じられるだけでなく、誤情報につながる危険な側面です。

こちらはAIのハルシネーションを防ぐプロンプトについて解説した記事です。合わせてご覧ください。 https://taskhub.jp/use-case/chatgpt-prevent-hallucination/

「ChatGPTは古い」と言われる限界点や苦手なこと

ChatGPTは万能ではありません。

特に「情報の鮮度」と「正確性」が求められる分野には限界があります。

ここでは、ChatGPTが苦手とする3つの領域について解説します。

これらの限界点を理解し、不得意なタスクを無理に任せないことが、AIを賢く使うコツです。

最新情報や変化の激しい分野の話題

法改正、株価、最新の技術動向、流行のニュースなど、日々状況が変化する分野の話題はChatGPTの苦手分野です。

学習データのカットオフにより、これらの最新情報を正確に捉えることができません。

有料版のブラウジング機能を使えばある程度はカバーできますが、それでも情報の解釈を誤る可能性は残ります。

変化の激しいトピックについては、専門のニュースサイトや一次情報を確認する方が確実です。

正確性が求められる専門的な情報

医療、法律、金融など、人々の生命や財産に直接関わるような専門分野の情報を扱う際にも注意が必要です。

ChatGPTは専門家ではないため、その回答には誤りが含まれている可能性があります。

生成された情報が古かったり、ハルシネーションによって不正確な内容になっていたりするリスクがあります。

専門的なアドバイスを求める場合は、必ず資格を持つ専門家に相談するようにしてください。

長文の生成や複雑な文脈の理解

ChatGPTは非常に長い文章を一度に生成したり、複雑で入り組んだ文脈を最後まで正確に理解し続けたりすることが苦手な場合があります。

会話が長くなると、前の文脈を忘れてしまい、話が噛み合わなくなったり、矛盾した回答を生成したりすることがあります。

論文やレポートのような長大なドキュメントの作成を一度に任せるのではなく、章ごとや節ごとに指示を分けるなど、タスクを細分化して依頼する工夫が必要です。

ChatGPTの古い情報がもたらすビジネス上のリスクと誤情報例

ChatGPTが生成する古い情報や誤情報をビジネスで利用してしまうと、深刻なリスクにつながる可能性があります。

ここでは、具体的なリスクと、実際にあった誤情報の事例を紹介します。

AIの利便性の裏に潜む危険性を認識し、適切な対策を講じることが重要です。

誤った情報に基づく意思決定のリスク

もし企業がChatGPTの生成した古い市場データや不正確な法的解釈を基に経営判断を下してしまったら、どうなるでしょうか。

大きな経済的損失を被ったり、法的なトラブルに巻き込まれたりする可能性があります。

AIの回答を検証せずに重要な意思決定に利用することは、ビジネスの根幹を揺るがしかねない非常に危険な行為です。

AIはあくまで意思決定の補助ツールであり、最終的な判断は人間が責任を持って行う必要があります。

コンテンツの信頼性が低下するリスク

企業が運営するブログやSNSで、ChatGPTが生成した古い情報や誤った内容を発信してしまった場合、企業の信頼性やブランドイメージは大きく損なわれます。

読者からの信用を失い、顧客離れにつながる可能性も否定できません。

特に、専門性や権威性が重視される分野では、情報の正確性が生命線です。

AIが生成したコンテンツを公開する前には、必ず専門家によるファクトチェックが不可欠です。

実際にあった誤情報の具体例

過去には、海外の弁護士がChatGPTで判例を調べたところ、AIが架空の判例を複数でっち上げてしまい、法廷で問題になったという事例がありました。

また、あるジャーナリストが歴史上の出来事について質問した際、事実とは異なる日付や人物名を回答されたという報告もあります。

これらの事例は、AIが生成する情報の危険性を如実に示しています。

ChatGPTの回答は、常に疑いの目を持って接する必要があるのです。

ChatGPTの古い情報に騙されないための5つの対策

ChatGPTの情報が古いという問題は、いくつかの対策を講じることで回避できます。

ここでは、AIの誤情報に騙されず、安全に活用するための5つの具体的な方法を紹介します。

これらの対策を習慣づけることで、ChatGPTをより信頼性の高いツールとして使いこなせるようになります。

対策1:必ずファクトチェック(事実確認)を行う

最も基本的かつ重要な対策は、ファクトチェックです。

ChatGPTが生成した回答、特に統計データ、固有名詞、日付、歴史的な事実などが含まれる場合は、必ず信頼できる情報源(公式サイト、公的機関の発表、専門家の論文など)で裏付けを取りましょう。

この一手間を惜しまないことが、誤情報のリスクを回避する上で不可欠です。

特にビジネスで利用する場合は、ファクトチェックを業務フローに組み込むべきです。

対策2:情報のソース(情報源)を尋ねるプロンプトを使う

ChatGPTに回答を生成させた後、「その情報のソース(情報源)は何ですか?」と追加で質問するのも有効な手段です。

具体的な情報源を提示できない場合や、曖昧な答えしか返ってこない場合は、その回答の信憑性が低いと判断できます。

ただし、ChatGPTがもっともらしい嘘の情報源を提示することもあるため、示されたソースが実在する信頼できるものかどうかも確認する必要があります。

対策3:Webブラウジング機能を活用する(有料版)

ChatGPT Plusなどの有料版を利用している場合は、Webブラウジング機能を積極的に活用しましょう。

この機能を使えば、ChatGPTがリアルタイムでインターネットを検索し、最新の情報に基づいて回答を生成してくれます。

これにより、学習データのカットオフという弱点を大幅にカバーすることができます。

最新の情報を扱うことが多い場合は、有料版へのアップグレードを検討する価値は十分にあります。

対策4:複数のAIツールで同じ質問を試す

一つのAIツールの回答を鵜呑みにせず、GoogleのGeminiやMicrosoftのCopilotなど、他のAIツールにも同じ質問を投げかけてみましょう。

複数のAIが共通して同じ回答をすれば、その情報の信頼性は比較的高いと判断できます。

逆に、AIによって回答が異なる場合は、その情報が不確かである可能性を示唆しています。

セカンドオピニオンならぬ「セカンドAI」を持つことで、情報の精度を高めることができます。

対策5:あくまで「たたき台」として利用する

ChatGPTの回答を、完成品としてではなく、あくまで「たたき台」や「下書き」として利用するという心構えも重要です。

AIにアイデアの骨子や文章の構成案を作ってもらい、そこから人間がファクトチェックや編集、追記を行うという使い方です。

この方法であれば、AIの生産性と人間の信頼性を両立させることができます。

AIをゼロからイチを生み出すパートナーではなく、イチを十に発展させるためのアシスタントと位置づけるのです。

「ChatGPTは古い」は本当?代替できる最新AIツールを徹底比較【5選】

「ChatGPTは古い」と感じる場面があるのは事実ですが、幸いにも私たちには多くの選択肢があります。

ここでは、ChatGPTの代替となりうる、あるいは併用することで効果を発揮する最新のAIツールを5つ紹介します。

それぞれのツールの特徴を理解し、あなたの目的に合った最適なAIを見つけましょう。

Google Gemini(旧Bard)

Googleが開発したGeminiは、Google検索と直接連携しており、常に最新かつ信頼性の高い情報に基づいた回答を生成できるのが最大の強みです。

リアルタイムの情報収集能力に長けており、最新ニュースの要約やトレンド分析などで特に力を発揮します。

また、Googleドキュメントやスプレッドシートなど、他のGoogleサービスとの連携もスムーズです。

情報の鮮度と正確性を重視するなら、Geminiは最も有力な選択肢の一つとなるでしょう。

Geminiを活用した業務効率化の具体的な事例については、こちらの記事で詳しく解説しています。合わせてご覧ください。 https://taskhub.jp/useful/gemini-business-efficiency-improvemen/

Anthropic Claude

Anthropic社が開発したClaudeは、特に長文の読解や生成、そして倫理性を重視した設計で注目されています。

一度に扱えるテキスト量(コンテキストウィンドウ)が非常に大きく、長大なレポートの要約や、複雑な契約書のレビューなどに適しています。

また、より自然で人間らしい対話が可能と評価されており、文章作成や壁打ち相手としても優秀です。

安全性と対話の質を求めるユーザーにおすすめのAIです。

Microsoft Copilot(旧Bing AI)

Microsoft Copilotは、同社の検索エンジンBingと統合されており、リアルタイムのWeb検索結果に基づいた回答を生成します。

特筆すべきは、回答と同時にその情報源となったウェブサイトのリンクを明示してくれる点です。

これにより、ユーザーは簡単にファクトチェックを行うことができます。

WindowsやOffice製品との連携も強力で、日常的な業務の中でシームレスにAIのサポートを受けられるのが魅力です。

Perplexity AI

Perplexity AIは「会話型検索エンジン」とも呼ばれ、質問に対して検索エンジンのように情報源を明記した形で回答を生成することに特化しています。

情報の信頼性を何よりも重視するユーザーにとって、非常に有用なツールです。

学術論文の検索や、特定のテーマに関するリサーチなど、正確な情報源の把握が不可欠な場面で大きな力を発揮します。

情報の正しさを担保したいリサーチ業務に最適です.

Notion AI

Notion AIは、人気のドキュメント作成・共有ツール「Notion」に組み込まれたAIアシスタントです。

Notionのページ内でシームレスにAIを呼び出し、文章の作成、要約、翻訳、アイデア出しなどを行えるのが最大の特徴です。

既存のワークフローを崩さずにAIの力を活用できるため、すでにNotionを業務で利用しているチームにとっては非常に強力なツールとなります。

情報整理と文章作成を効率化したい場合に最適です。

ChatGPTしか使わないのは古い!AIの複数使いで生産性を最大化する新常識

これからの時代、一つのAIに固執するのではなく、複数のAIをその特性に応じて使い分けることが生産性向上の鍵となります。

「ChatGPTは古い」と切り捨てるのではなく、その得意分野を活かしつつ、他のAIで弱点を補うという考え方が重要です。

ここでは、AIを複数使いこなすことのメリットと、その具体的な活用術を紹介します。

用途に応じてAIを使い分けるメリットとは

それぞれのAIには得意・不得意があります。

例えば、創造的なアイデア出しや文章の草案作成はChatGPT、最新情報の調査やファクトチェックはGeminiやPerplexity AI、長文の要約はClaude、といった具合です。

このように、タスクの性質に応じて最適なAIを使い分けることで、常に質の高いアウトプットを効率的に得ることができます。

一つのツールで無理やり全ての作業をこなそうとするよりも、はるかに生産性が向上するでしょう。

情報精度を高めるための複数AI活用術

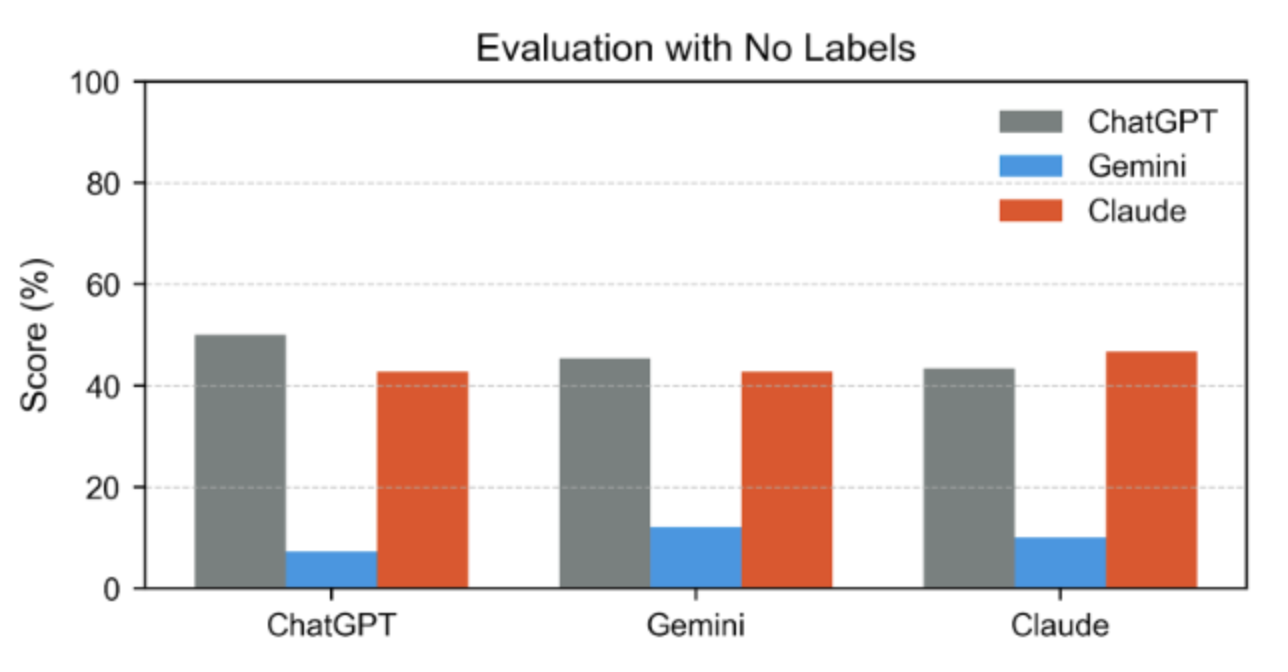

情報精度を極限まで高めたい場合、複数のAIに同じ質問を投げかけ、その回答を比較検討する方法が有効です。

全てのAIが共通の回答をした部分は信頼性が高く、回答が分かれた部分はさらに深掘りして調査すべきポイントだと判断できます。

また、ChatGPTで作成した文章の草案を、Geminiを使ってファクトチェックしたり、Claudeに校正させたりといった連携も可能です。

AI同士を協力させることで、一人で作業するよりも遥かに高精度な成果物を生み出すことができます。

AIによる自己評価や相互評価のバイアスを定量化したこちらの研究は、複数のAIを組み合わせて利用する際の精度向上を考える上で参考になります。合わせてご覧ください。 https://arxiv.org/html/2508.21164v1

まとめ:「ChatGPTは古い」という情報を乗りこなしAIを使いこなそう

本記事では、「ChatGPTは古い」と言われる理由から、その対策、そして代替となる最新AIツールまでを網羅的に解説しました。

ChatGPTには学習データが古いという弱点があるのは事実ですが、文章作成やアイデア出しといった普遍的なタスクにおいては依然として非常に強力なツールです。

その限界を正しく理解し、ファクトチェックを徹底すること。

そして、GeminiやClaudeといった最新のAIと目的別に使い分けること。

この2点を意識するだけで、あなたはAIを「使いこなす」側になることができます。

「ChatGPTは古い」という言葉に惑わされず、それぞれのAIの長所と短所を見極め、あなたのビジネスや業務における最強のパートナーとして活用していきましょう。

ChatGPTを「検索」に使うのはもう古い?AIに淘汰されないための必須スキル

「ChatGPTで最新情報を調べている」——もしそうなら、あなたはAIの進化から取り残されているかもしれません。GoogleのGeminiやMicrosoftのCopilotがリアルタイム検索で精度を上げる一方、ChatGPTを旧来の検索エンジンのように使うだけでは、誤った情報に踊らされ、ビジネスチャンスを逃す危険性があります。スタンフォード大学の最新のAI研究報告によれば、大規模言語モデルは依然として「ハルシネーション(情報の捏造)」という根本的な課題を抱えています。これは、AIが事実に基づかない情報を、さも本物であるかのように生成してしまう現象です。AIの答えを鵜呑みにすることは、次のようなリスクに直結します。

- 古い情報に基づく誤った経営判断

- 企業の信頼を損なう不正確なコンテンツの発信

- 存在しない判例やデータを参照する法的・倫理的問題

AIに淘汰されないためには、AIを「答えを出す機械」ではなく「思考を拡張する道具」として使いこなす必要があります。例えば、ChatGPTで得た回答の要点を、リアルタイム検索が得意なGeminiやCopilotに投げかけ、「この情報に関する最新のニュースや反論はありますか?」と尋ねることで、情報の多角的な検証が習慣化されます。また、「あなたは優秀なリスク管理の専門家です。このアイデアに含まれる潜在的なリスクを5つ挙げてください」のように、AIに特定の専門家の役割を与えることで、一人では気づけない視点や思考の抜け漏れを発見できるのです。

引用元:

スタンフォード大学人間中心AI研究所(HAI)の「Artificial Intelligence Index Report」では、AIモデルが直面する課題として、ハルシネーションが依然として大きな障害であることが指摘されています。(Stanford Institute for Human-Centered Artificial Intelligence. “Artificial Intelligence Index Report 2024.” 2024年, https://aiindex.stanford.edu/report/)

まとめ

企業は業務効率化を目指す中で、ChatGPTをはじめとする生成AIの活用が不可欠となっています。

しかし、実際には「どのAIツールが自社に最適かわからない」「情報が古く、ビジネス利用にはリスクがある」「社員がプロンプトを使いこなせない」といった理由で、本格的な導入に踏み切れない企業も少なくありません。

そこでおすすめしたいのが、Taskhubです。

Taskhubは日本初のアプリ型インターフェースを採用し、200種類以上の実用的なAIタスクをパッケージ化した生成AI活用プラットフォームです。

たとえば、最新情報を反映した市場調査レポートの自動生成や、正確性が求められる契約書の要約、さらには複数AIの比較分析など、さまざまな業務を「アプリ」として選ぶだけで、誰でも直感的にAIを活用できます。

しかも、Azure OpenAI Serviceを基盤にしているため、データセキュリティが万全で、情報漏えいの心配もありません。

さらに、AIコンサルタントによる手厚い導入サポートがあるため、「AIをどう業務に組み込めばいいのか」という初心者企業でも安心してスタートできます。

導入後すぐに効果を実感できる設計なので、複雑なプロンプトの知識がなくても、すぐに業務効率化と情報精度の向上が図れる点が大きな魅力です。

まずは、Taskhubの活用事例や機能を詳しくまとめた【サービス概要資料】を無料でダウンロードしてください。

Taskhubで“最速かつ安全な生成AI活用”を体験し、御社のDXを一気に加速させましょう。