「AIを業務で使っているけれど、期待した回答が返ってこない…。」

「プロンプト設計を学んで、もっと複雑なタスクをAIに任せたい。」

こういった悩みや希望を持っている方も多いのではないでしょうか。

本記事では、AIの出力を劇的に改善するためのプロンプト設計の基本から、応用的な10の手法、そして最新モデル「GPT-5.2」を使いこなすためのコツを網羅的に解説しました。

上場企業を中心に生成AIコンサルティングを提供している弊社が、現場で培った実践的なノウハウを凝縮してお伝えします。

この記事を読み終える頃には、誰でも精度の高いプロンプトを自作できるようになるでしょう。

ぜひ最後までご覧ください。

プロンプト設計とは?基本概念と重要性を解説

ここからは、プロンプト設計の基本概念とその重要性について解説します。

- プロンプトエンジニアリングとの違い

- なぜ設計を工夫するだけでAIの回答が変わるのか

プロンプト設計を正しく理解し、基礎を固めることで、AIからの回答の質を安定させ、手戻りを最小限に抑えることが可能になります。

プロンプト設計による業務効率化を具体的にイメージしたい方は、ChatGPTの業務活用ガイド決定版として事例40選と成功の秘訣を解説しています。 合わせてご覧ください。

それでは、1つずつ順に解説します。

プロンプトエンジニアリングとの違い

プロンプト設計とプロンプトエンジニアリングは、広い意味では同じ文脈で使われることが多い言葉ですが、そのアプローチには微細な違いがあります。

エンジニアリングが「AIモデルの仕組みを理解し、数学的・論理的なアプローチで出力を最適化する」という技術的な側面が強いのに対し、設計は「ユーザーが解決したい課題をどう言語化し、AIに伝えるか」というコミュニケーションデザインに近い側面を持っています。

特に2025年現在の最新AIモデルにおいては、人間が使う自然言語のニュアンスをより正確に汲み取る能力が向上しています。

そのため、高度なプログラミング的知識がなくても、情報の整理の仕方や文脈の与え方といった「設計」の工夫だけで、十分にプロフェッショナルな成果物を得られるようになりました。

つまり、プロンプト設計とは、AIを特定のタスクを遂行する優秀なパートナーとして定義し、そのアウトプットをコントロールするための仕様書を作る作業だと言えます。

この設計スキルを磨くことは、AI時代の必須教養となりつつあります。

なぜ「設計」を工夫するだけでAIの回答が変わるのか

AIの回答が変わる最大の理由は、大規模言語モデルが「次に続く確率が高い言葉」を予測して出力するという仕組みに基づいているからです。

プロンプトが曖昧だと、AIは膨大な学習データの中から広範囲な可能性を探索してしまい、結果として一般的で中身のない回答を生成しやすくなります。

一方で、プロンプト設計を丁寧に行い、情報の解像度を高めて伝えると、AIが探索すべき範囲を特定の領域に絞り込むことができます。

例えば「会議の議事録を書いて」とだけ頼むよりも、「あなたはIT企業のプロジェクトマネージャーとして、クライアントとの要件定義における決定事項と宿題事項を抽出して」と指示する方が、AIはどの文脈で言葉を選ぶべきかが明確になります。

このように、前提条件やルールを構造化して提示することで、AIの内部で論理的な思考回路が活性化されやすくなります。

最新のGPT-5.2などのモデルでは、質問の難易度に応じて「Instant」や「Thinking」などのモードを自動で切り替える機能が備わっているため、設計の質がそのままAIの「熟考の質」に直結するのです。

GPT-5.2について、リリース日、機能、従来のバージョンとの違いなどをこちらの記事で詳しく解説しています。 合わせてご覧ください。

成果を最大化するプロンプト設計の4つの構成要素

ここからは、成果を最大化するためのプロンプト設計の4つの構成要素について解説します。

- 【命令】何をしてほしいかを明確に伝える

- 【背景】前提条件やシチュエーションを設定する

- 【入力】処理対象となるデータを与える

- 【出力】回答の形式やトーンを指定する

これら4つの要素をバランスよく盛り込むことで、AIへの指示が構造化され、精度の高い回答が安定して得られるようになります。

それでは、1つずつ順に解説します。

【命令】何をしてほしいかを明確に伝える

命令はプロンプトの核となる要素であり、AIに実行させる具体的なアクションを指します。

ここで最も重要なのは、解釈の余地を残さないほど明確で断定的な動詞を使うことです。

例えば「考えてください」という指示よりも、「要約してください」「リストアップしてください」「比較表を作成してください」といった具体的な動作を指示する必要があります。

指示が多岐にわたる場合は、一つの文に詰め込まず、箇条書きを活用して優先順位を示すのが効果的です。

また、命令文の冒頭に「以下の条件に従って、ブログ記事の構成案を作成してください」といった具合に、結論から述べることでAIがタスクを認識しやすくなります。

命令が不明瞭だと、AIはユーザーが何を望んでいるかを推測することにリソースを割いてしまい、本題の精度が落ちてしまいます。

まずは、自分がAIに「何をさせたいのか」を一文で定義することから始めましょう。

【背景】前提条件やシチュエーションを設定する

背景情報は、AIに「どのような立場や状況で回答すべきか」を教えるためのコンテキストです。

AIには膨大な知識がありますが、背景を与えないと、学校の先生のような回答をしたり、逆に冷徹なビジネスマンのような回答をしたりと、出力が不安定になります。

これを防ぐために、役割(ロール)や目的、ターゲット層を詳しく設定します。

「あなたは経験10年のSEOライターです」という役割設定に加え、「この記事の読者は、生成AIを導入検討中の企業の課長クラスです」といったターゲット設定を盛り込みます。

さらに「このプロジェクトの目的は、AI活用のハードルを下げることです」という意図を添えるだけで、回答の語り口や内容の深さが最適化されます。

背景を充実させることで、AIはユーザーが持っている「常識」や「暗黙の了解」を共有した状態で推論を開始できます。

特に専門的な業務を依頼する場合には、業界特有の事情や現在の課題感を背景として伝えることが、的外れな回答を防ぐ鍵となります。

【入力】処理対象となるデータを与える

入力データは、AIが加工や分析を行うための材料です。

要約、翻訳、分析、リライトなどのタスクにおいては、この入力データの質と整理の仕方が出力の品質を大きく左右します。

大量のテキストをそのまま流し込むのではなく、どこからどこまでがデータなのかをAIが認識しやすいように記号で区切ることが推奨されます。

例えば、トリプルクォート(”””)やバッククォート(“`)で囲んだり、「### 入力データ ###」といった見出しをつけたりする工夫です。

また、入力データの中にノイズ(不要な広告文やHTMLタグなど)が含まれている場合は、あらかじめ取り除いておくか、プロンプト内で「以下のテキストから本文のみを抽出して処理してください」と指示を加えるのがスマートです。

最新のモデルは長文のコンテキストを処理する能力が非常に高いですが、それでも情報が整理されている方が、重要なポイントを見失わずに処理できます。

データの構造化が難しい場合は、CSV形式やJSON形式などで与えることも、プロンプト設計における有効なテクニックの一つです。

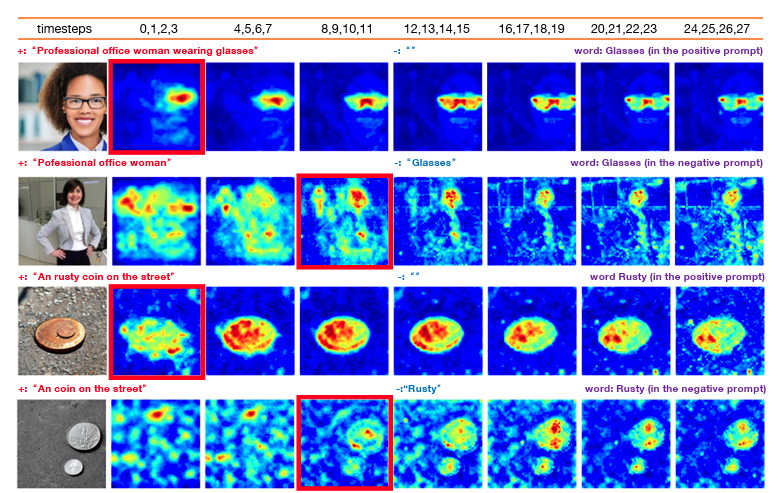

こちらは役割設定(ロールプレイ)がAIの推論精度を向上させる仕組みを解説した論文です。合わせてご覧ください。https://arxiv.org/abs/2308.07702

【出力】回答の形式やトーンを指定する

出力の指定は、最終的なアウトプットをそのまま実務に使える状態にするためのステップです。

「どんなに素晴らしい内容でも、形式がバラバラでは使いにくい」という問題を解決します。

具体的には、箇条書き、表形式、JSON、Markdown、HTMLなど、用途に合わせたフォーマットを指定します。

また、文章のトーン(だ・である調、です・ます調)や、文字数の目安、絶対に含めるべきキーワードなどもここで定義します。

例えば「新入社員にも分かりやすい言葉で、親しみやすいトーンで出力してください」といった情緒的な指定も有効です。

さらに、回答に含めたくない要素がある場合は「専門用語は使わずに」「否定的な表現は避けて」といった制約も重要になります。

出力形式が固定されていると、その後のコピー&ペースト作業やシステム連携がスムーズになります。

特に業務効率化を目指すのであれば、AIに「どのような形で返してほしいか」を厳格に指定するクセをつけることが重要です。

プロンプト設計で活用すべき主要な10の手法

ここからは、プロンプト設計で活用すべき主要な10の手法について解説します。

- ロールプレイ(役割設定)

- Zero-shot / Few-shot Prompting(例示の有無)

- Chain-of-Thought (CoT)(思考プロセスの明示)

- Step-by-Step(段階的な指示)

- Self-Consistency(一貫性の確保)

- Tree-of-Thought (ToT)(思考の木)

- Generate Knowledge Prompting(知識の事前生成)

- 思考プロセスの言語化

- 指示の具体化と曖昧さの排除

- 出力制約による精度のコントロール

これらの手法を組み合わせることで、難易度の高いタスクでもAIから理想的な回答を引き出すことができるようになります。

それでは、1つずつ順に解説します。

ロールプレイ(役割設定)

ロールプレイは、AIに特定の役割を演じさせる手法で、最も手軽かつ効果的なテクニックの一つです。

「あなたはプロの編集者です」「あなたはシニアプログラミングエンジニアです」といった指示を与えることで、AIの出力する語彙や視点がその役割に準拠したものになります。

これにより、一般的すぎる回答を避け、より実用的な専門性を帯びたアウトプットが得られます。

さらに効果を高めるには、役割に加えてその人物のスキルセットや経験年数、性格まで細かく設定します。

例えば「あなたは批判的思考が得意なコンサルタントとして、この企画案の欠点を5つ指摘してください」と指示すれば、単に「改善点を探して」と頼むよりも、より鋭いフィードバックが期待できます。

この手法は、アイデア出しやシミュレーションにおいて特に威力を発揮します。

複数の役割をAIに与えて対話させることで、自分一人では気づけなかった多角的な視点を得ることも可能です。

ロールプレイは、プロンプト設計における「最初の一手」として習慣化しましょう。

Zero-shot / Few-shot Prompting(例示の有無)

Zero-shot Promptingは例を与えずに指示だけを出す方法、Few-shot Promptingはいくつかの例(サンプル)を提示する方法です。

AIに初めて取り組むタスクを依頼する場合、口頭で説明するよりも「例」を見せる方が圧倒的に意図が伝わりやすくなります。

例えば、メールの件名を生成させる際に、好ましい件名の例を3つほど添えるだけで、AIはそのパターンを学習し、同様のトーンで回答してくれます。

例を示す際は、入力と出力のペアを明確にします。

「入力:プロジェクトAの遅延、出力:【重要】プロジェクトAのスケジュール変更について」といった形式です。

これにより、AIは指示内容だけでなく、文字数感や記号の使い方、情報の優先順位までを汲み取ります。

Few-shotは、特定のフォーマットを維持したい場合や、独自のブランドトーンを再現したい場合に非常に強力です。

逆に、創造性を重視し、例に囚われない自由な発想が欲しい場合には、あえて例を示さないZero-shotの方が適していることもあります。

タスクの目的に応じて、使い分けるのがプロの設計術です。

Chain-of-Thought (CoT)(思考プロセスの明示)

Chain-of-Thought(CoT)は、AIに「結論を出す前に、その理由やプロセスを順を追って説明させる」手法です。

AIは時として、複雑な計算や論理推論において、過程を飛ばしてしまい間違った結論(ハルシネーション)を導き出すことがあります。

これを防ぐために、「各ステップで考えたことを出力しながら、最終的な答えを導き出してください」と指示します。

この手法を用いると、AIの回答の正確性が飛躍的に向上します。

特に数学の問題、コードのデバッグ、戦略の立案など、論理的な一貫性が求められる場面で必須のテクニックです。

AIが自分の思考プロセスをテキストとして出力することで、後から人間がその論理に誤りがないかをチェックできるという副次的メリットもあります。

最新のGPT-5.2モデルでは、このCoTの仕組みが内部的にさらに強化されており、「Thinking」モードとして自動で切り替わることがあります。

しかし、プロンプトで明示的に「思考プロセスを書いて」と指示することで、より詳細で透明性の高い推論を引き出すことが可能です。

こちらはChain-of-Thought(CoT)の手法が複雑な推論に与える影響を証明した論文です。合わせてご覧ください。https://arxiv.org/abs/2201.11903

Step-by-Step(段階的な指示)

Step-by-Stepは、指示の最後に「一歩ずつ順を追って考えてください(Let’s think step by step)」という魔法の言葉を添えるだけの非常にシンプルな手法です。

これだけでAIの推論精度が向上することが多くの研究で示されています。

一見してCoTと似ていますが、こちらはより汎用的で、指示を細分化して処理させることに主眼を置いています。

複雑なタスクを依頼する際、AIは全情報を一度に処理しようとして混乱することがあります。

そこで「1. 課題を抽出する、2. 原因を分析する、3. 対策案を3つ出す、4. 最も効果的なものを選ぶ」といった具合に、作業手順をステップ化して明示します。

これにより、各工程でAIが集中すべきポイントが明確になり、全体の品質が底上げされます。

この手法は、マニュアル作成や長文のリサーチレポート作成など、プロセス自体に価値があるタスクに最適です。

AIが途中で脱線するのを防ぎ、ゴールまで確実にナビゲートするための強力なガイドレールとなります。

迷ったら「ステップバイステップで」と付け加えるだけでも、効果を実感できるはずです。

こちらは「一歩ずつ順を追って考えてください」という指示が精度を劇的に改善することを論じた論文です。合わせてご覧ください。https://arxiv.org/abs/2205.11916

Self-Consistency(一貫性の確保)

Self-Consistencyは、AIに同じタスクを複数回(あるいは異なる視点で)考えさせ、最も整合性の高い回答を採用させる手法です。

AIの回答には確率的なゆらぎがあるため、一度の出力だけで判断すると、たまたま精度の低い回答を引いてしまうリスクがあります。

そこで、プロンプト内で「3つの異なる論理ルートで答えを出し、それらを統合して最も信頼できる回答を作成してください」と指示します。

これにより、一つの考え方に偏ることなく、多角的な検証が行われた上での結論が得られます。

データ分析や市場予測など、リスクを伴う意思決定のサポートとしてAIを使う場合に、この手法は極めて有効です。

回答に矛盾がないかをAI自身にチェックさせる工程を設計に組み込むことがポイントです。

最新モデルでは推論能力が高まっているため、自分自身の出力に対する自己批判(セルフ・デバッグ)を行わせることも容易になっています。

「自分の回答に対して反論を出し、それを踏まえて修正案を提示して」というステップを加えることで、一貫性と信頼性はさらに強固なものになります。

Tree-of-Thought (ToT)(思考の木)

Tree-of-Thought(ToT)は、思考を一本の道ではなく「木(Tree)」のように枝分かれさせ、複数の可能性を並行して検討させる高度な手法です。

一つのアイデアから派生するメリット・デメリットをツリー状に展開し、それぞれの枝を評価して、最も有望なルートを選び取らせます。

CoTが直線的な思考なら、ToTは多次元的な思考のシミュレーションと言えます。

プロンプトでは、「まず複数のアプローチを提示し、それぞれを評価して、最適でないものを除外しながら結論に近づいてください」と構造的に指示を出します。

これにより、AIは一度出したアイデアに固執することなく、より広範な解決策の空間を探索できるようになります。

クリエイティブな企画立案や、複雑なパズルを解くようなビジネス課題の解決に威力を発揮します。

この手法は、AIの「探索」能力を最大限に引き出すためのものです。

指示はやや複雑になりますが、GPT-5.2のような高度な推論モデルと組み合わせることで、人間が数日かけて検討するような多角的な分析を数秒で完了させることが可能になります。

こちらは複数の思考パスを並行して検討するTree of Thoughts(ToT)について解説した論文です。合わせてご覧ください。https://arxiv.org/abs/2305.10601

Generate Knowledge Prompting(知識の事前生成)

Generate Knowledge Promptingは、本題のタスクを実行する前に、まずAI自身に関連する知識を書き出させてから、その知識をもとに回答させる手法です。

例えば、「最新のWebデザインのトレンドを3つ挙げてから、それらを取り入れたECサイトの企画案を作成して」といった構成です。

いきなり企画案を考えさせるよりも、まず「知識の土台」を整理させることで、回答の深みが増します。

AIは学習データの中から必要な情報を呼び出す際に、事前に関連ワードを出力させておくことで、その文脈にアクセスしやすくなる性質があります。

これを活用することで、ハルシネーション(もっともらしい嘘)を抑制し、事実に基づいた堅実な提案を引き出しやすくなります。

特に、自分が詳しくない分野についてAIに相談する場合、この手法は非常に助けになります。

「まずこのトピックに関する基本用語を定義してから、分析を始めてください」と指示するだけで、ユーザーとAIの間の情報のギャップが埋まり、より精度の高いコミュニケーションが実現します。

思考プロセスの言語化

思考プロセスの言語化は、AIが回答を生成する際の内面的な「独り言」をあえて表に出させる設計です。

これは、AIに「どのような推論を経てその結論に至ったのか」を詳述させることで、出力の論理的妥当性を担保します。

単に結論を述べるだけでは、その判断が正しいのか、どこかに論理の飛躍がないかを人間が判断しにくいためです。

プロンプトには「回答の前に、どのような方針で、どの情報を重視して考えるかを説明してください」と一文加えます。

これによって、AIは場当たり的な回答を控え、設定された方針に沿って整然とした思考を展開するようになります。

また、ユーザー側にとっても、AIの考え方を知ることで、プロンプトのどの部分が正しく伝わり、どこが誤解されているかを把握する貴重なフィードバックになります。

最新のAIモデルは「思考の質」が格段に向上しており、この言語化されたプロセス自体が、人間にとっても新しい気づきや学びになることが少なくありません。

思考のブラックボックス化を防ぎ、AIを賢く使いこなすための重要な作法と言えるでしょう。

指示の具体化と曖昧さの排除

指示の具体化は、プロンプト設計の基本にして究極のポイントです。

「良い感じに」「適当に」「詳しく」といった形容詞や副詞は、人間同士でも誤解を招くことがありますが、AIに対しても同様に曖昧さを残します。

これらを数値や具体的な条件に置き換えることが、設計の鉄則です。

「詳しく」なら「500文字程度で、具体例を2つ含めて」と指示し、「良い感じに」なら「明るく前向きな言葉を使い、読者の不安を解消するように」と具体化します。

また、否定的な指示(〜しないでください)よりも、肯定的な指示(〜してください)の方がAIは理解しやすい傾向にあります。

ただし、どうしても避けたい要素がある場合は、禁止事項リストとして明確に列挙するのが効果的です。

「専門用語は使わない」ではなく「中学生でも理解できる日常的な言葉に言い換えて」といった具合に。

曖昧さを排除したプロンプトは、再現性が高くなります。

一度成功したプロンプトを他のタスクに転用する際も、条件が具体化されていれば調整が容易です。

言葉の一つひとつに、AIが迷う隙を与えない「厳密さ」を持たせることが、プロンプト設計の醍醐味です。

出力制約による精度のコントロール

出力制約は、回答の「枠組み」を厳しく設定することで、AIの創造性を適切な方向に集中させる手法です。

例えば、回答の構成を「1. 結論、2. 理由、3. 事例、4. まとめ」と固定したり、「回答は必ず300文字以内に収めてください」といった物理的な制限をかけたりします。

また、「回答の中で一度も『AI』という言葉を使わない」といったユニークな制約も、実は精度の向上に寄与することがあります。

制約を設けることで、AIは限られたリソースの中で最善の出力をしようと「工夫」を始めます。

これは、俳句や短歌が文字数の制約があるからこそ洗練された表現が生まれるのと似ています。

制約がなさすぎると、AIは長々と無駄な文章を生成しがちですが、制約をかけることで情報の密度が上がり、要点が明確になります。

ビジネス文書やSNS投稿の作成など、特定の規格が決まっているタスクにおいて、出力制約は欠かせない要素です。

指示の中に「#制約事項」という項目を設け、箇条書きでルールを徹底させる設計を心がけましょう。

これにより、手直し不要な完成度の高いアウトプットが得られるようになります。

公平性を保ちバイアスを軽減するためのプロンプト設計テクニック

ここからは、公平性を保ちバイアスを軽減するためのプロンプト設計テクニックについて解説します。

- AIが生成する回答に潜む「バイアス」のリスク

- 公平な視点で回答させるための具体的な指示方法

- 多角的な視点を取り入れ「中立性」を確保するコツ

AIの回答に含まれる偏りやバイアスを理解し、それをプロンプトで制御することは、倫理的なAI活用において非常に重要です。

それでは、1つずつ順に解説します。

AIが生成する回答に潜む「バイアス」のリスク

AIが生成する回答には、学習データに起因するさまざまなバイアスが含まれている可能性があります。

これには、人種、性別、年齢、職業、宗教に関するステレオタイプや、文化的・政治的な偏りが含まれます。

例えば、特定の職業を暗黙のうちに特定の性別と結びつけたり、西欧的な価値観を前提とした回答を出力したりといったケースです。

これらは、無意識のうちに特定のグループを差別したり、不当な評価を与えたりするリスクを孕んでいます。

特に企業の公式なアウトプットとしてAIを活用する場合、これらのバイアスが含まれたまま公開されると、ブランドイメージの失墜や社会的な批判を招く恐れがあります。

AIはあくまで過去のデータの集積から回答を生成するため、現代の倫理観や最新の公平性の基準に完全に従っているとは限りません。

設計者は、AIが決して「中立な知性」ではなく、データの偏りを引き継いだ存在であることを前提にする必要があります。

その上で、プロンプトを通じて意図的にその偏りを修正し、公平な出力を促す設計を組み込むことが求められます。

バイアスが含まれた回答の公開は重大な企業リスクです。プロンプト流出や情報漏洩といった生成AIの企業利用リスクと対策については、こちらの記事で徹底解説しています。 合わせてご覧ください。

公平な視点で回答させるための具体的な指示方法

公平な回答を引き出すためには、プロンプト内で明示的に「公平性」と「包括性(インクルーシブ)」を指示することが重要です。

単に「中立に書いて」と言うだけではなく、「特定の属性(性別、人種、年齢など)に対してステレオタイプを強化するような表現は避けてください」と具体的に禁止事項を設けます。

また、「多様な文化的背景を持つ読者が読むことを前提に、誰にとっても配慮の行き届いた表現を使ってください」といった指示も有効です。

具体的な設計テクニックとしては、AIに「客観的な第三者」の立場を与え、個人の主観や好みを排除させる指示が挙げられます。

さらに、回答を生成する前に「この回答に潜在的なバイアスが含まれていないかを確認し、もしあれば修正してから出力してください」という自己検閲のステップを加えることも効果的です。

また、ジェンダーフリーな言葉遣い(例えば、看護婦ではなく看護師、サラリーマンではなく会社員など)を指定することも、バイアスを軽減する実務的なアプローチです。

設計の段階でこれらの配慮を言語化しておくことが、AIを誠実なツールとして機能させるための第一歩です。

多角的な視点を取り入れ「中立性」を確保するコツ

中立性を確保するための最も効果的なコツは、AIに「一つの正解」を求めず、「複数の異なる立場」から論じさせることです。

例えば、社会的な議論があるテーマについて回答を求める際、「賛成派、反対派、そして慎重派それぞれの主要な論点と、それらに対する反論を公平にまとめてください」と指示します。

これにより、AIが特定の意見に同調することなく、情報のバランスを保った回答を出力できます。

また、「自身の主観を排除し、事実に基づいたデータのみを列挙してください」という指示や、「情報源の偏りを指摘してください」というメタ的な指示も有効です。

AIは指示されたフレームワークに忠実に従うため、検討すべき視点のリストをプロンプトに盛り込んでおくことで、視野の狭い回答を防ぐことができます。

最新のGPT-5.2モデルでは「出力中心の安全性」という概念がさらに強化されており、不適切なバイアスの出力に対してより強固なフィルターがかかっています。

しかし、最後は人間の設計スキルが重要です。

AIを「正解を出す機械」ではなく「多角的な視点を提供する鏡」として設計することが、真の中立性を実現する鍵となります。

失敗しないプロンプト設計の5ステップ

ここからは、失敗しないプロンプト設計の5ステップについて解説します。

- STEP1:解決したい課題とゴールの定義

- STEP2:プロンプトの骨組み(構造)を作成する

- STEP3:変数や制約事項を盛り込む

- STEP4:実際にテストして出力結果を評価する

- STEP5:実用レベルまで微調整(チューニング)を行う

この5つのステップを順を追って進めることで、誰でも迷わずに精度の高いプロンプトを構築できるようになります。

それでは、1つずつ順に解説します。

STEP1:解決したい課題とゴールの定義

プロンプト設計の第一歩は、AIを使って「何を解決したいのか」を極めて具体的に言語化することです。

ここが曖昧なままでは、どんなに優れたテクニックを使っても納得のいく回答は得られません。

「業務の効率化」といった抽象的な目標ではなく、「週次ミーティングの録音データから、決定事項と宿題を抽出し、担当者ごとのタスク表をMarkdown形式で作成する」というレベルまで解像度を上げます。

この段階では、最終的なアウトプットの「成功イメージ」を明確にします。

どのようなトーンか、文字数はどのくらいか、誰がその回答を読むのか、といった要素をすべて書き出します。

ゴールが明確になれば、AIに与えるべき情報(入力)と、AIが守るべきルール(制約)が自然と見えてきます。

「なんとなく便利そうだから使う」のではなく、特定の課題に対する「解決策のプロトタイプ」としてプロンプトを位置づけることが大切です。

まずは紙やテキストエディタに、解決したいこととゴールを一行で書き出すことから始めましょう。

STEP2:プロンプトの骨組み(構造)を作成する

ゴールが決まったら、次はプロンプトの構造を作ります。

ここでは、前述した「4つの構成要素(命令・背景・入力・出力)」を配置し、AIが情報を処理しやすいレイアウトを組み立てます。

プロンプトは上から下へと流れるように構成するのが基本です。

まず冒頭に「命令」を置き、次にその根拠となる「背景」を説明し、中段に「入力データ」の置き場を作り、最後に「出力の指示」で締めくくるのが王道です。

情報を構造化するために、セクションごとの見出しをつけるのがコツです。

「# 命令」「# 前提条件」「# 入力データ」「# 出力形式」といった具合にハッシュタグや記号を使い、視覚的にもAIがセクションを認識しやすくします。

この骨組みがしっかりしていれば、後から詳細を付け足したり修正したりするのが非常に楽になります。

構造化されたプロンプトは、AIにとっても「どこを読めばいいか」が明確な地図となります。

美しい構造は、そのまま回答の論理性につながります。

このステップでは、まだ内容を細かく書きすぎず、全体の流れと情報の配置を決定することに集中しましょう。

STEP3:変数や制約事項を盛り込む

骨組みができたら、そこに具体的な詳細と制約を肉付けしていきます。

ここでのポイントは、プロンプトの汎用性を高めるための「変数」と、出力をコントロールするための「制約」の使い分けです。

変数は、例えば「ターゲット:[ここにターゲットを記載]」のように、後から書き換えて使い回せる部分です。

これにより、一度作ったプロンプトを複数のプロジェクトで活用できるようになります。

制約事項には、絶対に守らせたいルールを箇条書きで追加します。

「箇条書きで回答すること」「専門用語には必ず注釈をつけること」「否定的な表現は一切使わないこと」など、厳格であればあるほどAIの出力は安定します。

また、この段階で「Step-by-Step」や「ロールプレイ」などの具体的な手法を一つ二つ選んで組み込むと、さらに精度が向上します。

制約は多すぎるとAIが混乱することもありますが、重要なルールは明確に伝えなければなりません。

優先順位を意識しながら、AIにとっての「行動規範」をプロンプトの中に構築していきましょう。

STEP4:実際にテストして出力結果を評価する

設計したプロンプトを実際にAIに入力し、どのような回答が返ってくるかをテストします。

一度の入力で完璧な回答が返ってくることは稀ですので、ここでは「評価者」としての視点を持つことが重要です。

返ってきた回答が、STEP1で定義したゴールを満たしているか、制約をすべて守っているか、論理的な矛盾はないか、といった観点で厳しくチェックします。

評価の際は、たまたま一度だけうまくいったのか、それとも再現性があるのかを確認するために、同じプロンプトで2、3回は試行することをお勧めします。

もし回答が期待外れだった場合は、どこでAIが誤解したのかを推測します。

「背景が足りなかったのか」「指示が曖昧だったのか」「入力データの渡し方が悪かったのか」を冷静に分析します。

このテスト工程を怠ると、実務で使い始めた際に予期せぬエラーや低品質な回答に悩まされることになります。

トライアンドエラーを楽しむくらいの気持ちで、AIとの対話を繰り返していきましょう。

STEP5:実用レベルまで微調整(チューニング)を行う

テストの結果を受けて、プロンプトを細かく修正していくのが最終ステップのチューニングです。

AIが誤解したポイントを特定し、それを解消するための具体的な一文を加えたり、逆に不要な指示を削ったりします。

また、出力形式の指定をより厳格にしたり、例示(Few-shot)を追加してAIに具体的なイメージを掴ませたりするのも有効です。

チューニングのコツは、一度に多くの箇所を直さないことです。

一箇所直すごとにテストを行うことで、どの修正が効果を発揮したのかが明確になります。

このプロセスを繰り返すことで、プロンプトは「完成されたツール」へと進化していきます。

最新のGPT-5.2などの高度なモデルであれば、少ない調整で驚くほどの精度向上を見せることがあります。

実務でストレスなく使えるレベルまで磨き上げられたプロンプトは、あなたやチームの生産性を何倍にも引き上げてくれる強力な資産となるはずです。

さらに精度を磨き上げるための実践的なコツ

ここからは、さらに精度を磨き上げるための実践的なコツについて解説します。

- 否定形を避け「肯定形」で指示を出す

- 複雑な指示は小さなタスクに分解する

- 記号や改行を使い、構造を視覚的に伝える

- AIとの対話を通じてプロンプトを育てる

これらのテクニックを日常的に取り入れることで、プロンプト作成のスピードと質が格段に向上します。

それでは、1つずつ順に解説します。

否定形を避け「肯定形」で指示を出す

AIは「〜しないでください」という否定的な指示よりも、「〜してください」という肯定的な指示を理解しやすく、実行に移しやすいという特性があります。

否定形を使うと、AIは「何をしないか」を意識した後に、代わりに「何をするか」を推測しなければなりません。

このプロセスで意図がズレるリスクが生じます。

例えば「冗長な文章を書かないで」ではなく「簡潔な文章で結論から書いて」と指示する方が、AIは迷いなくタスクを遂行できます。

もちろん、誤情報の生成を防ぐなどの目的で「〜しないで」と書くことが必要な場面もあります。

その場合でも、「〜ではなく、〜してください」といった具合に、代替となる正しい行動をセットで提示するのがコツです。

肯定形での指示は、AIの行動をポジティブに制限し、望ましい結果へと最短距離で誘導します。

プロンプトを見直す際は、否定的な表現をどれだけ肯定的な指示に置き換えられるかを意識してみてください。

これだけで、AIの出力の「キレ」が良くなるのを実感できるはずです。

こちらは否定的な指示(ネガティブプロンプト)がモデルに与える影響を分析した論文です。合わせてご覧ください。https://arxiv.org/abs/2406.02965

複雑な指示は小さなタスクに分解する

一つの大きなプロンプトにすべての要望を詰め込むと、AIの処理能力が分散され、個々のタスクの精度が低下しやすくなります。

これを防ぐには、複雑なタスクを独立した小さなサブタスクに分解し、段階的に指示を出す手法が非常に有効です。

例えば、「市場調査をして、その結果をもとに企画書を書き、さらにプレゼン資料の構成を作って」と一度に頼むのではなく、まずは市場調査だけを依頼します。

その結果を確認・修正した上で、次に「この調査結果をもとに企画書を書いて」と次のステップへ進みます。

このように「指示→確認→指示」のサイクルを回すことで、各工程での品質を確実に担保できます。

この手法は、特に長文の作成や、多段の論理推論が必要なタスクで威力を発揮します。

一度にすべてをやらせようとせず、AIと一緒に階段を一段ずつ登っていく感覚で設計を行うことが、結果として最も早く高品質な成果に到達する近道です。

記号や改行を使い、構造を視覚的に伝える

プロンプトは、人間にとっての読みやすさだけでなく、AIにとっても「情報の区切り」が視覚的に(あるいはトークン構造的に)明確であることが重要です。

文章がだらだらと続く長文プロンプトは、AIが重要な指示を見落とす原因になります。

そこで、改行、箇条書き、括弧【 】、ハッシュタグ #、デリミタ(— や ===)などを積極的に活用し、プロンプトをブロック化します。

「ここからが背景情報」「ここからが制約事項」といった具合に境界線を引くことで、AIはそれぞれの情報の重みを正確に理解できるようになります。

また、重要な指示には「★重要★」といったタグをつけたり、通し番号を振ったりすることも効果的です。

構造化されたプロンプトは、修正や管理もしやすくなります。

まるでプログラミングコードを書くように、美しく整理されたプロンプトを目指しましょう。

AIはあなたの丁寧な構造化に応えるように、整理され、筋の通った回答を返してくれるようになるはずです。

AIとの対話を通じてプロンプトを育てる

最初から完璧なプロンプトを一発で書こうとする必要はありません。

むしろ、AIとの実際のやり取りを通じて、プロンプトを「育てていく」という感覚を持つことが、高度な設計スキルを身につける秘訣です。

AIからの回答が惜しいものであれば、その場で「今の回答の、ここをもっとこうして」とフィードバックを与え、より良い回答が出るまで対話を重ねます。

そして、最終的に満足のいく回答が得られたら、その過程で有効だった指示を元のプロンプトに組み込みます。

こうしてブラッシュアップされたプロンプトは、あなたの意図を深く反映した、まさに「自分専用の魔法の杖」になります。

また、AIに対して「このプロンプトをもっと精度を上げるには、どう修正すればいい?」と直接アドバイスを求めるのも一つの手です。

AI自身の性質をAIに尋ねることで、自分では思いつかなかったような具体的な制約や背景設定のアイデアが得られることもあります。

AIを教師とし、対話を通じてプロンプトを進化させていきましょう。

プロンプト設計の学習に役立つ参考サイト・リソース

ここからは、プロンプト設計の学習に役立つ参考サイト・リソースについて解説します。

- 実践的なテンプレートが探せるプロンプト配布サイト

- 最新の設計手法を学べる公式ドキュメントとコミュニティ

最新の情報を常にアップデートし、優れた事例に触れ続けることが、設計スキルを向上させる最短ルートです。

それでは、1つずつ順に解説します。

実践的なテンプレートが探せるプロンプト配布サイト

プロンプト設計を学ぶ上で、ゼロからすべてを作る必要はありません。

世の中には、多くの有志や企業が公開している「プロンプトテンプレート配布サイト」が数多く存在します。

これらのサイトでは、プロの設計者が作成した、特定の業務(メール作成、SEO記事作成、プログラミング、画像生成など)に特化した高品質なプロンプトを無料または有料で見つけることができます。

まずはこうしたサイトで公開されているプロンプトをコピーして使ってみてください。

「なぜこのプロンプトにはこの指示が入っているのか?」「この記号にはどんな意味があるのか?」と分解して分析することで、設計のセオリーが自然と身につきます。

また、自分の業務に近いテンプレートを見つけ、それをベースにカスタマイズしていくのが、実務導入の最も効率的な方法です。

優れたプロンプトは、優れた「思考の型」の集合体です。

多くの成功事例に触れることで、自分の設計の引き出しが格段に増えていくはずです。

日頃からこうしたリソースをチェックする習慣をつけましょう。

こちらはプロンプト設計に関する最新の研究やテクニックを網羅した学習ガイドです。合わせてご覧ください。https://www.promptingguide.ai/

最新の設計手法を学べる公式ドキュメントとコミュニティ

生成AIの技術進化は極めて速いため、常に「一次情報」に触れることも欠かせません。

OpenAIやAnthropic、Googleといった主要なAI開発ベンダーが公開している公式ドキュメントには、そのモデルの能力を最大限に引き出すための「プロンプトエンジニアリング・ガイド」が用意されています。

これらのドキュメントは、最新モデルのアップデートに合わせて随時更新されるため、最も信頼できる情報源となります。

また、GitHubやReddit、日本のZennやQiitaといったエンジニア・クリエイターコミュニティでは、日々新しい設計手法や実験結果が共有されています。

「GPT-5.2でこのプロンプトを試したら精度が上がった」といったリアルタイムの知見は、こうしたコミュニティから生まれることが多いです。

公式ドキュメントで「正解」を学び、コミュニティで「実践的な工夫」を学ぶ。

この両輪を回すことで、あなたは常にプロンプト設計の最前線に居続けることができます。

情報の荒波を楽しみながら、AIと共に成長していきましょう。

こちらはOpenAIが公式に提供しているプロンプトエンジニアリングのベストプラクティスです。合わせてご覧ください。https://platform.openai.com/docs/guides/prompt-engineering

#参考情報(ChatGPTに関する正確な最新情報)

2025年12月11日にOpenAIがリリースした最新言語モデル「GPT-5.2」は、前モデルの推論力をさらに高め、実務における回答の信頼性と処理速度を大幅に向上させた点が特徴です。

主な特徴

- 3つの最適化モデル:日常的なタスク用の「Instant」、複雑な課題を深掘りする「Thinking」、最も困難な問題や自律的なワークフローに対応する最高峰の「Pro」が提供されています。

- 精度の向上:ハルシネーション(誤回答)率が旧モデル比で大幅に低下し、特に数学、コーディング、長文ドキュメント分析の精度が飛躍的に改善しました。

- コンテキストの拡大:最大40万トークンの入力をサポートし、複数の膨大な資料を一括で読み込ませた上での一貫した分析が可能です。

利用方法と料金

- ChatGPT:Plus以上の有料ユーザーは、各モデル(Instant / Thinking / Pro)をタスクに合わせて選択または自動切り替えで利用可能です。

- API:gpt-5.2、gpt-5.2-miniなどが提供され、入力コストが抑えられた一方で、思考トークンに対する新しい課金体系が適用されています。 制限:

- 無料プラン:利用上限があり、Thinkingモードや最新機能の利用回数に制限が設けられています。

- 有料プラン (Plus/Proなど):メッセージ上限が大幅に緩和され、最上位のProプランでは制限なしで最高精度の推論モデルを利用可能です。

- 法人利用:Enterpriseプラン等では、自律型エージェント機能との連携により、ブラウザを通じた自律的なタスク実行までサポートされます。

AIに指示を出す「設計力」が、2026年以降の市場価値を左右する理由

プロンプト設計は単なる作業の効率化テクニックではなく、これからのビジネスパーソンにとっての必須言語といえます。ハーバード大学とボストンコンサルティンググループ(BCG)による共同研究では、AIを適切に使いこなす層は、そうでない層に比べて生産性が約40%向上し、成果物の質も18%高まることが示されました。しかし、ここで注目すべきはAIに丸投げすることの危険性です。AIが出した答えの妥当性を評価し、さらに高い次元へと導くための設計力こそが、個人の希少性を高める鍵となります。

これからの時代、AIを使いこなせる人とそうでない人の間には、埋められないほどの格差が生じると予測されています。AIを単なる検索の代わりとして使うのではなく、自らの思考を拡張させるパートナーとして再定義できるかどうかが、キャリアの明暗を分けるでしょう。

引用元:

Dell’Acqua, F., McFowland, E., et al. “Navigating the Jagged Technological Frontier: Field Experimental Evidence of the Effects of AI on Knowledge Worker Productivity and Quality.” Harvard Business School Working Paper, No. 24-013, 2023 (Revised 2024).

まとめ

企業の競争力が生成AIの活用度合いに直結する時代において、プロンプト設計のスキルを磨くことは非常に重要です。

しかし、日々の業務に追われる中で「高度なプロンプトを一から設計する時間がない」「社内にノウハウを共有する仕組みが整っていない」といった課題を抱える企業も少なくありません。

そこでおすすめしたいのが、Taskhubです。

Taskhubは、本記事で解説したような複雑なプロンプト設計を必要とせず、200種類以上の実用的なAIタスクをアプリ形式で選ぶだけで即座に実行できる生成AIプラットフォームです。

議事録作成やレポート分析、メール文案作成など、専門的な設計スキルがなくても、誰でも高い精度でAIを使いこなすことが可能です。

基盤にはAzure OpenAI Serviceを採用しているため、企業の機密情報がAIの学習に利用されることはなく、最高水準のセキュリティ環境で安心して導入いただけます。

さらに、専門のAIコンサルタントが導入から運用まで伴走するため、自社に最適な活用方法を最短距離で見つけ出すことができます。

まずは、具体的な機能や活用シーンを網羅した【サービス概要資料】を無料でダウンロードしてください。

Taskhubを導入して、個人のスキルに依存しない組織的な業務効率化とDXを実現しましょう。

AIの回答精度を高めるための具体的な手法や、バイアスを軽減するための設計思想について詳しく解説しました。

最新モデルであるGPT-5.2の登場により、AIができることは飛躍的に広がりましたが、それを最大限に引き出せるかどうかは、使い手である人間の設計力にかかっています。

本記事で紹介した10の手法や5つのステップを参考に、ぜひ今日から実務でプロンプト設計を取り入れてみてください。

AIを単なるツールとしてではなく、共に成長するパートナーとして迎え入れることで、あなたの仕事の質は劇的に変わるはずです。

最後までご覧いただきありがとうございました。