「自社でも生成AIを導入して業務効率化を図りたいけど、何から始めればいいかわからない…。」

「生成AIの導入にはどんなリスクや課題があるんだろう?失敗したくない…。」

こういった悩みを持っている方もいるのではないでしょうか?

本記事では、企業が生成AIを導入する際に直面する9つの具体的な課題と、それぞれの解決策について詳しく解説します。

多くの企業で生成AI導入のコンサルティングを行ってきた弊社の知見を基に、実践的な内容のみをご紹介します。

この記事を読めば、生成AI導入の全体像と乗り越えるべきハードルが明確になるはずです。ぜひ最後までご覧ください。

【課題①】生成AI導入におけるデータの正確性やバイアス

生成AIを導入する上で最初の壁となるのが、アウトプットの信頼性です。

生成AIは常に正しい情報を出力するわけではなく、その性質を理解しないまま業務に利用すると、思わぬトラブルにつながる可能性があります。

ここでは、生成AI導入におけるデータの正確性やバイアスに関する2つの課題を解説します。

- ハルシネーション(もっともらしい嘘)のリスク

- 学習データに起因するバイアスの問題

それでは、1つずつ順に解説します。

ハルシネーション(もっともらしい嘘)のリスク

ハルシネーションとは、生成AIが事実に基づかない情報を、あたかも真実であるかのように生成する現象のことです。

これは、AIが学習したデータの中に存在しない、あるいは誤った情報を組み合わせて回答を生成してしまうために発生します。

例えば、市場調査レポートの作成をAIに指示した際に、存在しない統計データや架空の企業名を引用してしまうケースが考えられます。

このような誤った情報に基づいて経営判断を下してしまうと、企業に大きな損害を与える可能性があります。

ハルシネーションのリスクを低減するためには、生成された情報のファクトチェックが不可欠です。

特に重要な意思決定に利用する情報や、社外向けの公式な文章を作成する際には、必ず人間の目による確認と修正を行う体制を構築する必要があります。

また、出力の根拠となる情報源を明記するようにAIに指示することも有効な対策の一つです。

学習データに起因するバイアスの問題

生成AIの回答は、学習に用いられたデータセットに大きく依存します。

その学習データに偏見や差別的な内容が含まれている場合、AIの生成物にも意図せずバイアスが反映されてしまう可能性があります。

例えば、特定の性別や人種に対する固定観念に基づいた文章を生成してしまったり、特定の政治的見解に偏った意見を述べたりすることがあります。

このようなバイアスのかかったコンテンツを企業の公式な発信として利用してしまうと、ブランドイメージの低下や社会的な批判を招くリスクがあります。

この問題に対処するためには、まず自社が利用する生成AIの学習データにどのような傾向があるのかを把握することが重要です。

その上で、AIの利用に関する明確なガイドラインを策定し、社員に周知徹底することが求められます。

生成された内容に偏りがないか、多様な視点からチェックするプロセスを業務フローに組み込むことも有効です。

こちらは、SASが公開している生成AIが抱える課題やリスクに関する詳細なレポートです。合わせてご覧ください。 https://www.sas.com/content/dam/SAS/documents/marketing-whitepapers-ebooks/ebooks/en/generative-ai-challenges-113838.pdf

【課題②】生成AI導入におけるモデルのカスタマイズと独自データ不足

多くの企業が生成AIを導入する際、汎用的なモデルをそのまま利用するケースが多いですが、それだけでは十分な成果を得られないことがあります。

自社のビジネスに特化した価値を生み出すためには、モデルのカスタマイズが重要になります。

ここでは、生成AI導入におけるモデルのカスタマイズと独自データに関する2つの課題を解説します。

- 自社の業務に合わせたチューニングが困難

- 独自データがなければ競合との差別化が難しい

それでは、1つずつ順に解説します。

自社の業務に合わせたチューニングが困難

市販されている生成AIツールは、一般的なタスクには対応できるものの、特定の業界や企業独自の専門用語、業務フローに最適化されているわけではありません。

例えば、法律事務所が契約書のレビューにAIを使おうとしても、業界特有の言い回しや判例を理解できず、的外れな指摘をしてしまう可能性があります。

このような課題を解決するためには、ファインチューニングやRAG(検索拡張生成)といった技術を用いて、AIモデルを自社の業務に合わせてカスタマイズする必要があります。

ファインチューニングは、自社が保有するデータを追加で学習させることで、AIの知識や応答スタイルを調整する手法です。

しかし、これには質の高い大量の学習データと、AIに関する高度な専門知識が必要となり、多くの企業にとってハードルが高いのが現状です。

独自データがなければ競合との差別化が難しい

生成AIを導入する企業が増える中で、他社と同じ汎用的なAIモデルを使っているだけでは、競争優位性を築くことは困難です。

AIを活用して独自のサービスや価値を提供するためには、自社が長年蓄積してきた独自のデータをAIに学習させることが不可欠です。

例えば、顧客からの問い合わせ履歴や過去のプロジェクトデータ、社内マニュアルなどを学習させることで、より精度の高い顧客対応や、自社のノウハウが詰まった提案書の作成が可能になります。

このように独自データを活用することで、競合他社には真似のできない、パーソナライズされたAI活用が実現します。

しかし、多くの企業ではデータが各部署に散在していたり、形式が統一されていなかったりと、AIの学習に使える状態になっていないケースが少なくありません。

生成AIの導入を成功させるためには、まず社内のデータを整理・統合し、AIが活用できるようなデータ基盤を整備することが重要な第一歩となります。

こちらの記事では、ChatGPTを会社で導入する際の方法から具体的な注意点まで網羅的に解説しています。合わせてご覧ください。 https://taskhub.jp/useful/chatgpt-use-in-company/

【課題③】生成AI導入における専門知識(スキル)の不足

生成AIのポテンシャルを最大限に引き出すためには、ツールを導入するだけでなく、それを使いこなす人材の育成が不可欠です。

しかし、多くの企業ではAIに関する専門知識を持つ人材が不足しており、導入の大きな障壁となっています。

ここでは、生成AI導入における専門知識(スキル)の不足に関する2つの課題を解説します。

- AIを使いこなせる人材が社内にいない

- プロンプトエンジニアリングの重要性

それでは、1つずつ順に解説します。

AIを使いこなせる人材が社内にいない

生成AIを導入したものの、「具体的にどう使えば業務が効率化されるのかわからない」「一部の詳しい社員しか使っておらず、全社的に活用が広がらない」といった声は少なくありません。

AIを効果的に活用するためには、AIの特性を理解し、自社のどの業務に適用できるかを見極めるスキルが必要です。

また、AIモデルの選定や導入プロジェクトの推進、導入後の効果測定など、各フェーズで専門的な知識が求められます。

こうしたAI人材は市場全体で不足しており、採用は非常に困難です。

そのため、外部の専門家の支援を受けつつ、社内でAI人材を育成していく長期的な視点が重要になります。

まずは特定の部署でスモールスタートし、成功事例を作りながら全社に展開していくアプローチが現実的です。

研修や勉強会を定期的に開催し、社員全体のAIリテラシーを底上げしていく取り組みも欠かせません。

プロンプトエンジニアリングの重要性

生成AIから精度の高い回答を引き出すためには、「プロンプト」と呼ばれる指示文の質が極めて重要になります。

このプロンプトを工夫し、AIの性能を最大限に引き出す技術を「プロンプトエンジニアリング」と呼びます。

例えば、「ブログ記事を書いて」という曖昧な指示では、ありきたりな内容しか生成されません。

しかし、「あなたはプロのマーケターです。SEOに強く、読者の悩みに寄り添うような口調で、〇〇というキーワードを含んだブログ記事を1500字で書いてください」といったように、役割や文脈、制約条件を具体的に与えることで、生成物の質は劇的に向上します。

多くの企業では、このプロンプトエンジニアリングのスキルが不足しているため、AIを導入しても「期待したような成果が出ない」という状況に陥りがちです。

社員が効果的なプロンプトを作成できるよう、社内で優れたプロンプトの事例を共有したり、テンプレートを作成して配布したりするなどの工夫が求められます。

【課題④】生成AI導入におけるコストとビジネスケースの正当性

生成AIの導入には、技術的なハードルだけでなく、経済的な課題も存在します。

経営層を納得させ、必要な予算を確保するためには、コストに見合う効果を具体的に示す必要があります。

ここでは、生成AI導入におけるコストとビジネスケースの正当性に関する2つの課題を解説します。

- 初期費用・運用コストの高さ

- 投資対効果(ROI)の説明が難しい

それでは、1つずつ順に解説します。

初期費用・運用コストの高さ

生成AIの導入には、様々なコストが発生します。

まず、高性能なAIモデルを利用するためのライセンス費用やAPI利用料がかかります。

自社で独自のAIモデルを開発・運用する場合には、高性能なサーバー(GPU)の購入費や維持費、さらには専門知識を持つエンジニアの人件費など、莫大な初期投資が必要となることもあります。

また、導入後も継続的にコストが発生します。

AIを安定して稼働させるためのメンテナンス費用や、新たなデータを取り込んでモデルの精度を維持・向上させるための追加学習コストなど、ランニングコストも考慮しなければなりません。

これらのコストを事前に正確に見積もり、事業計画に組み込んでおくことが重要です。

まずはクラウドベースのサービスを利用してスモールスタートし、効果を見ながら段階的に投資を拡大していくアプローチがリスクを抑える上で有効です。

投資対効果(ROI)の説明が難しい

生成AIの導入によって得られる効果は、単純なコスト削減だけでなく、業務品質の向上や新たなビジネスチャンスの創出など、多岐にわたります。

しかし、これらの効果は定量的に測定することが難しく、投資対効果(ROI)を明確に算出するのが困難な場合があります。

例えば、「問い合わせ対応の時間を30%削減する」といった直接的な効果は測定しやすいですが、「従業員の創造性が向上し、新しいアイデアが生まれやすくなった」といった間接的な効果を金額に換算するのは容易ではありません。

そのため、経営層に対して導入のメリットを説明し、予算を獲得するのに苦労するケースが多く見られます。

ROIを説明する際には、定量的な効果だけでなく、定性的な効果も合わせて提示することが重要です。

例えば、競合他社の導入事例や、導入しなかった場合に失われる機会(機会損失)などを具体的に示すことで、説得力を高めることができます。

まずは特定の業務に絞って実証実験(PoC)を行い、具体的な成功事例を作ることも、本格導入に向けた承認を得るための有効な手段となります。

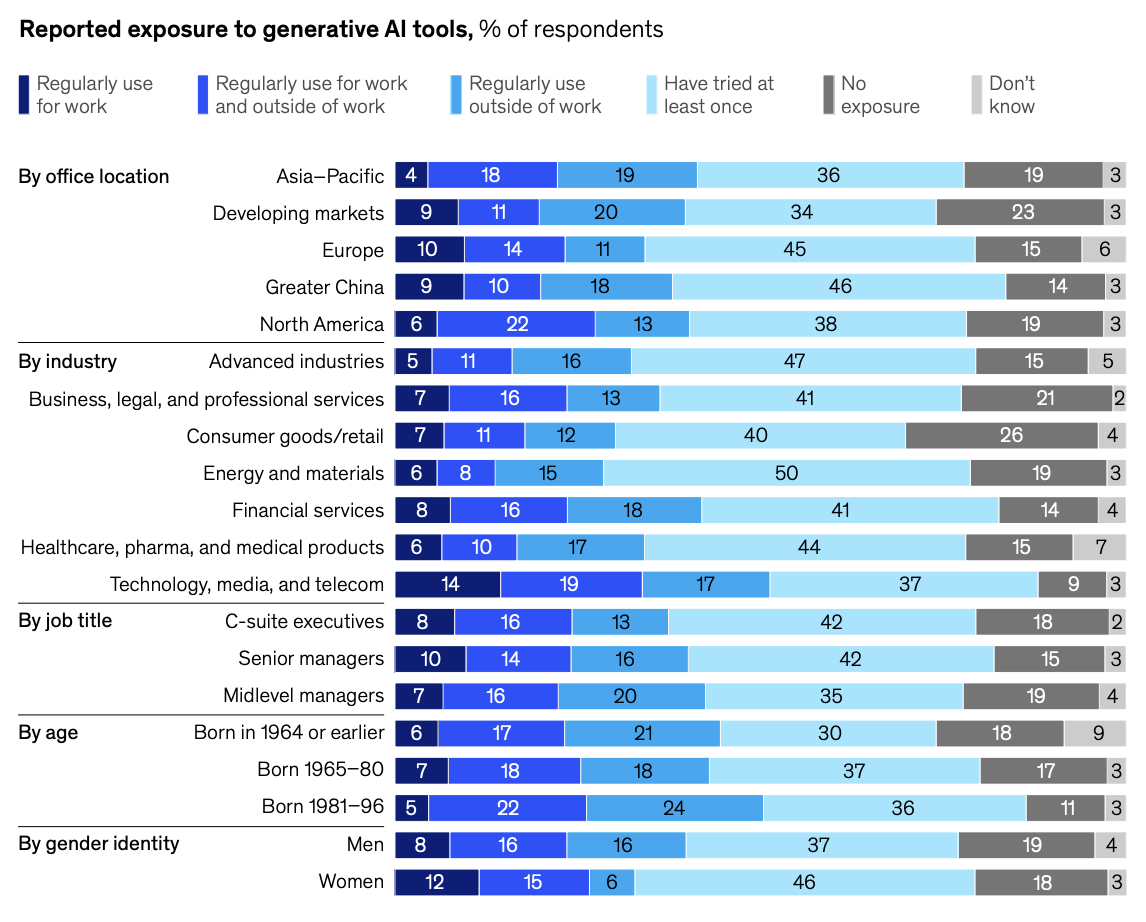

こちらは、McKinsey & Companyが発行した、世界のAI導入の現状と経済的インパクトに関する包括的なレポートです。合わせてご覧ください。 https://www.mckinsey.com/~/media/mckinsey/business%20functions/quantumblack/our%20insights/the%20state%20of%20ai%20in%202023%20generative%20ais%20breakout%20year/the-state-of-ai-in-2023-generative-ais-breakout-year_vf.pdf

【課題⑤】生成AI導入におけるデータプライバシーと機密性

生成AIの利用が拡大する一方で、入力した情報がどのように扱われるのか、セキュリティ上の懸念が高まっています。

特に顧客情報や企業の機密情報を取り扱う際には、細心の注意が必要です。

ここでは、生成AI導入におけるデータプライバシーと機密性に関する2つの課題を解説します。

- 入力した情報が学習に使われるリスク

- 情報漏洩やセキュリティに関する懸念

それでは、1つずつ順に解説します。

入力した情報が学習に使われるリスク

多くの一般向け生成AIサービスでは、ユーザーが入力した情報をAIモデルの品質向上のための再学習に利用することがあります。

これは、AIの性能を高める上で重要なプロセスですが、企業が利用する上では大きなリスクとなります。

もし社員が顧客の個人情報や社外秘のプロジェクト情報をプロンプトに入力してしまった場合、その情報がAIの学習データとして取り込まれ、他のユーザーへの回答として出力されてしまう可能性がゼロではありません。

このような事態が発生すれば、企業の信用を著しく損なうだけでなく、法的な責任を問われることにもなりかねません。

このリスクを回避するためには、入力したデータが再学習に利用されない、法人向けのAIサービスを選定することが不可欠です。

代表的な例として、MicrosoftのAzure OpenAI Serviceなどが挙げられます。

また、社員に対して、どのような情報をAIに入力してはいけないのか、明確なガイドラインを定めて周知徹底することも重要です。

情報漏洩やセキュリティに関する懸念

生成AIサービスとのデータ通信経路や、サービス提供者のサーバーにおけるセキュリティ対策が不十分な場合、サイバー攻撃によって機密情報が外部に漏洩するリスクがあります。

特に、個人情報や取引先の情報など、重要度の高いデータを扱う際には、サービス提供者がどのようなセキュリティ対策を講じているかを十分に確認する必要があります。

また、悪意のある第三者が巧妙なプロンプトを使って、AIから企業の機密情報を引き出そうとする「プロンプトインジェクション」と呼ばれる攻撃手法も存在します。

これにより、本来アクセス権のない情報が漏洩してしまう可能性があります。

これらのセキュリティリスクに対応するためには、国際的なセキュリティ認証(ISO 27001など)を取得している信頼性の高いサービスを選定することが重要です。

さらに、社内の情報管理体制を見直し、AIの利用状況を監視・記録する仕組みを導入するなど、多層的な対策を講じることが求められます。

【課題⑥】生成AI導入における具体的な進め方の不明確さ

生成AIが大きな可能性を秘めていることは理解していても、いざ自社で導入しようとすると、「まず何から手をつければ良いのか」「数あるツールの中からどれを選べば良いのか」といった点でつまずいてしまう企業は少なくありません。

ここでは、生成AI導入における具体的な進め方の不明確さに関する2つの課題を解説します。

- 何から手をつければ良いかわからない

- 自社に最適なAIツールの選定が困難

それでは、1つずつ順に解説します。

何から手をつければ良いかわからない

生成AIの導入プロジェクトを始めるにあたり、明確な目的や計画がないままでは、途中で頓挫してしまったり、期待した効果が得られなかったりする可能性が高くなります。

「流行っているから」という理由だけで飛びつくのではなく、まずは自社が抱える課題を洗い出すことが重要です。

例えば、「顧客からの問い合わせ対応に時間がかかりすぎている」「定型的な報告書の作成に多くの工数を割いている」といった具体的な課題を特定します。

その上で、どの課題を解決するために生成AIを活用するのか、導入の目的を明確に設定します。

目的が決まったら、まずは影響範囲が少なく、効果を測定しやすい業務からスモールスタートで試してみるのが良いでしょう。

実証実験(PoC)を通じてノウハウを蓄積し、成功体験を積み重ねながら、徐々に対象範囲を拡大していくアプローチが成功の鍵となります。

自社に最適なAIツールの選定が困難

現在、市場にはChatGPTをはじめとする数多くの生成AIツールやサービスが存在し、それぞれに特徴や得意分野が異なります。

文章生成に特化したもの、画像生成が得意なもの、特定の業務に特化したアプリケーションなど、その選択肢は多岐にわたります。

これらの中から自社の目的や課題に最も適したツールを選び出すのは、専門知識がなければ非常に困難です。

ツールの機能や性能だけでなく、コスト、セキュリティ、サポート体制なども含めて総合的に比較検討する必要があります。

例えば、機密情報を扱うのであれば、セキュリティが強固な法人向けサービスが必須となります。

また、ITに不慣れな社員でも使えるよう、操作のしやすさ(UI/UX)も重要な選定基準です。

自社だけで選定するのが難しい場合は、複数のツールに精通した外部のコンサルタントや専門家の助言を求めるのも有効な手段です。

導入事例や第三者の評価などを参考にしながら、慎重にツールを選定することが、導入後の失敗を防ぐことにつながります。

【課題⑦】生成AI導入における既存システムとの統合

生成AIを単独のツールとして利用するだけでなく、現在社内で利用している様々なシステムと連携させることで、その価値を飛躍的に高めることができます。

しかし、システム間の連携には技術的なハードルが伴います。

ここでは、生成AI導入における既存システムとの統合に関する2つの課題を解説します。

- 現行システムとの連携の難易度

- 業務フローの再設計が必要になる可能性

それでは、1つずつ順に解説します。

現行システムとの連携の難易度

多くの企業では、顧客管理システム(CRM)、営業支援システム(SFA)、チャットツールなど、様々な業務システムが既に稼働しています。

生成AIをこれらの既存システムと連携させることで、例えば「CRMの顧客データに基づいて、AIが自動でメールの文面を作成する」といった、より高度で効率的な業務プロセスを実現できます。

しかし、異なるシステム同士を連携させるためには、API(Application Programming Interface)に関する専門的な知識や開発スキルが必要となります。

特に、長年利用してきた古いシステムや、独自にカスタマイズされたシステムの場合、連携のためのAPIが提供されていなかったり、データの形式が特殊であったりするため、統合の難易度はさらに高くなります。

システム連携を実現するためには、社内のIT部門や開発部門との緊密な連携が不可欠です。

場合によっては、外部の開発パートナーやシステムインテグレーターの支援が必要になることもあります。

導入するAIツールが、自社の主要なシステムと連携可能かどうかを事前に確認しておくことが重要です。

業務フローの再設計が必要になる可能性

生成AIを導入し、既存システムと連携させることは、単にツールを一つ追加するという話にとどまりません。

AIによってこれまで人間が行っていた作業が自動化されることで、従来の業務フローそのものを見直す必要が出てくる場合があります。

例えば、これまで営業担当者が手作業で行っていた議事録の作成や報告書作成がAIによって自動化された場合、営業担当者はその分の時間を顧客との対話や提案活動といった、より付加価値の高い業務に集中できるようになります。

このように、AIの導入をきっかけに、各従業員の役割や業務の進め方を再定義し、組織全体の生産性を向上させるチャンスと捉えることが重要です。

しかし、業務フローの変更は、現場の従業員にとって大きな負担となる可能性もあります。

なぜ変更が必要なのか、それによってどのようなメリットがあるのかを丁寧に説明し、現場の意見を取り入れながら進めていくことが、スムーズな移行の鍵となります。

【課題⑧】生成AI導入における社員への定着

どんなに高性能な生成AIツールを導入しても、実際にそれを使う社員に受け入れられ、日常的に活用されなければ意味がありません。

ツールの導入と社内への定着は、セットで考えるべき重要な課題です。

ここでは、生成AI導入における社員への定着に関する2つの課題を解説します。

- 導入しても社員に使われない

- 全社的な利用促進と教育体制の構築

それでは、1つずつ順に解説します。

導入しても社員に使われない

新しいツールの導入に対して、社員が抵抗感を示すことは少なくありません。

「今のやり方で問題ない」「新しいことを覚えるのが面倒だ」「AIに仕事を奪われるのではないか」といった不安や反発から、導入したツールが全く使われないというケースはよくあります。

また、ツールの使い方が複雑で分かりにくかったり、実際の業務にどう役立つのかがイメージできなかったりすることも、利用が定着しない大きな原因です。

特に、ITリテラシーにばらつきがある組織では、一部の社員しかツールを使いこなせず、全社的な活用に繋がらないという問題も起こりがちです。

こうした状況を避けるためには、ツール導入の目的やメリットを社員に繰り返し伝え、理解と協力を得ることが不可欠です。

また、直感的で誰でも簡単に使えるツールを選定することも重要なポイントです。

導入初期の段階で、一部の部署で成功事例を作り、その効果を社内に共有することで、他の社員の利用意欲を高めることができます。

全社的な利用促進と教育体制の構築

生成AIを一部の社員だけでなく、組織全体で活用するためには、計画的な利用促進と教育体制の構築が欠かせません。

導入して終わりではなく、継続的に社員をサポートしていく仕組みが必要です。

具体的な施策としては、まず全社員を対象とした基本的な研修会を実施し、AIの概要や基本的な使い方、利用上の注意点などを周知します。

その後は、部署や職種ごとに特化した、より実践的な活用方法を学ぶワークショップを開催するのも効果的です。

また、社内に気軽に質問できるヘルプデスクを設置したり、活用事例を共有するための社内コミュニティを立ち上げたりすることも、利用を促進する上で有効です。

優れたプロンプトや便利な使い方を発見した社員を表彰するなど、楽しみながら活用を広げていくための工夫も良いでしょう。

経営層が率先してAIを活用する姿勢を示すことも、全社的な利用を後押しする上で非常に重要です。

【課題⑨】生成AI導入におけるコンプライアンスリスク

生成AIは非常に便利なツールですが、その利用方法を誤ると、著作権侵害や情報漏洩といった法的な問題(コンプライアンスリスク)を引き起こす可能性があります。

企業としてAIを利用する以上、これらのリスクを正しく理解し、適切な対策を講じる責任があります。

ここでは、生成AI導入におけるコンプライアンスリスクに関する2つの課題を解説します。

- 著作権や商標権を侵害する可能性

- 生成物の利用に関するダブルチェックの必要性

それでは、1つずつ順に解説します。

著作権や商標権を侵害する可能性

生成AIは、インターネット上の膨大なテキストや画像データを学習してコンテンツを生成します。

そのため、AIが生成した文章や画像が、学習元となった既存の著作物と酷似してしまう可能性があります。

これを知らずに企業のウェブサイトや広告などで使用してしまうと、意図せず著作権や商標権を侵害してしまうリスクがあります。

特に、画像生成AIを利用する際には注意が必要です。

生成された画像に、特定の企業ロゴやキャラクターに似たデザインが含まれていないか、慎重に確認する必要があります。

こうしたリスクを回避するためには、生成AIがどのようなデータを学習しているのかを把握し、著作権侵害のリスクが低いサービスを選定することが重要です。

また、AIが生成したコンテンツを商用利用する際には、専用のチェックツールを使用したり、専門家によるリーガルチェックを行ったりするなど、慎重な対応が求められます。

社内でAI利用に関するガイドラインを策定し、権利侵害のリスクについて社員に注意喚起することも不可欠です。

生成物の利用に関するダブルチェックの必要性

生成AIが作成したコンテンツは、ハルシネーション(もっともらしい嘘)やバイアス、権利侵害のリスクを内包している可能性があるため、そのまま外部に公開したり、重要な意思決定に利用したりするのは非常に危険です。

AIの生成物はあくまで「下書き」や「たたき台」と位置づけ、最終的には必ず人間の目による確認と修正(ダブルチェック)を行うプロセスを徹底する必要があります。

例えば、AIが作成したプレスリリースを配信する前には、広報担当者が内容の事実確認や表現の適切性をチェックします。

AIが作成したプログラムコードをシステムに実装する前には、エンジニアがバグやセキュリティ上の脆弱性がないかをレビューします。

このようなダブルチェックの体制を業務フローに組み込むことで、AI利用に伴う様々なリスクを大幅に低減することができます。

AIに任せる部分と、人間が責任を持って判断する部分を明確に切り分け、両者の長所を組み合わせることが、安全かつ効果的なAI活用の鍵となります。

こちらはChatGPTの多様な導入事例を業界別に解説した記事です。合わせてご覧ください。 https://taskhub.jp/useful/chatgpt-introduction-casestudy/

あなたの脳はサボってる?生成AIで「賢くなる人」と「思考停止する人」の決定的違い

生成AIを毎日使っているあなた、その使い方で本当に「賢く」なっていますか?実は、使い方を間違えると、私たちの脳はどんどん“怠け者”になってしまうかもしれません。マサチューセッツ工科大学(MIT)の衝撃的な研究がそれを裏付けています。しかし、ご安心ください。東京大学などのトップ研究機関では、生成AIを「最強の思考ツール」として使いこなし、能力を向上させる方法が実践されています。この記事では、「思考停止する人」と「賢くなる人」の分かれ道を、最新の研究結果と具体的なテクニックを交えながら、どこよりも分かりやすく解説します。

【警告】生成AIはあなたの「脳をサボらせる」かもしれない

「生成AIに任せれば、頭を使わなくて済む」——。もしそう思っていたら、少し危険なサインです。MITの研究によると、生成AIを使って文章を作った人は、自力で考えた人に比べて脳の活動が半分以下に低下することがわかりました。

これは、脳が考えることをAIに丸投げしてしまう「思考の外部委託」が起きている証拠です。この状態が続くと、次のようなリスクが考えられます。

深く考える力が衰える: AIの答えを鵜呑みにし、「本当にそうかな?」と疑う力が鈍る。

記憶が定着しなくなる: 楽して得た情報は、脳に残りづらい。

アイデアが湧かなくなる: 脳が「省エネモード」に慣れてしまい、自ら発想する力が弱まる。

便利なツールに頼るうち、気づかぬ間に、本来持っていたはずの「考える力」が失われていく可能性があるのです。

引用元:

MITの研究者たちは、大規模言語モデル(LLM)が人間の認知プロセスに与える影響について調査しました。その結果、LLM支援のライティングタスクでは、人間の脳内の認知活動が大幅に低下することが示されました。(Shmidman, A., Sciacca, B., et al. “Does the use of large language models affect human cognition?” 2024年)

【実践】AIを「脳のジム」に変える賢い使い方

では、「賢くなる人」は生成AIをどう使っているのでしょうか?答えはシンプルです。彼らはAIを「答えを出す機械」ではなく、「思考を鍛えるパートナー」として利用しています。ここでは、誰でも今日から真似できる3つの「賢い」使い方をご紹介します。

使い方①:最強の「壁打ち相手」にする

自分の考えを深めるには、反論や別の視点が不可欠です。そこで、生成AIをあえて「反対意見を言うパートナー」に設定しましょう。

魔法のプロンプト例:

「(あなたの意見や企画)について、あなたが優秀なコンサルサルタントだったら、どんな弱点を指摘しますか?最も鋭い反論を3つ挙げてください。」

これにより、一人では気づけなかった思考の穴を発見し、より強固な論理を組み立てる力が鍛えられます。

使い方②:あえて「無知な生徒」として教える

自分が本当にテーマを理解しているか試したければ、誰かに説明してみるのが一番です。生成AIを「何も知らない生徒役」にして、あなたが先生になってみましょう。

魔法のプロンプト例:

「今から『(あなたが学びたいテーマ)』について説明します。あなたは専門知識のない高校生だと思って、私の説明で少しでも分かりにくい部分があったら、遠慮なく質問してください。」

AIからの素朴な質問に答えることで、自分の理解度の甘い部分が明確になり、知識が驚くほど整理されます。

使い方③:アイデアを無限に生み出す「触媒」にする

ゼロから「面白いアイデアを出して」と頼むのは、思考停止への第一歩です。そうではなく、自分のアイデアの“種”をAIに投げかけ、化学反応を起こさせるのです。

魔法のプロンプト例:

「『(テーマ)』について考えています。キーワードは『A』『B』『C』です。これらの要素を組み合わせて、今までにない斬新な企画の切り口を5つ提案してください。」

AIが提案した意外な組み合わせをヒントに、最終的なアイデアに磨きをかけるのはあなた自身です。これにより、発想力が刺激され、創造性が大きく向上します。

まとめ

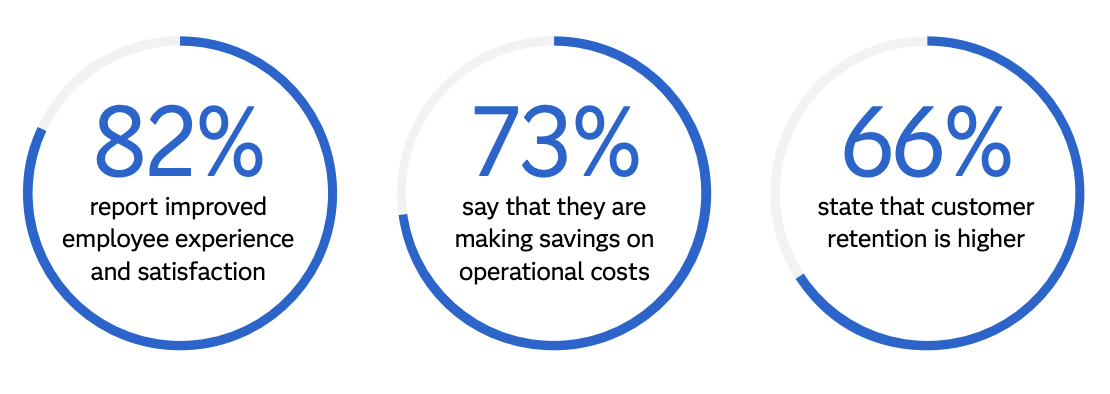

企業は労働力不足や業務効率化の課題を抱える中で、生成AIの活用がDX推進や業務改善の切り札として注目されています。

しかし、実際には「どこから手を付ければいいかわからない」「社内にAIリテラシーを持つ人材がいない」といった理由で、導入のハードルが高いと感じる企業も少なくありません。

そこでおすすめしたいのが、Taskhub です。

Taskhubは日本初のアプリ型インターフェースを採用し、200種類以上の実用的なAIタスクをパッケージ化した生成AI活用プラットフォームです。

たとえば、メール作成や議事録作成、画像からの文字起こし、さらにレポート自動生成など、さまざまな業務を「アプリ」として選ぶだけで、誰でも直感的にAIを活用できます。

しかも、Azure OpenAI Serviceを基盤にしているため、データセキュリティが万全で、情報漏えいの心配もありません。

さらに、AIコンサルタントによる手厚い導入サポートがあるため、「何をどう使えばいいのかわからない」という初心者企業でも安心してスタートできます。

導入後すぐに効果を実感できる設計なので、複雑なプログラミングや高度なAI知識がなくても、すぐに業務効率化が図れる点が大きな魅力です。

まずは、Taskhubの活用事例や機能を詳しくまとめた【サービス概要資料】を無料でダウンロードしてください。

Taskhubで“最速の生成AI活用”を体験し、御社のDXを一気に加速させましょう。